Wer baut eure Urteilskraft?

Die meisten Debatten über AI in Unternehmen drehen sich gerade um dieselben Fragen: Welche Tools sind gut genug? Wo kann man Headcount sparen? Welche Teams werden schneller? Welche Prozesse lassen sich automatisieren? Das sind reale Fragen. Aber sie verfehlen den eigentlichen Managementpunkt.

Praktischer Test zum Essay

Drei Vorlagen für ein Gespräch mit einer KI: Ziel klären, Widersprüche prüfen, Delegierbarkeit testen. Du bekommst keine fertige Strategie und keine Tool-Empfehlung.

Vorlagen öffnenDenn AI verändert nicht nur die Kosten der Ausführung. Sie verändert auch die Bedingungen, unter denen in Organisationen Urteilskraft entsteht.

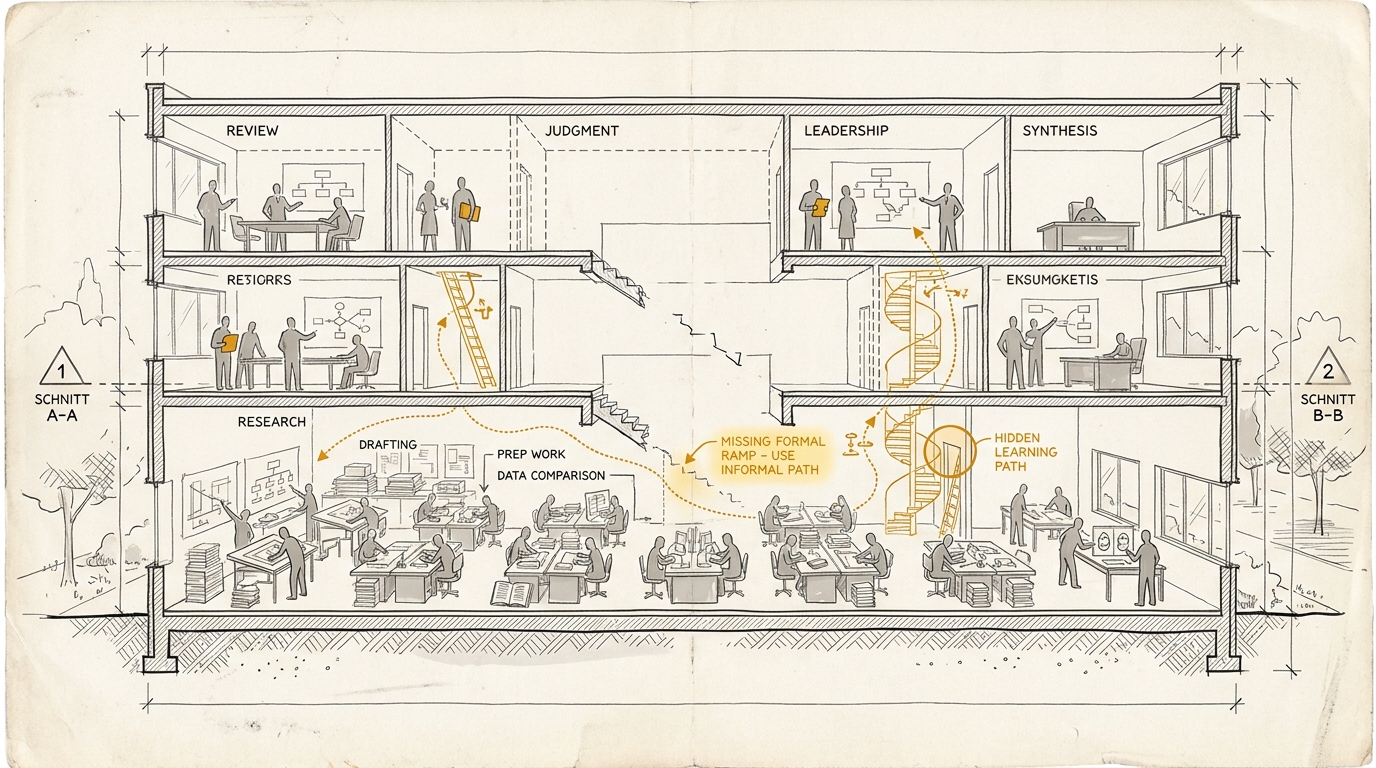

Darum geht es in diesem Text. Nicht um eine weitere AI-Prophezeiung, sondern um eine Diagnose. Er soll drei Dinge sichtbar machen:

- welche Aufgaben in Wahrheit Lernrampen waren

- warum ihre Automatisierung mehr ist als ein Effizienzgewinn

- welche neue Führungsaufgabe daraus entsteht

Wer das früh erkennt, baut nicht nur schnellere Teams. Er baut belastbarere.

Die eigentliche Führungsfrage im Agentenzeitalter lautet deshalb nicht nur: Was können wir automatisieren?

Sie lautet: Wie organisieren wir noch Urteilskraft, wenn die alte Rampe verschwindet, über die Menschen bisher gelernt haben, gute von plausiblen, aber falschen Ergebnissen zu unterscheiden?

Bleib auf dem Laufenden

Erhalte eine Nachricht, wenn ein neuer Essay erscheint. Jederzeit abbestellbar.

Die falsche Mitte der Debatte

Viele AI-Debatten hängen noch an einer falschen Mitte. Sie behandeln Produktivität als den Kern und Lernen als ein späteres Nebenproblem.

Das ist verständlich. Produktivität ist sichtbar. Ein Team liefert mehr. Ein Analyst braucht weniger Zeit. Ein Agent zieht Informationen aus mehreren Systemen, schreibt einen ersten Entwurf, bereitet eine Präsentation vor. Das sieht nach Fortschritt aus, weil es wie Output aussieht.

Was dabei weniger sichtbar ist: Welche Teile der bisherigen Arbeit waren in Wahrheit keine bloße Arbeit, sondern Ausbildungsinfrastruktur?

Vorbereitung. Zuarbeit. Erste Synthese. Variantenvergleich. Kommentierte Korrektur. Material sortieren. Randfälle sehen. Ein zweites oder drittes Mal an derselben Sache scheitern. Das alles wirkte in vielen Organisationen wie Fleißarbeit. Genau dort haben Menschen aber oft gelernt, wie Qualität aussieht.

Deshalb ist es zu kurz gedacht, AI-Einführung nur als Automatisierung zu lesen. Wenn Agents zuerst die Vorarbeit absorbieren, verschwinden nicht nur Stunden aus dem Prozess. Dann verschwindet womöglich auch ein Teil der stillen Mechanik, über die aus unerfahrenen Leuten verlässliche Leute wurden.

Und genau deshalb ist das kein Nachwuchsthema. Es ist ein Managementthema.

Was AI zuerst wirklich frisst

Die meisten Systeme ersetzen nicht zuerst die Kernrolle. Sie greifen zuerst die Arbeit rund um die Kernrolle an.

Claude Cowork ist dafür ein gutes aktuelles Beispiel. Anthropic positioniert Cowork inzwischen ausdrücklich als allgemeines Arbeitswerkzeug für Wissensarbeit, nicht nur für Engineering. In den offiziellen Beschreibungen geht es um Research, Zusammenziehen von Material, Competitive Analysis, Berichte, Tabellen, Browser-Arbeit, Connector-Nutzung und strukturierte Deliverables.

Das Interessante daran ist nicht nur, dass so etwas jetzt geht. Das Interessante ist, welche Art von Arbeit dort zuerst billig wird.

Nicht die finale strategische Entscheidung.

Nicht das letzte Gespräch mit dem Kunden.

Nicht die heikle politische Abwägung.

Sondern die Arbeit davor:

- Informationen sammeln

- Material strukturieren

- erste Vergleiche ziehen

- Hypothesen formulieren

- einen ersten Entwurf bauen

- die Fläche möglicher Lösungen breiter und schneller machen

Genau hier liegt die unterschätzte Verschiebung.

In vielen Wissensrollen war diese Schicht bisher nicht bloß Overhead. Sie war die Zone, in der Menschen lernten, was wichtig ist, was weggelassen werden kann, welche Ausnahmen zählen, welche Formulierungen tragen und welche nur professionell klingen.

AI frisst deshalb nicht zuerst die Könnerschaft. Sie frisst oft zuerst die Rampe dorthin.

Das gilt nicht nur für Software. Es gilt für Research, Strategie, Analyse, Account-Arbeit, Konzeption, Recht, Finance, Operations und einen Teil klassischer Managementarbeit.

Solange man nur auf Zeitersparnis schaut, wirkt das wie ein klarer Gewinn. Und oft ist es das auch. Die Frage ist nur, was auf der anderen Seite ausgedünnt wird.

Die alte Rampe war nie als Rampe beschriftet

Das Problem ist nicht neu. Nur die Sichtbarkeit ist neu.

Organisationen haben schon immer von Lernformen gelebt, die nie ordentlich als Lernformen beschrieben wurden. Das war die okkulte Infrastruktur der Wissensarbeit.

Jemand durfte erst den Hintergrund recherchieren, bevor er später selbst die Empfehlung formulieren sollte.

Jemand schrieb erst Vorlagen, Notizen und Entwürfe, bevor er später das eigentliche Dokument verantwortete.

Jemand sichtete Fälle, kommentierte Varianten, bereitete ein Meeting vor, führte nach, korrigierte Material und lernte dabei langsam, welche Signale zählen und welche nicht.

Das war keine pädagogische Romantik. Es war schlicht die Art, wie Können in vielen Organisationen entstanden ist.

Die Lernforschung hat dafür seit langem einen Namen. Lave und Wenger beschreiben mit legitimate peripheral participation, dass Lernen nicht bloß durch Wissensübertragung passiert, sondern durch schrittweise Teilhabe an echter Praxis. Menschen starten am Rand, übernehmen begrenzte Teile, sehen, wie Arbeit tatsächlich gemacht wird, und wachsen dann in komplexere Verantwortung hinein.

Das klingt akademisch. In Organisationen ist es sehr konkret. Viele Menschen wurden nicht senior, weil irgendjemand sie in einen Seminarraum gesetzt hat. Sie wurden es, weil sie über Jahre nah genug am Material waren, um Unterschiede zu sehen, die man in keiner Checkliste vollständig festhalten kann.

Genau deshalb ist die Frage so heikel. Wenn diese Randzonen der Praxis schneller verschwinden als die Organisation neue Formen des Lernens baut, wird die Reproduktionslogik von Urteilskraft instabil.

Das lässt sich inzwischen auch belegen

Man muss dafür nicht im Nebel argumentieren.

Der World Economic Forum Report zu den Jobs der nächsten Jahre nennt Skill Gaps die größte Barriere der Transformation. 63 Prozent der befragten Arbeitgeber sehen dort das zentrale Hindernis. 77 Prozent planen Upskilling, gleichzeitig erwarten 41 Prozent Stellenabbau dort, wo AI Aufgaben automatisiert. Das ist die Makroebene: Unternehmen wissen, dass die Fähigkeitsfrage zentral wird.

Spannend wird es eine Ebene tiefer.

Der Thomson-Reuters-Report zu GenAI in Professional Services liefert einen beispielhaften Fall, gerade weil er nicht aus der Software-Ecke kommt. Dort glauben 95 Prozent der Befragten, dass GenAI in den nächsten fünf Jahren zentral für ihren Workflow wird. Gleichzeitig berichtet weniger als ein Drittel, dass ihre Organisation überhaupt GenAI-Training anbietet. Der Report formuliert die daraus entstehende Lücke ungewöhnlich klar: Manche Neueinstellungen würden faktisch „set up for failure“, weil Organisationen GenAI zentral machen wollen, aber weder gezielt dafür einstellen noch die nötigen Fähigkeiten systematisch aufbauen.

Das ist kein Nachwuchsromantiker-Satz. Das ist ein Managementversagen in Zahlenform.

Noch klarer wird die Verschiebung im Rechtsbereich. Stanford Law baut Curriculum und Clinics sichtbar um, weil viele Aufgaben, über die Junior Associates früher an Praxis herangeführt wurden, durch AI neu verteilt werden. Und an der University of Chicago sagen die Verantwortlichen die unbequeme Wahrheit ziemlich offen: Die Werkzeuge werden besser, aber die eigentliche professionelle Leistung liegt dann nicht mehr im Standardoutput, sondern in der Urteilsarbeit darüber.

Die Fälle kommen aus unterschiedlichen Domänen. Die Diagnose ist dieselbe: Organisationen bauen ihre Arbeitslogik schneller um als ihre Lernlogik. Genau deshalb gehört die Frage nicht in ein Nebenkapitel über Nachwuchs, sondern mitten in die Managementdebatte.

Das alles läuft auf dieselbe Frage hinaus:

Wenn Vorarbeit, Erstentwürfe und Routineanalyse billiger werden, wo entsteht dann künftig das, was in Organisationen später nach Erfahrung aussieht?

Die ehrliche Gegenposition

Bis hierhin könnte man den Text falsch lesen, nämlich als nostalgische Verteidigung alter Junior-Arbeit. Das wäre zu einfach.

Denn es gibt auch eine faire Gegenposition. Eine wichtige sogar.

Die bekannte QJE-Studie aus dem Customer-Support-Kontext zeigt, dass generative AI gerade weniger erfahrenen Mitarbeitenden helfen kann, deutlich produktiver zu werden. Im untersuchten Setting stieg die Produktivität im Schnitt um 15 Prozent, die größten Gewinne hatten die weniger erfahrenen und weniger qualifizierten Mitarbeitenden. Die Autoren argumentieren plausibel, dass AI hier Teile des Verhaltens der stärksten Mitarbeitenden breiter verteilt.

Das ist kein kleiner Einwand. Es ist ein harter Gegenbeleg gegen jede plumpe Kulturpessimistik.

AI kann also durchaus eine Lernhilfe sein.

AI kann Erfahrung teilweise komprimieren.

AI kann dafür sorgen, dass Einsteiger schneller zu brauchbaren Ergebnissen kommen.

Aber genau deshalb wird die Führungsfrage präziser, nicht kleiner.

Denn wenn AI Teile von Erfahrungswissen verteilt, muss Führung genauer unterscheiden:

- Welche Fähigkeiten können sinnvoll durch AI gestützt werden?

- Welche Fähigkeiten müssen weiterhin durch eigene Praxis, Feedback und Grenzfälle entstehen?

Genau hier werden viele Debatten schlampig. Sie springen zu schnell von „AI hilft Juniors“ zu „Die alte Rampe ist egal“. Das folgt gerade nicht.

Was folgt, ist etwas Schwierigeres:

Wenn natürliche Lernrampen dünner werden, muss Management bewusster entscheiden, welche Form von Können es weiterhin organisch wachsen lässt und welche es gezielt durch Training, Review und Tooling ergänzt.

Und genau hier beginnt die neue Führungsaufgabe

Früher konnte Management einen Teil von Urteilskraft stillschweigend an die Organisation delegieren.

Nicht bewusst. Nicht perfekt. Aber wirksam genug.

Die Prozesse waren langsam, die Übergaben zahlreich, die Nähe zum Material hoch. Menschen lernten durch Wiederholung, Beobachtung, Korrektur und die manchmal unerquicklich langen Wege durch echte Arbeit.

Diese beiläufige Reproduktion war teuer und oft unerquicklich. Aber sie hatte einen Nebeneffekt: Sie brachte verlässliche Leute hervor.

Je mehr AI die operative Vorarbeit übernimmt, desto weniger kann Führung sich auf diesen Nebeneffekt verlassen.

Dann verschiebt sich die Aufgabe.

Führung ist nicht mehr nur die Instanz, die Richtung vorgibt, Ressourcen verteilt und Konflikte trägt. Führung wird stärker zur Instanz, die die Bedingungen baut, unter denen Urteilskraft überhaupt noch entstehen kann.

Das klingt größer, als es ist. In der Praxis heißt es etwas sehr Konkretes:

- Führung muss stärker erklären, woran gute Arbeit erkennbar ist.

- Führung muss Lernschleifen absichtlicher bauen.

- Führung muss differenzieren, welche Aufgaben bloß Routine waren und welche verdeckte Ausbildungsfunktion hatten.

- Führung muss Pipeline-Gesundheit als Qualitätsfrage lesen, nicht nur als People-Frage.

Anders gesagt:

Wenn AI Bedienung billiger macht, muss Führung Urteilskraft sichtbarer, trainierbarer und vermittelbarer machen.

Das ist die eigentliche Managementverschiebung.

Warum Taste so plötzlich kein Luxus mehr ist

Hier berührt der Text einen Begriff, der schnell weich wirkt, aber in Wahrheit operativ hart ist: Taste.

In Artefaktproduktion just got cheap tauchte Taste zuerst als knappe Führungsressource auf. In Wer spezifiziert hier eigentlich? wurde daraus zusammen mit Spec und Evaluation ein belastbareres Modell. Hier kommt jetzt eine weitere Verschiebung hinzu: Wenn die alte Lernrampe dünner wird, reicht es nicht mehr, Taste nur zu besitzen. Dann muss sie stärker erklärt, gezeigt und weitergegeben werden.

Taste ist in Organisationen oft das, was übrig bleibt, wenn man Qualität nicht präzise genug benennen kann. „Das ist noch nicht rund.“ „Das wirkt nicht sauber.“ „Die Analyse greift zu kurz.“ „Die Story trägt nicht.“ Solche Sätze sind oft richtig, aber als Führungsinstrument unzureichend, wenn die alte Rampe dünner wird.

Denn solange Menschen über Jahre nah genug an guter Arbeit sind, kann ein Teil dieser Maßstäbe still übernommen werden. Wenn dieser Weg schwächer wird, reicht implizite Taste nicht mehr. Genau dort schließt auch Die Vokabellücke an: Solange einer Organisation die Sprache für gute Arbeit fehlt, bleibt auch ihr Urteil schwer vermittelbar.

Das heißt nicht, dass man Urteil vollständig in eine Checkliste verwandeln kann. Das wäre die nächste Illusion.

Aber man kann es expliziter machen:

- durch gute Vorher-Nachher-Vergleiche

- durch kommentierte Redlines

- durch Begründung statt nur Ablehnung

- durch dokumentierte Entscheidungen

- durch klare Qualitätsfragen

- durch das Sichtbarmachen typischer Fehlformen

Ericsson hat für Spitzenleistung den Begriff der deliberate practice stark gemacht: Expertise entsteht nicht nur durch Wiederholung, sondern durch strukturierte Übung unter Feedbackbedingungen. Genau darin liegt die Pointe für Führung. Wenn natürliche Lernumgebungen dünner werden, braucht es mehr absichtliche Bedingungen, unter denen Menschen gutes Urteil trainieren.

Dann wird Taste nicht zum Soft Skill. Sie wird zur Führungsinfrastruktur.

Was das für Executives praktisch heißt

An dieser Stelle wird der Text nur dann nützlich, wenn er in handhabbare Fragen übersetzt wird. Fünf davon reichen für den Anfang.

1. Kartiert eure versteckten Lernrampen

Schaut euch die Aufgaben an, die gerade als erste unter AI-Druck geraten:

- Vorrecherche

- Erstentwürfe

- Materialaufbereitung

- Variantenvergleiche

- Routineanalyse

- Vorbereitung von Entscheidungen

Fragt nicht nur: Wie viel Zeit sparen wir?

Fragt auch: War das bei uns bisher bloß Routine oder eine Lernzone?

Wenn die ehrliche Antwort lautet, dass dort ein Teil eurer künftigen Qualität entstanden ist, dann ist vollständige Automatisierung keine reine Effizienzfrage mehr.

2. Trennt Output-Steigerung von Pipeline-Gesundheit

Ein Team kann kurzfristig deutlich produktiver werden und gleichzeitig seine künftige Urteilspipeline ausdünnen.

Deshalb reicht es nicht, AI-Erfolg nur über Durchsatz, Zeitgewinn oder Stückkosten zu lesen. Ihr braucht mindestens eine zweite Sicht:

- Wer lernt bei uns noch, Ergebnisse selbst zu beurteilen?

- Wo erleben weniger erfahrene Kolleginnen und Kollegen noch echte Grenzfälle?

- Wo wird Begründung trainiert statt nur Bedienung?

Wenn ihr das nicht beantworten könnt, habt ihr bereits ein Führungsproblem, kein Reporting-Problem.

3. Macht gute Arbeit besprechbarer

Viele Organisationen haben Qualitätsansprüche, aber keine Sprache dafür. Das reicht in einer Phase, in der Menschen über lange Beobachtung implizit lernen. Es reicht nicht mehr, wenn die Rampe dünner wird. Das ist die Managementversion derselben Beobachtung aus Die Vokabellücke: Wenn euch das Vokabular für gute Arbeit fehlt, könnt ihr sie auch schlechter trainieren.

Deshalb braucht es explizitere Formen:

- kommentierte Beispiele

- Review-Fragen

- Anti-Beispiele

- begründete Freigaben und Ablehnungen

- kleine Entscheidungslogs

Nicht, um Geschmack zu mechanisieren. Sondern um ihn lehrbar zu machen.

4. Gebt Senioren einen Entwicklungsauftrag, nicht nur einen Freigabeauftrag

Je mehr AI die operative Vorarbeit übernimmt, desto größer wird die Gefahr, dass Seniorität auf reine Abnahme reduziert wird. Das wäre zu wenig.

Die neue Aufgabe von erfahrenen Leuten ist nicht nur, die letzte Schranke zu sein. Sie müssen stärker als bisher erklären, kalibrieren, kommentieren und Lernumgebungen bauen. Sonst bleibt das Urteil bei ihnen, ohne sich zu verbreiten.

Das ist anstrengender als bloße Freigabe. Aber es ist wahrscheinlich einer der wertvollsten Teile ihrer künftigen Rolle.

5. Führt AI nicht nur als Effizienzprogramm ein

Wenn AI-Einführung nur unter dem Budgethebel läuft, produziert sie fast zwangsläufig genau die falschen Fragen:

- Wo können wir kürzen?

- Welche Aufgaben entfallen?

- Wie viel schneller geht es?

Die wichtigeren Fragen sind:

- Welche Fähigkeiten werden bei uns künftig knapper?

- Welche Lernzonen wollen wir erhalten?

- Wo müssen wir neue Trainingsformen bauen?

- Welche Form von Urteilskraft ist für unser Geschäft nicht optional?

Wer diese Fragen auslässt, modernisiert vielleicht seine Tools, aber nicht seine Organisation.

Ehrlichkeitstest

Es gibt mindestens drei Gründe, vorsichtig zu bleiben.

Erstens: Nicht jede Vorarbeit ist wertvolle Lernrampe. Vieles war tatsächlich Leerlauf, schlecht gestaltete Übergabe oder Verwaltungsgeröll. Das muss nicht aus Nostalgie konserviert werden.

Zweitens: Nicht jede Organisation braucht dieselbe Tiefe an Urteil in jeder Rolle. Manche Aufgaben können stärker standardisiert, andere stärker durch AI gestützt werden, ohne dass dadurch echte Fähigkeiten verloren gehen.

Drittens: Wir sind früh. Viele der heutigen Lernpfade werden durch neue ersetzt. Es ist gut möglich, dass in zwei Jahren andere Formen von Training, Simulation, Review und Mensch-AI-Pairing entstehen, die effizienter sind als die alte Rampe.

Aber keiner dieser Einwände entkräftet das Kernproblem.

Sie machen nur klar, wie die saubere Formulierung lautet:

Die Gefahr ist nicht, dass AI jede Lernrampe zerstört. Die Gefahr ist, dass Organisationen ihre Arbeitslogik schneller umbauen als ihre Lernlogik.

Und genau das ist eine Führungsfrage.

Die eigentliche Entscheidung

Die meisten Unternehmen werden in den nächsten Jahren nicht daran scheitern, dass sie kein gutes Modell gefunden haben.

Sie werden daran scheitern, dass sie AI als Produktivitätshebel eingeführt haben, ohne gleichzeitig zu entscheiden, wie in ihrer Organisation künftig noch Qualität, Urteilskraft und verlässliche Seniorität entstehen sollen.

Das ist kein abstraktes Problem für HR, Learning oder Talent Acquisition. Es sitzt mitten im Betrieb.

Es sitzt in der Frage, welche Arbeit ihr automatisiert.

Es sitzt in der Frage, was eure Seniors erklären.

Es sitzt in der Frage, ob gute Urteile bei euch sichtbar werden oder bloß in Köpfen bleiben.

Und es sitzt in der Frage, ob ihr AI nur zur Beschleunigung nutzt oder auch dazu, eure Lernarchitektur ehrlicher zu sehen.

Denn genau dort trennt sich die nächste Generation von Organisationen.

Die eine Sorte wird schneller.

Die andere wird schneller und belastbarer.

Der Unterschied zwischen beiden ist nicht das Modell.

Es ist, ob Führung verstanden hat, dass ihre Aufgabe nicht mehr nur darin besteht, Arbeit zu organisieren.

Sondern darin, die Bedingungen zu bauen, unter denen aus schnellerer Arbeit noch verlässliches Urteil entsteht.

Praktischer Test zum Essay

Drei Vorlagen für ein Gespräch mit einer KI: Ziel klären, Widersprüche prüfen, Delegierbarkeit testen. Du bekommst keine fertige Strategie und keine Tool-Empfehlung.

Vorlagen öffnen