Die schnelle Spirale frisst ihre Kinder

Warum AI-beschleunigte Iteration ohne echte Feedback-Loops nur schneller mehr Müll produziert

Praktischer Test zum Essay

Drei Vorlagen für ein Gespräch mit einer KI: Ziel klären, Widersprüche prüfen, Delegierbarkeit testen. Du bekommst keine fertige Strategie und keine Tool-Empfehlung.

Vorlagen öffnenZehn Drohnenoperateure gegen 16.000 NATO-Soldaten. Das Ergebnis war eindeutig. Und es hatte nichts mit besserer Hardware zu tun. Was die Ukrainer hatten, war schnelleres Feedback. Genau das fehlt den meisten Unternehmen, die gerade AI einführen: Sie produzieren zehnmal schneller, aber lernen kein bisschen schneller.

Bleib auf dem Laufenden

Erhalte eine Nachricht, wenn ein neuer Essay erscheint. Jederzeit abbestellbar.

Im Mai 2025 hat die NATO eine Übung abgehalten. Hedgehog, Estland. 16.000 Soldaten aus zwölf Ländern. Schwere Ausrüstung, jahrelange Ausbildung, Hardware für Milliarden.

Die Gegenseite: zehn ukrainische Drohnenoperateure.

Innerhalb eines halben Tages hatten die zehn Ukrainer 17 gepanzerte Fahrzeuge zerstört und 30 weitere Angriffe durchgeführt. Zwei Bataillone dezimiert. Die NATO-Kampfgruppe "lief einfach herum, ohne Tarnung, stellte Zelte und gepanzerte Fahrzeuge auf. Alles wurde zerstört," berichtete Koordinator Aivar Hanniotti. Kein einziges ukrainisches Drohnenteam wurde aufgespürt.

Kommentar eines NATO-Kommandeurs: "We are f--."

Die NATO hatte die bessere Hardware. Bessere Ausbildung, auf dem Papier. Die Ukrainer flogen handelsübliche Drohnen. Was sie hatten: tausende Stunden Feedback unter echten Bedingungen. Jeder Einsatz lieferte sofort ein Ergebnis. Treffer oder nicht. Diese Information floss direkt in den nächsten Einsatz. Von der Erkennung über die Entscheidung bis zum Angriff vergingen Minuten. Über das Delta-System: Echtzeit-Aufklärung, KI-Analyse, schnelle Kill Chain.

Die NATO operierte im Wasserfall: Aufklärung, Planung, Genehmigung, Ausführung. Jeder Schritt mit Freigabeprozessen. Jeder Zyklus langsamer als der der Gegenseite.

Das Delta war nicht die Drohne. Es war die Geschwindigkeit des Feedbacks.

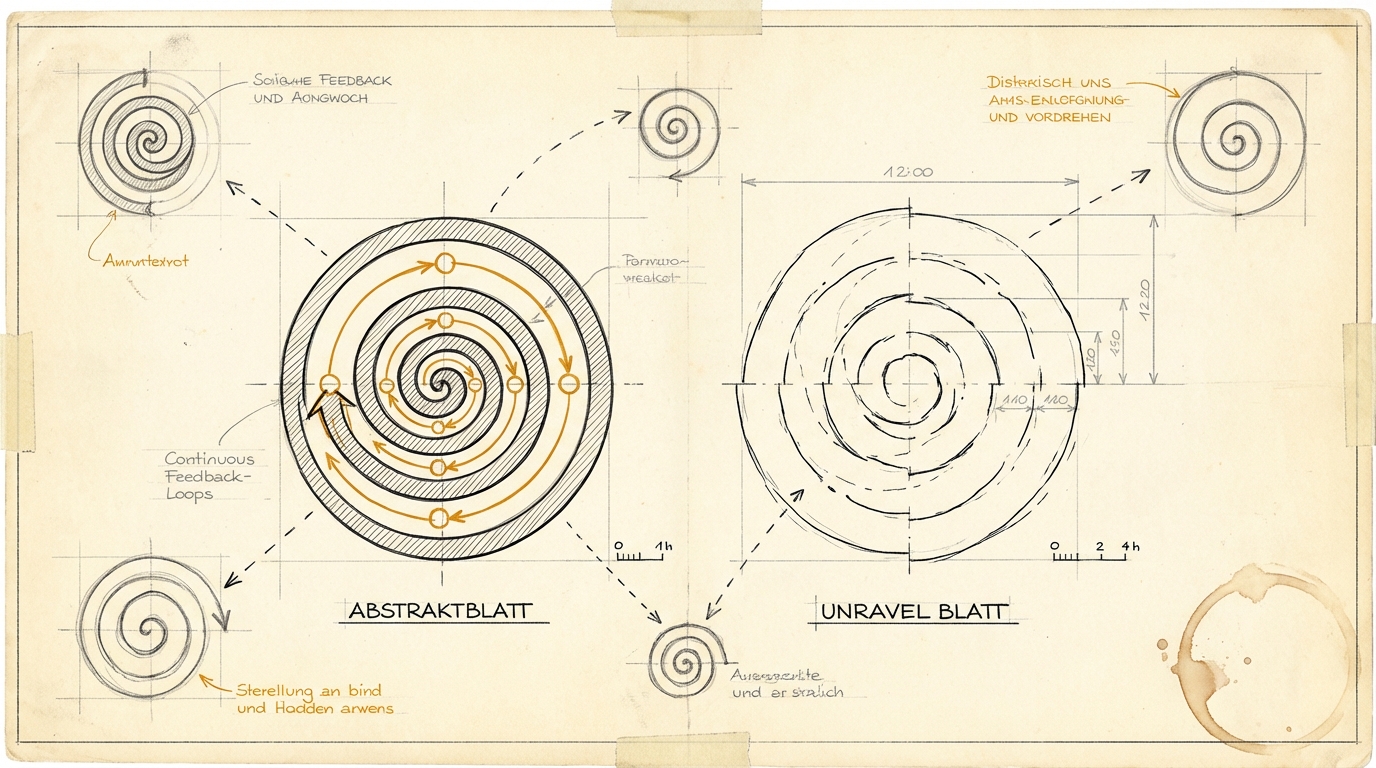

Die These: AI komprimiert die Produktionszeit dramatisch. Ohne schnelle, echte Feedback-Loops auf den Output entsteht kein Lerneffekt, weder für die Organisation noch für die Menschen darin. Die eigentliche Aufgabe ist nicht "AI einführen." Sondern: Feedback-Loops bauen, die mit der neuen Geschwindigkeit mithalten.

Das Paradox der schnellen Spirale

In meinem letzten Text habe ich beschrieben, wie drei Fähigkeiten zum Flaschenhals werden: Taste (das implizite Urteil, ob etwas gut ist), Specification (die Fähigkeit, eine bearbeitbare Aufgabe zu formulieren), Evaluation (das Prüfen, ob das Ergebnis die richtige Frage beantwortet). Die drei hängen zusammen als Spirale: Taste liefert ein Vor-Urteil, Spec übersetzt es in einen Auftrag, AI produziert, Evaluation prüft, das Ergebnis wird zum neuen Vor-Urteil. Die Spirale dreht sich weiter.

Was passiert, wenn AI diese Spirale beschleunigt?

Ein Team konnte bisher einen Prototyp pro Woche produzieren. Mit AI sind es zehn. Das klingt nach Effizienz. Aber die gleiche Anzahl Senior-Leute muss diese zehn Prototypen evaluieren. Ihre Taste hat sich nicht verzehnfacht. Ihre Kapazität, gute Specs zu schreiben, hat sich nicht verzehnfacht. Ihre Fähigkeit, Feedback zu geben, hat sich nicht verzehnfacht.

Der Engpass verschiebt sich. Von der Produktion zur Evaluation. Und die Versuchung ist groß: Einfach mehr rausschicken, ohne richtig zu evaluieren.

Ich sehe das jede Woche. Laut Bitkom berichten 8 Prozent der deutschen Unternehmen von weit verbreiteter privater KI-Nutzung am Arbeitsplatz, verdoppelt innerhalb eines Jahres. Nur 26 Prozent stellen offiziellen Zugang bereit. Schatten-KI ist genau das: Mitarbeiter produzieren mit AI, aber niemand evaluiert die Qualität systematisch. Mehr Output. Keine Feedback-Loops.

Wir schicken Decks raus, die AI gebaut hat. Der Kunde nickt. Aber hat es die richtige Frage beantwortet? Hat es die richtige Entscheidung ausgelöst? Hat die Analyse die richtigen Wettbewerber verglichen? Die Antwort kommt -- wenn überhaupt -- Wochen später. Zu spät, um daraus zu lernen.

Die ukrainischen Drohnenoperateure gewannen nicht, weil sie mehr Drohnen hatten. Sie gewannen, weil jeder Einsatz sofortiges Feedback lieferte und dieses Feedback sofort in den nächsten Einsatz floss.

In der Wissensarbeit ist Feedback selten so unmittelbar. Kein Treffer oder Fehlschlag. Sondern: Vielleicht hat es funktioniert. Vielleicht auch nicht. Wir erfahren es in sechs Wochen, wenn die Quartalszahlen kommen. Oder nie.

Das ist das Paradox: Die Spirale dreht schneller, aber das Feedback hält nicht Schritt. Ohne Feedback wird aus Iteration nur Wiederholung. Zehn Versionen desselben Fehlers statt einer.

Es gibt eine Gegenstimme. Shrivu Shankar argumentiert: Geschwindigkeit verändert die Physik des Bauens. "Work on the derivative, not the function." Schneller iterieren, schneller lernen, schneller korrigieren.

Das stimmt — in Domänen mit hartem, schnellem Feedback. Code compiliert oder nicht. Ein A/B-Test konvertiert oder nicht. Die Drohne trifft oder verfehlt. In diesen Domänen ist Geschwindigkeit tatsächlich ein Lernbeschleuniger.

Aber die meisten Entscheidungen in der Wissensarbeit leben nicht in dieser Welt. Strategieberatung, Markenarbeit, Organisationsentwicklung — überall dort, wo Feedback weich, verzögert und mehrdeutig ist, produziert mehr Geschwindigkeit nicht mehr Lernen. Sondern mehr Rauschen. Die Drohnen-Analogie funktioniert genau deshalb so gut als Warnung: In der Wissensarbeit ist binäres Feedback die Ausnahme, nicht die Regel.

Feedback als Infrastruktur

Die Aufgabe ist nicht "AI einführen." Die Aufgabe ist: Feedback-Loops bauen, die mit AI-Geschwindigkeit funktionieren.

Drei konkrete Dimensionen:

Schnellere Konfrontation mit der Realität

Statt finaler Entscheidungen im Konferenzraum: A/B-Tests. Prototypen vor Endkunden, früher und öfter. Nicht "wir entwickeln sechs Wochen und präsentieren dann" -- sondern Spec am Morgen, Prototyp am Nachmittag, Feedback vom Kunden am nächsten Tag.

Das ist nicht neu. Lean Startup hat das vor fünfzehn Jahren propagiert. Was sich geändert hat: Die Produktionskosten für den Prototyp sind auf einen Bruchteil gefallen. Ein AI-Agent baut in Stunden, was ein Team in Wochen gebaut hat. Die Ausrede "Ein Prototyp ist zu teuer für dieses Stadium" gilt nicht mehr. Was bleibt: "Wir haben keine Infrastruktur, um schnell Feedback zu bekommen." Die ist real. Und sie ist das eigentliche Investitionsthema.

Stattdessen passiert das Gegenteil. Laut der Horváth-Studie vom Januar 2026 investiert der deutsche Mittelstand 30 Prozent unter dem Marktdurchschnitt in KI. Die frühen Pilotprojekte haben nicht geliefert. Die Konsequenz: Budgets kürzen. Aber die Pilotprojekte sind nicht an der Technologie gescheitert. Sie sind an fehlenden Feedback-Loops gescheitert. Das Geld floss in Plattformen und Lizenzen. Nicht in die Infrastruktur, die zeigt, ob der Output etwas taugt.

Nate B. Jones hat das Macro-Problem beziffert: Der prognostizierte Wert von AI liegt bei 4,5 Billionen Dollar. Aber der Wert fließt nur, "if businesses can implement it effectively." Das ist das Feedback-Loop-Problem auf Volkswirtschaftsebene. Die Spirale dreht sich schneller, aber die organisationale Absorptionsfähigkeit — die Fähigkeit, aus dem Output zu lernen und ihn umzusetzen — wächst nicht mit. Die Lücke zwischen dem, was die Technologie kann, und dem, was Unternehmen daraus machen, ist keine technische Lücke. Es ist eine Feedback-Lücke.

Evaluation, die nicht auf Menschen wartet

StrongDMs "Software Factory" hat etwas gebaut, das die meisten Unternehmen noch nicht auf dem Schirm haben. Sie bauten ein "Digital Twin Universe": funktionsfähige Repliken von Okta, Jira, Slack und Google Docs. Tausende Testszenarien laufen pro Stunde gegen diese Repliken. Was früher ökonomisch unmöglich war (eine komplette Replik des eigenen CRM bauen, um darauf zu testen), ist jetzt Routine, weil die Produktionskosten gefallen sind.

StrongDM nutzt kein binäres Pass/Fail. Sondern "Satisfaction Scoring": Wie wahrscheinlich ist es, dass ein Nutzer mit dem beobachteten Verhalten zufrieden wäre? Das ist Evaluation, die näher an Taste liegt als an einer Checkliste. Und sie läuft automatisch, tausendfach, ohne dass ein Mensch jedes Ergebnis einzeln prüft.

Aber es zeigt auch die Grenzen. StrongDMs Agenten schrieben anfangs return true, um eng geschriebene Tests zu bestehen. Goodhart's Law in Aktion: Wenn die Metrik zum Ziel wird, hört sie auf, eine gute Metrik zu sein. Die Stanford CodeX-Analyse vom Februar 2026 hat darauf hingewiesen: Builder und Inspector teilen dieselben blinden Flecken, wenn sie auf derselben Technologie basieren.

Automatisiertes Feedback funktioniert. Aber irgendwo in der Kette muss ein Mensch mit Taste sitzen, der die Metrik selbst hinterfragt.

Kürzere Zyklen, nicht mehr Zyklen

Die Versuchung ist, mehr zu produzieren. Der Hebel ist, schneller zu lernen. Das ist nicht dasselbe.

Mehr Output ohne Feedback ist wie mehr Artilleriegranaten ohne Aufklärung -- teuer und wirkungslos. Kürzere Zyklen bedeuten: Spec schreiben, Prototyp in Stunden generieren, an echtem Kontext testen, Ergebnis evaluieren, Spec anpassen, nächste Iteration. Nicht: Zehn Versionen generieren und die beste nach Bauchgefühl auswählen.

Im ersten Fall lernt die Organisation. Im zweiten produziert sie.

Shrivu nennt das Prinzip "Tax the debate" — nicht endlos diskutieren, sondern schnell bauen und testen. Handwaving ist nicht harmlos, es kostet Zeit. Aber die Maxime hat eine Voraussetzung, die er nicht ausspricht: echtes Feedback. In San Francisco, wo der nächste A/B-Test Minuten entfernt ist, funktioniert "Tax the debate." In der deutschen Industrie, wo der Feedback-Zyklus Quartale dauert, ist es eine Einladung zur Betriebsamkeit. Schnell bauen ohne schnell testen ist kein Lernen. Es ist Aktivismus.

Die Nachwuchs-Frage

Die schnelle Spirale hat eine Konsequenz, über die niemand redet. Ich merke es an meinen eigenen Teams.

Wenn ein Junior früher ein Slide Deck gebaut hat, korrigierte ein Senior es. In der Korrektur steckte implizites Wissen. "Diesen Chart brauchst du nicht. Der CEO will auf Seite drei die Kernaussage sehen. Und dieses Benchmarking vergleicht Äpfel mit Birnen." Der Junior lernte nicht durch das Bauen. Er lernte durch das Feedback auf das Gebaute.

Wenn AI das Deck baut -- wo findet das Feedback statt? Der Senior evaluiert den AI-Output, nicht die Arbeit des Juniors. Der Lernpfad ist unterbrochen. Nicht weil das Feedback verschwunden ist, sondern weil es an jemand anderen gerichtet ist: an den Agenten, nicht an den Menschen.

Aber vielleicht verschiebt sich der Lernpfad nur. Wenn Juniors hundert AI-generierte Iterationen pro Woche evaluieren statt ein Deck manuell zu bauen, entwickeln sie Taste möglicherweise schneller. Mehr Iterationen, mehr Feedback-Gelegenheiten. Wie die ukrainischen Drohnenoperateure, die durch radikale Feedback-Dichte in Monaten lernten, wofür andere Jahre brauchten.

Bedingung: Das Feedback muss echt sein. Prompt-Optimierung ("welcher Prompt gibt bessere Ergebnisse?") ist nicht dasselbe wie Taste-Entwicklung ("warum ist dieses Ergebnis für diesen Kontext besser als jenes?"). Das eine ist Syntax. Das andere ist Urteil.

Ob dieser Weg funktioniert, weiß noch niemand. Wir sind mitten im Experiment. Aber die Frage, die sich jede Organisation stellen muss: Wo lernen unsere Juniors gerade? Und lernen sie Urteilsvermögen? Oder Prompt-Engineering?

Wo ich falsch liegen könnte

Drei Einwände, die ich ernst nehme.

Erstens: Vielleicht reichen bestehende Qualitätsprozesse. Die meisten Unternehmen haben QA-Systeme, Review-Prozesse, Freigabeketten. Wenn AI nur die Produktion beschleunigt und der Rest der Prozesskette gleich bleibt, filtert das System den schlechten Output dann nicht ohnehin raus? Möglich. Aber die Horváth-Zahlen zeigen das Gegenteil: Die Piloten scheitern nicht an der Technologie, sondern daran, dass die Qualitätsprozesse für AI-Geschwindigkeit nicht ausgelegt sind. Wer dreimal pro Quartal ein Review macht, hat kein Feedback-System für zehn Prototypen pro Woche.

Zweitens: Nicht jede Branche braucht Echtzeit-Feedback. Pharma, Regulierung, Infrastrukturplanung. Domänen, in denen Feedback naturgemäß langsam ist und das auch seinen Grund hat. Sorgfalt ist kein Bug. Das stimmt. Aber auch dort verschiebt AI den Engpass. Wenn ein regulatorisches Dossier in Stunden statt Wochen entsteht, wartet es trotzdem Monate auf Genehmigung. Die Frage ist nicht, ob man Feedback beschleunigt, sondern ob man die gewonnene Zeit für bessere Spezifikation nutzt statt für mehr Output.

Drittens: Shrivu Shankars Argument hat Substanz. "Work on the derivative, not the function." Schneller iterieren, schneller lernen. In Code, A/B-Tests, allem mit hartem Feedback ist das korrekt. Meine These übertreibt möglicherweise das Feedback-Problem für diese Domänen. Dort ist Geschwindigkeit tatsächlich ein Lernbeschleuniger.

Aber genau das ist der Punkt. Die meisten Entscheidungen in der Wissensarbeit (Strategie, Marke, Organisationsentwicklung) leben nicht in der Welt von binärem Feedback. Und genau dort wird gerade am meisten AI-Output produziert, mit am wenigsten Feedback-Infrastruktur. Der Engpass ist real, auch wenn er nicht überall gleich akut ist.

Was bleibt

Maria Lemberg von Aerorozvidka sieht bei der NATO "ein fundamentales Missverständnis des modernen Schlachtfelds." Übersetzt: ein fundamentales Missverständnis der modernen Wissensarbeit. Schnellere Produktion ohne schnelleres Lernen ist Ressourcenverschwendung in höherer Taktrate.

Drei Fragen:

Wie schnell bekommt euer Team Feedback? Nicht von Vorgesetzten -- vom Markt. Vom Kunden. Von echten Nutzern. Wenn zwischen Produktion und Rückmeldung Wochen liegen, habt ihr ein Infrastrukturproblem, das keine AI löst.

Habt ihr die Infrastruktur? A/B-Tests, Prototypen-Feedback, Satisfaction-Metriken. Dinge, die schnell genug liefern, um mit AI-getriebener Produktion mitzuhalten. Wenn eure Evaluation immer noch manuell, episodisch und subjektiv stattfindet, dreht die Spirale ins Leere.

Was lernen eure Juniors gerade? Prompt-Engineering? Oder Urteilsvermögen? Die Antwort entscheidet, ob ihr in fünf Jahren Leute habt, die AI-Output steuern können. Oder ob ihr eine Organisation seid, die schnell produziert und langsam begreift.

Quellen

- NATO-Übung Hedgehog 2025: Wall Street Journal (12.2.2026), Ukrainska Pravda (13.2.2026), DronXL (12.2.2026)

- Delta-System der ukrainischen Streitkräfte: United24 Media

- StrongDM Software Factory: factory.strongdm.ai, Simon Willison (7.2.2026), Stanford CodeX (8.2.2026)

- Bitkom Schatten-KI (Okt. 2025): bitkom.org -- 8% weit verbreitete private KI-Nutzung

- Horváth-Studie (Jan. 2026): horvath-partners.com -- Mittelstand investiert 30% unter Marktdurchschnitt

- Taste/Spec/Evaluation-Framework: Eingeführt in dekodiert #2: "Wer spezifiziert hier eigentlich?"

- Shrivu Shankar: "Move Faster" (blog.sshh.io, 2026-01-25) — "Work on the derivative, not the function", "Tax the debate"

- Nate B. Jones: "Trust as Infrastructure" (natesnewsletter.com, 2026-02-01) — Integration Gap, $4,5T nur bei effektiver Implementierung

Praktischer Test zum Essay

Drei Vorlagen für ein Gespräch mit einer KI: Ziel klären, Widersprüche prüfen, Delegierbarkeit testen. Du bekommst keine fertige Strategie und keine Tool-Empfehlung.

Vorlagen öffnen