Die teuerste Verwechslung: Aufgaben und Stellen

Vier von zehn Unternehmen haben wegen KI Stellen gestrichen. Mehr als die Hälfte bereut es. Ein Drittel hat die Entlassenen wieder eingestellt – und dafür mehr bezahlt als die Einsparung gebracht hat. Die Daten zeigen ein Muster, das teurer ist als jede Fehlentscheidung bei der Tool-Auswahl: Unternehmen analysieren auf Aufgabenebene und entscheiden auf Stellenebene. Die Analyse stimmt meistens. Die Entscheidung nicht.

Worauf der Text hinauswill, ist deshalb nicht nur Kritik an voreiligen Entlassungen. Er will eine begriffliche Verwechslung geradeziehen, die gerade in vielen Unternehmen teuer wird. Wenn ihr AI sinnvoll einführen wollt, reicht es nicht, Aufgaben sauber zu zerlegen. Ihr müsst verstehen, was eine Stelle jenseits ihrer sichtbaren Aufgaben eigentlich zusammenhält.

1.000 Business Leaders, eine Erkenntnis

Die Orgvue-Studie hat 1.000 Business Leaders befragt. Die Zahlen sind eindeutig.

Bleib auf dem Laufenden

Erhalte eine Nachricht, wenn ein neuer Essay erscheint. Jederzeit abbestellbar.

Vier von zehn Entscheidern haben wegen AI Stellen abgebaut. 55% bereuen die Entscheidung. 35,6% haben mehr als die Hälfte der Entlassenen wieder eingestellt. Ein Drittel hat für die Wiedereinstellung mehr ausgegeben als die Einsparung gebracht hat. Das sind keine Einzelfälle. Das sind Datenpunkte in einem Muster, das sich quer durch die Industrie zieht.

Und es wiederholt sich mit anderen Zahlen aus anderen Quellen.

Thomas Davenport von Babson und MIT hat für die Harvard Business Review 1.006 globale Executives befragt. 60% haben Headcount wegen AI-Potenzial reduziert. Nicht wegen tatsächlicher AI-Implementierung. Das waren 2%. Zwei Prozent. Die restlichen 58 Prozentpunkte haben auf ein Versprechen hin gekürzt. Das ist, als würde man das Lager räumen, bevor die neue Lieferkette steht. Theoretisch kommt alles pünktlich. Praktisch steht man mit leeren Regalen da und ruft den alten Lieferanten an – der jetzt einen Aufschlag berechnet.

Die Washington Times berichtet parallel, dass Unternehmen Customer-Service-Rollen wieder einstellen, die sie durch AI ersetzt hatten. Die AI konnte jede einzelne Anfrage bearbeiten. Jede Aufgabe technisch korrekt gelöst. Ticket auf, Lösung rausgesucht, Ticket zu. Aber sie konnte nicht den Kontext verstehen, in dem die Anfragen entstehen. Nicht erkennen, wann ein verärgerter Kunde kurz vor dem Absprung steht. Nicht sehen, warum dieselbe Beschwerde zum dritten Mal kommt und was das über ein systemisches Prozessproblem sagt, das zwei Abteilungen weiter seinen Ursprung hat. Die Aufgaben liefen. Die Stelle nicht.

Die Reue kommt nicht von der falschen Technologie. Sie kommt von der falschen Granularität.

Die Unternehmen haben auf Aufgabenebene analysiert: Kann ein Agent diese Aufgabe erledigen? Und auf Stellenebene entschieden: Also brauchen wir die Stelle nicht mehr. Die erste Frage war korrekt beantwortet. Die zweite Frage war nie gestellt worden.

Was eine Aufgabe von einer Stelle trennt

Eine Aufgabe dauert zwei Stunden. Eine Stelle dauert 18 Monate. Der Unterschied ist nicht Dauer. Der Unterschied ist Kontext.

Eine Aufgabe hat definierten Input und definierten Output. Sie ist isoliert ausführbar, wiederholbar, standardisierbar. Ein Agent kann sie erledigen – oft schneller und konsistenter als ein Mensch. Das ist der Floor, den ich im letzten Text beschrieben habe. AI hebt den Floor. Jede einzelne Aufgabe wird schneller, billiger, zuverlässiger. Das ist real. Das ist messbar. Das ist der Teil, den alle sehen.

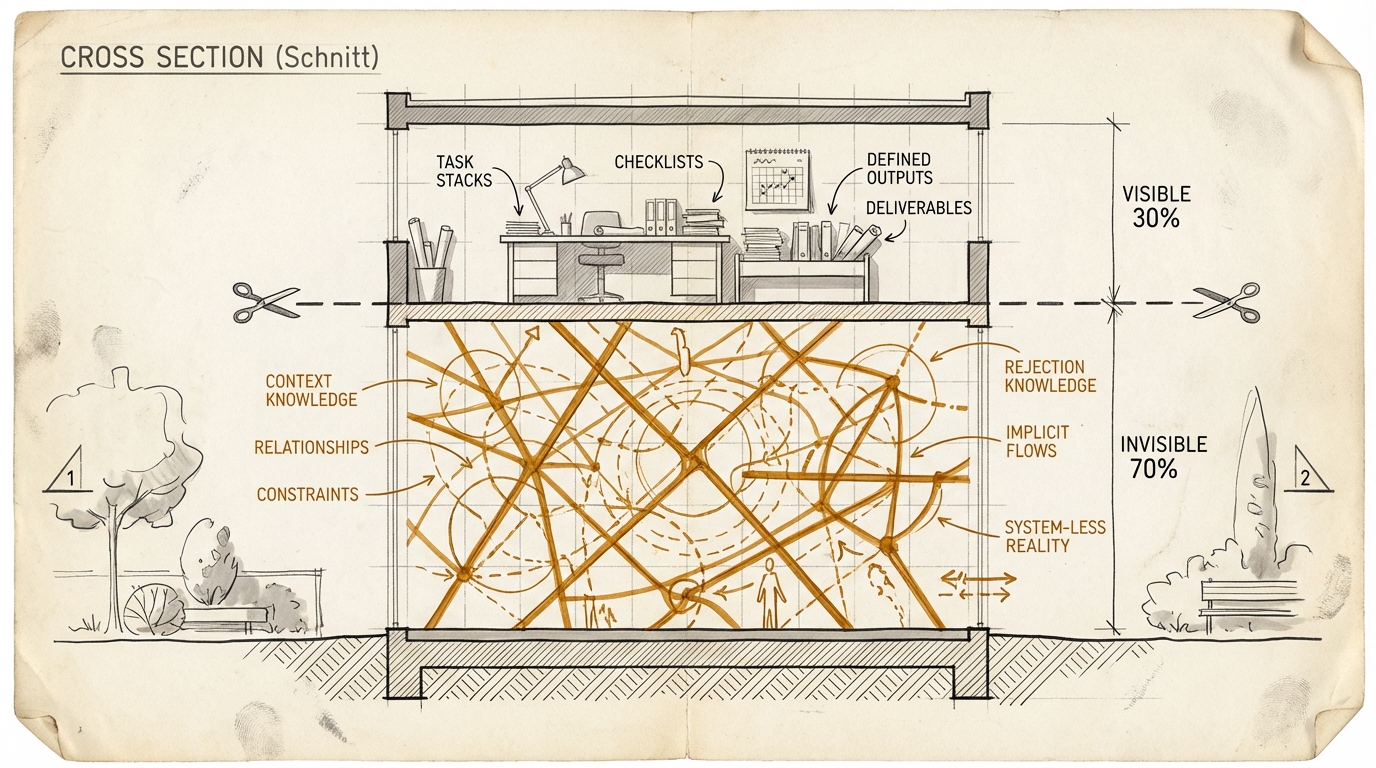

Eine Stelle ist etwas anderes. Und ganz ehrlich: Das wissen wir auch alle. Eine Stelle ist ein Bündel aus Aufgaben, Kontext und Urteil. Die sichtbaren Aufgaben machen vielleicht 30% aus. Die anderen 70% sind unsichtbar, und zwar genau deshalb, weil sie sich nicht in Aufgabenlisten packen lassen. Was zu diesen 70% gehört: Wissen, welche Aufgaben überhaupt stattfinden sollten und welche man besser lässt. Prioritäten setzen, wenn drei dringende Sachen gleichzeitig auf dem Tisch liegen und die vierte noch niemand gesehen hat. Ausnahmen erkennen, die kein Regelwerk abdeckt. Eskalieren, bevor aus einem Problem eine Krise wird. Den organisatorischen Kontext lesen – wer gerade unter Druck steht, welches Projekt politisch heikel ist, warum der Vorstand diese Woche nicht der richtige Adressat für schlechte Nachrichten ist.

Das ist keine Sentimentalität gegenüber menschlicher Arbeit. Das ist eine funktionale Beschreibung dessen, was eine Stelle von einer Aufgabenliste unterscheidet. Aufgaben sind Floor. Jobs sind im besten Fall Ceiling. Ein Agent erreicht den Floor jeder einzelnen Aufgabe. Aber die Job-Ebene – Kontext, Urteil, Priorität – das ist Ceiling. Wer kürzt, kürzt am Ceiling.

Der Einkäufer, der in keinem System steht

Ein Beispiel, das ich in ähnlicher Form in fast jedem Unternehmen sehe.

Nehmt den Einkäufer. Theoretisch könnte ein Agent den Einkauf übernehmen. Bestellungen auslösen, Preise vergleichen, Lieferanten anschreiben, Angebote bewerten, Verträge vorausfüllen – jede einzelne Aufgabe machbar. Teilweise schon heute. Aber der Einkäufer weiß Dinge, die in keinem System stehen.

Er weiß, dass Lieferant B zwar teurer ist, aber bei Eilbestellungen nicht vier Wochen braucht, weil er seit acht Jahren einen direkten Draht zum Disponenten hat. Dass Lieferant A im letzten Quartal dreimal die Spezifikation nicht eingehalten hat, aber nie offiziell reklamiert wurde, weil die Geschäftsführung die Beziehung für ein Joint Venture nächstes Jahr braucht. Dass die neue Kollegin im Qualitätsmanagement strenger prüft als ihr Vorgänger, und man bei bestimmten Teilen lieber den teureren Lieferanten nimmt, bevor es Ärger gibt, der am Ende auf dem Schreibtisch der Geschäftsführung landet.

Das steht in keinem CRM. In keinem ERP. In keinem Wiki. In keinem Confluence-Space. Es steht im Kopf des Einkäufers. Und der ist jetzt weg. Mitsamt allem, was er über die letzten Jahre gelernt aber nie aufgeschrieben hat – weil ihn niemand danach gefragt hat, und weil er keinen Anreiz hatte, sich ersetzbar zu machen.

Knowledge in the Head

Don Norman hat dafür 1988 eine einfache, brauchbare Unterscheidung gebaut: "Knowledge in the Head" und "Knowledge in the World." Im Produktdesign meint das: Gutes Design legt Wissen in die Welt. Schlechteres Design verlangt, dass der Nutzer es im Kopf behält.

Organisationen machen meistens Letzteres.

Das Entscheidende an vielen Stellen sitzt nicht im System, sondern in Köpfen. Terrain-Wissen. Implizite Constraints. Die Intuition dafür, wann ein Prozess gerade noch normal läuft und wann er kippt. Das Zeug, das nie sauber dokumentiert wurde, nie maschinenlesbar gemacht wurde und oft nicht einmal einen Namen hatte.

Wenn die Person geht, geht dieses Wissen mit.

In Text 5 habe ich beschrieben, warum das Externalisieren so selten sauber passiert. Die Anreizstruktur belohnt das Horten von Wissen eher als das Teilen. In Text 7 ging es um das Vokabular dafür: die Rejections, die stillen Nein-Sätze, die impliziten Qualitätsgrenzen. Genau dieses Wissen nehmen die Entlassenen mit.

Und genau deshalb ist die Reuequote so hoch. Die Person ist weg. Das nicht externalisierte Wissen auch.

Die Davenport-Daten verschärfen den Punkt noch. 60% kürzen auf Basis von Potenzial, nicht von Ergebnissen. Viele haben also nicht einmal geprüft, ob der Agent die sichtbaren Aufgaben wirklich übernehmen kann. Sie haben auf ein Versprechen hin die Leute entlassen, die den Kontext kannten. Und als das Versprechen auf die Realität traf, war der Kontext weg.

Warum die Reue kein Zufall ist

Die Ökonomie kennt das Muster seit 1865. William Stanley Jevons zeigte, dass effizientere Dampfmaschinen nicht zu weniger Kohleverbrauch führten, sondern zu mehr. Effizienz machte Kohle billiger, billigere Kohle machte neue Anwendungen rentabel, neue Anwendungen steigerten den Gesamtverbrauch. Das Paradox – Effizienz steigert Gesamtverbrauch – wiederholt sich bei Stahl, Computing, Bandbreite, Software. Dazu übrigens mehr in einer der nächsten Ausgaben, wo ich das Muster ausführlich auf Wissensarbeit anwende.

Hier reicht die kurze Version: Wenn AI die Execution Cost senkt, sinkt nicht der Bedarf an menschlichem Urteil. Er steigt. Weil billigere Execution neue Aufgaben profitabel macht, die vorher niemand angefasst hat. Der Report, der sich vorher nicht gelohnt hat, wird plötzlich machbar. Die Analyse, für die nie Budget da war, kostet jetzt einen Bruchteil. Der Kundensupport, der bisher nur die Top-20-Kunden abdeckte, kann plötzlich alle 200 bedienen. Die Personalisierung, die bisher zu teuer war, lohnt sich auf einmal für jedes Segment.

Mehr Aufgaben, nicht weniger. Und jede neue Aufgabe braucht jemanden, der entscheidet, ob sie stattfinden sollte. Ob sie Priorität hat. Ob sie in den organisatorischen Kontext passt. Ob sie mehr Wert schafft als sie Komplexität erzeugt. Das ist Urteil. Das ist Kontext. Das ist die Stelle, nicht die Aufgabe.

Die Unternehmen, die auf Aufgabenebene kürzen, sehen die Effizienz. Sie übersehen den neuen Bedarf, der aus der Effizienz entsteht. Die 55% Reue sind empirischer Beleg.

Shopify hat das verstanden. Headcount von 11.600 auf 8.100 reduziert – klingt nach klassischer Kürzung. War es teilweise auch. Aber gleichzeitig hat Tobi Lütke 1.000 AI-Centaur-Praktikanten eingestellt. Sein internes Memo war kein Entlassungsschreiben. Es war eine Neudefinition der Arbeit. Die Frage war nicht "wen können wir ersetzen?" Die Frage war: "Welche Aufgaben verschwinden, und welche neuen Stellen entstehen, die es vorher nicht gab?"

Das ist die Aufgaben/Stellen-Unterscheidung in der Praxis. Shopify hat Aufgaben automatisiert und gleichzeitig Jobs neu definiert. Stellen gestrichen, wo nur Aufgaben waren. Stellen geschaffen, wo Kontext und Urteil gebraucht werden – und zwar mehr Kontext und Urteil als vorher, weil die Execution schneller und billiger geworden ist. Die 55%, die ihre Entscheidung bereuen, haben Aufgaben automatisiert und Stellen gestrichen. Ohne den Unterschied gemacht zu haben. Ohne gefragt zu haben, was jenseits der sichtbaren Aufgabe liegt.

Das Bitkom-Paradox und der Betriebsrat als Wettbewerbsvorteil

In Deutschland wird die Sache interessant. Nicht weil die Probleme andere wären. Sondern weil die Rahmenbedingungen eine andere Dynamik erzeugen.

Die Bitkom-Zahlen erzählen drei Geschichten gleichzeitig. 27% der deutschen Unternehmen erwarten Stellenabbau durch KI. Gleichzeitig fehlen 100.000+ IT-Fachkräfte. 42% erwarten, dass KI zusätzlichen Bedarf schafft. Alle drei Aussagen gleichzeitig, alle drei aus derselben Wirtschaft. Das ist kein Widerspruch – das ist das Jevons-Muster in deutschen Zahlen. Stellen verschwinden auf der Aufgabenseite, entstehen auf der Urteilsseite. Wer nur die eine Seite sieht, trifft die falschen Entscheidungen. Wer beide sieht, erkennt einen Umbau, keine Schrumpfung.

Aber hier kommt der Teil, den ich in US-Analysen nie lese. Und der für die DACH-Region den eigentlichen Unterschied macht.

In den USA können Unternehmen schnell kürzen. Hire and fire. Das haben die 55% getan. Die Entscheidung fällt am Montag, am Freitag sind die Leute weg. In Deutschland muss man dem Betriebsrat erklären, welche Aufgaben automatisiert werden und welche Funktionen der Stelle erhalten bleiben. Das zwingt zur Explizitheit. Man muss aufschreiben, was die Person tut. Nicht nur die sichtbaren Aufgaben, die sich auf einer Folie gut machen, sondern auch die unsichtbaren Funktionen, die man erst bemerkt, wenn sie fehlen.

Wer dem Betriebsrat nicht beantworten kann, welche Aufgaben automatisiert werden und welche Stellenfunktionen bleiben, hat die Unterscheidung nicht gemacht. Und der Betriebsrat wird nicht zustimmen. Nicht aus Boshaftigkeit oder Reflexblockade. Zumindest, wenn der BR seinen Job versteht und nicht nur Politik betreibt. Sondern weil die Frage berechtigt ist und die Antwort fehlt.

Das ist unbequem. Es ist langsamer. Es kostet Stunden in Verhandlungen, die sich anfühlen wie Bürokratie. In denen jemand Fragen stellt, die man lieber nicht beantworten würde, weil die ehrliche Antwort wäre: "Wir haben nicht genau hingeschaut."

Und es ist genau die Analyse, die in den USA übersprungen wird – und die dort zur 55%-Reue führt.

Durch Normans Brille betrachtet: Der Betriebsratsprozess zwingt Unternehmen, "Knowledge in the Head" zumindest zu benennen. Aufzuschreiben, welches Wissen mit einer Person gehen würde. Welche Kontextfunktionen die Stelle hat, die über die sichtbaren Aufgaben hinausgehen. In den USA entfällt dieser Schritt. Die Kündigung geht schneller. Die Reue kommt schneller. Und die Wiedereinstellung mit Aufschlag ist teurer als jede Verhandlung mit dem Betriebsrat je gewesen wäre.

Wer den Betriebsrat als Bremse sieht, versteht nicht, dass die Bremse vor der Klippe schützen kann. Mitbestimmung kann die Aufgaben/Stellen-Unterscheidung erzwingen, die man sonst bequem überspringt. Kann (vorausgesetzt der BR blockiert nicht aus Prinzip) eine Versicherung gegen Reue sein. Und die Orgvue-Daten zeigen den Preis des Überspringens: Mehr als die Hälfte bereut es, ein Drittel zahlt mehr als vorher.

Ehrlichkeitstest: Wo ich falsch liegen könnte

Drei Punkte, die gegen mein eigenes Argument sprechen. Ich nehme sie ernst.

Erstens: Nicht jede Kürzung ist ein Fehler. 40-60% der aktuellen Aufgaben sind automatisierbar. Das ist eine konservative Schätzung, keine Panikmache. Manche Rollen waren reiner Koordinations-Overhead – sie existierten nur, weil die Kommunikation zwischen zwei Teams nicht funktionierte oder weil ein Prozess nie sauber aufgesetzt wurde. Wenn ein Tool diese Kommunikation ersetzt oder den Prozess überflüssig macht, war die Rolle tatsächlich überflüssig. Nicht jede Stelle hat verborgene Kontextfunktionen. Manche Stellen waren ehrlich gesagt nur Aufgaben in einem Arbeitsvertrag. Die Unterscheidung zwischen Aufgaben und Stellen bedeutet nicht, dass jede Stelle mehr ist als ihre Aufgaben. Es bedeutet, dass man hinschauen muss, bevor man entscheidet.

Zweitens: Timing-Unsicherheit. Wie schnell Agents von der Aufgabenebene zur Stellenebene kommen, ist unklar. Die Modelle werden schneller, kontextbewusster, fähiger. Was heute menschliches Urteil erfordert, könnte in zwei Jahren Agent-Routine sein. Wenn es schneller geht als erwartet, waren manche der "voreiligen" Kürzungen doch richtig. Wer heute sagt "Agents können keine Stellen ersetzen", muss bereit sein, diese Aussage in 18 Monaten zu korrigieren. Ich bin bereit. Aber Stand heute sind wir nicht da.

Drittens: Survivorship Bias in den Daten. Die Orgvue-Studie fragt die, die bereuen. Nicht die, die erfolgreich gekürzt haben und nichts bereuen. Die 55% sind real, aber sie sind nicht die ganze Geschichte. Es gibt Unternehmen, die Aufgaben automatisiert, Stellen gestrichen und richtig damit gelegen haben. Die tauchen seltener in Studien auf, weil "es hat funktioniert" keine Schlagzeile ist und keine Befragung auslöst.

Aber – und das ist der Punkt, an dem mein Argument trotz allem steht – die Kosten des Irrtums sind asymmetrisch. Zu spät automatisieren kostet Effizienz. Zu früh entlassen kostet Kontext. Effizienz lässt sich nachholen. Ein Tool-Rollout, der sechs Monate später startet, ist ärgerlich, aber reparierbar. Kontext nicht immer. Die Entlassenen kommen vielleicht zurück. Ihr Wissen kommt nicht vollständig mit. Wer drei Monate raus war, hat drei Monate organisatorischen Kontext verpasst – Entscheidungen, die er nicht mitbekommen hat, Beziehungen, die sich verschoben haben, Projekte, die in eine andere Richtung gelaufen sind. Wer sechs Monate raus war, muss das Terrain neu lernen. Und manches Terrain-Wissen baut sich nicht in Monaten auf, sondern in Jahren.

Die asymmetrischen Kosten machen die Reihenfolge klar: Externalisieren, dann automatisieren, dann – wenn nötig – kürzen. Nicht umgekehrt.

Was das für euch heißt

Ich sehe in solchen Gesprächen fast immer dieselbe Reihenfolge. Erst kommt die Frage: Wen können wir ersetzen? Die andere Frage kommt gar nicht oder sehr spät: Was verlieren wir, wenn diese Person geht?

Wenn ihr vor einer AI-getriebenen Personalentscheidung steht, würde ich drei Fragen vor die Kürzung setzen. Nicht danach.

Die Aufgaben/Stellen-Unterscheidung explizit machen

Bevor eine Stelle gestrichen wird: Welche Aufgaben sind automatisierbar? Welche Kontextfunktionen gehen mit der Person verloren? Was steht in keinem System? Genau diesen Schritt haben die 55% übersprungen. Wer einem Betriebsrat diese Fragen nicht beantworten kann, hat die Analyse nicht gemacht. Und wer keinen Betriebsrat hat, hat trotzdem keine Ausrede, sie zu überspringen.

Die unsichtbaren 70% benennen

Die wertvollste Funktion vieler Stellen ist nicht die sichtbare Aufgabe. Es ist die unsichtbare Kontextarbeit: erkennen, wann eine Regel nicht gilt. Merken, wenn ein Prozess gerade in die falsche Richtung läuft. Die richtigen Leute anrufen, bevor aus einem Problem eine Krise wird. Sehen, dass ein Kunde nicht über den Fehler wütend ist, sondern darüber, dass ihm niemand zuhört. Genau dort liegt der Unterschied zwischen einer erledigten Aufgabe und einer funktionierenden Stelle.

Externalisierung vor Entlassung

Bevor jemand geht, dessen Rolle man automatisieren will: Ist sein Wissen irgendwo außerhalb seines Kopfes gelandet? Ist dokumentiert, warum Lieferant B trotz höherem Preis oft die bessere Wahl ist? Ist festgehalten, welche Ausnahmen es gibt, welche stillen Qualitätsgrenzen gelten, welche Risiken intern jeder kennt, aber nie sauber aufgeschrieben wurden?

Das klingt nach gesundem Menschenverstand. Ist es auch. Wird trotzdem oft übersprungen, weil Kürzung in der nächsten Quartalspräsentation schneller sichtbar ist als die mühsame Arbeit, Wissen aus Köpfen in Systeme zu bringen.

Die eigentliche Frage

Die Orgvue-Studie, Davenport, die Bitkom-Zahlen und die Wiedereinstellungen im Customer Service zeigen im Kern dasselbe: Die Technologie funktioniert. Auf Aufgabenebene.

Die eigentliche Frage ist eine andere. Haben Unternehmen verstanden, was sie verlieren, wenn sie aus einer automatisierbaren Aufgabe direkt auf eine entbehrliche Stelle schließen?

55% haben diese Frage offenbar zu schnell beantwortet. Nicht weil die Technologie schlecht wäre. Sondern weil sie auf der falschen Ebene entschieden haben. Sie haben das Sichtbare bewertet und das Unsichtbare mitgekündigt.

Der Agent kann die Aufgabe. Die Stelle ist etwas anderes. Wer diesen Unterschied vor der Kürzung nicht sauber macht, zahlt ihn später zurück. Mit Aufschlag.

Die Denkwerkzeuge zu diesem Text helfen euch, die Aufgaben/Stellen-Unterscheidung in der eigenen Organisation durchzuführen. Der Aufgaben/Stellen-Separator, das Knowledge-in-the-Head Audit und die Externalisierungs-Checkliste sind drei Prompts, die ihr auf eure Situation anwenden könnt. Zu den Denkwerkzeugen

Neue Ausgaben direkt per Mail? Newsletter abonnieren

Direkt anwenden

Dieses Prompt Kit übersetzt die Konzepte des Essays in konkrete Prompts, die du sofort nutzen kannst.

Zum Prompt Kit