Warum AI-Tools scheitern – und wo der Hebel liegt

Der Engpass ist nicht die Software. Es ist das Wissen, das nur in Köpfen existiert.

Zehn Leute im Meeting, alle reden über dasselbe Projekt, und nach einer Stunde stellt sich raus: Drei verschiedene Versionen der Anforderungen waren im Raum, aber auf keinem Bildschirm. Das war schon immer teuer. In einer Welt, in der AI-Agenten auf genau diese Anforderungen angewiesen sind, wird es richtig teuer. Denn der Agent kann nicht nachfragen. Er arbeitet mit dem, was da steht. Und was bei den meisten Organisationen da steht, ist: erstaunlich wenig.

Bleib auf dem Laufenden

Erhalte eine Nachricht, wenn ein neuer Essay erscheint. Jederzeit abbestellbar.

Kennt ihr dieses Meeting.

Strategierunde, zehn Leute, das Vierteljahres-Review. Der Vertriebschef sagt: "Wir müssen die Sonderpreise für die Großkunden überarbeiten." Der CFO fragt: "Welche Sonderpreise?" Marketing sagt: "Ich dachte, wir hätten das im Q2 standardisiert." Und irgendwann sagt jemand den Satz, der jedes dritte Strategiemeeting zusammenfasst: "Moment – reden wir gerade über dasselbe?"

Nein. Tun sie nicht. Und die nächste halbe Stunde geht nicht für die Entscheidung drauf, sondern dafür, dass alle den gleichen Stand haben. Wer hat was mit welchem Kunden vereinbart. Was davon steht im CRM. Was davon steht in Müllers Kopf.

Und nein: das ist kein Kommunikationsproblem. Das ist ein Kontextproblem.

Tobi Lütke, ja der Tobi Lütke, der Shopify gebaut hat, 75 Milliarden Marktkapitalisierung, hat das bei Acquired auf den Punkt gebracht. Was die meisten Unternehmen "Politik" nennen, sei in Wahrheit etwas Banaleres: vergrabene Meinungsverschiedenheiten über Annahmen, die niemand explizit gemacht hat. Weil Menschen, so Lütke, "schlampige Kommunikatoren sind, die sich auf gemeinsamen Kontext verlassen, der gar nicht existiert."

Das klingt nach Silicon-Valley-CEO, der über Meetings philosophiert.

Ist es nicht.

Es beschreibt genau das, was in deutschen Unternehmen jeden Tag passiert. Und es beschreibt, warum die meisten AI-Investitionen nicht das liefern, was man sich davon versprochen hat. Nicht weil die Tools schlecht sind. Sondern weil der Kontext, den die Tools brauchen, nicht existiert. Nicht für die Maschine. Und, wenn wir mal ehrlich sind, auch nicht wirklich für die Menschen.

Im letzten Text habe ich beschrieben, wie das nach außen wirkt. mobile.de ohne API, "Preis auf Anfrage" als Geschäftsmodell, Branchen, deren Marge auf Informationsasymmetrie baut. Die Pointe, die ich damals nicht geschrieben habe: Dasselbe Muster existiert in jedem Unternehmen. Nur nicht als bewusste Strategie. Sondern als Betriebssystem, das niemand hinterfragt.

Die These: Der Engpass ist nicht das AI-Tool. Der Engpass ist, dass institutionelles Wissen nicht maschinenlesbar vorliegt. Wer seinen Kontext nicht strukturiert, kann Tools einkaufen so viel er will – die Maschine arbeitet trotzdem im Blindflug.

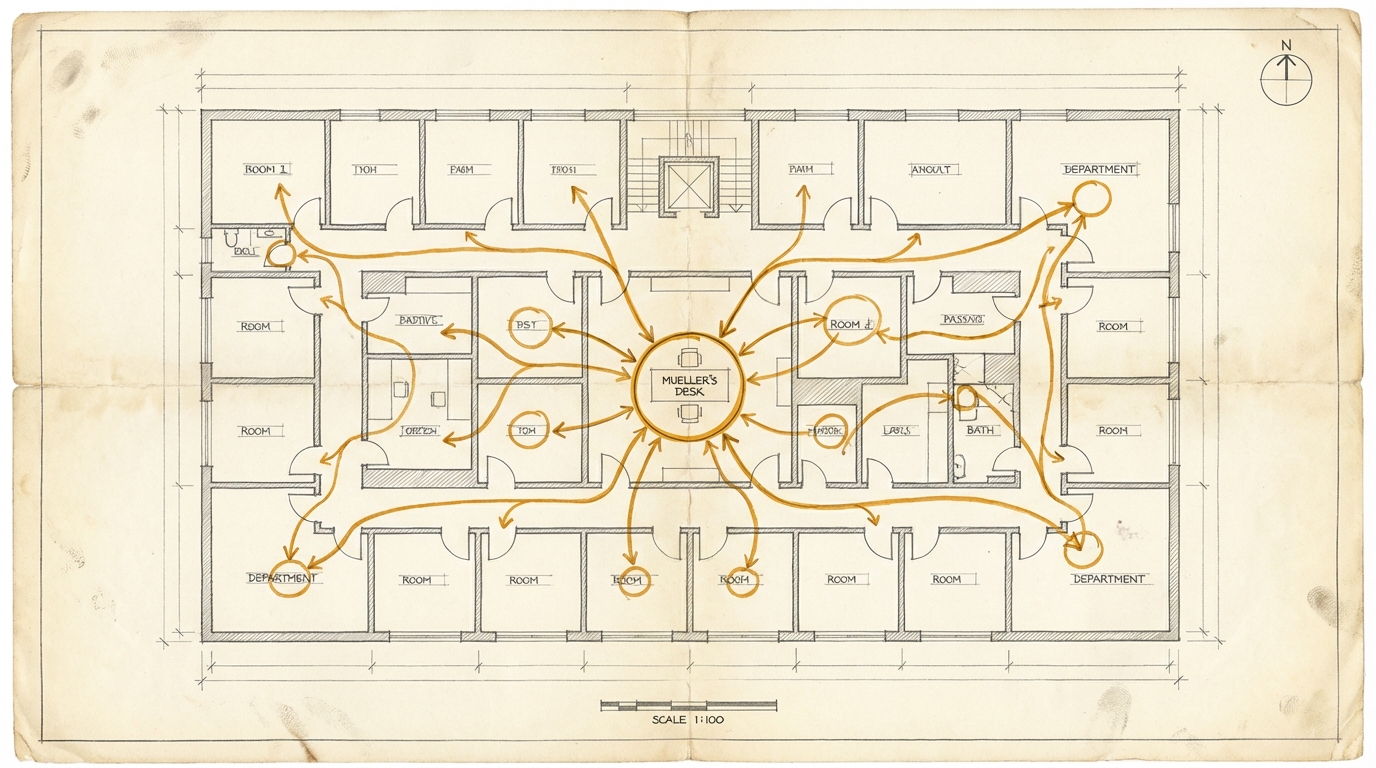

Frag den Müller

Jedes Unternehmen hat einen Müller. Manchmal heißt er anders, aber die Rolle ist dieselbe: der Mensch, in dessen Kopf das Wissen steckt, das nirgendwo sonst steht.

Nehmt die Angebotskalkulation. In den meisten Unternehmen gibt es eine Preisliste. Die ist offiziell und steht im ERP. Und dann gibt es die echte Preislogik. Kunde A bekommt 12%, weil das historisch so gewachsen ist. Kunde B bekommt Sonderkonditionen auf Produkt C, weil der Müller das 2019 mit dem Einkaufsleiter ausgehandelt hat und der deal sonst geplatzt wäre. Bei Eilaufträgen gibt es einen Aufschlag, aber nicht bei allen, und wie hoch der ausfällt, hängt davon ab, wer fragt und wie die Auslastung gerade aussieht.

Das steht in keinem System. Das steht in Müllers Kopf.

Und solange der Müller da ist, funktioniert das. Seit Jahrzehnten. Jeder weiß, wen man anruft. Der Prozess ist unsichtbar, aber er läuft.

Dann geht der Müller in Urlaub.

Und plötzlich schickt der Vertrieb Standardpreise an Kunde A. Kunde A ruft an und fragt, was das soll. Oder der Vertrieb ruft den Müller auf Mallorca an, weil kein anderer die Sonderkonditionen kennt. Oder, das ist der häufigste Fall, es passiert einfach nichts, und der Auftrag wartet zwei Wochen.

Das kennt jeder Unternehmer. Und jeder weiß, dass es ein Problem ist. Aber es "funktioniert ja irgendwie."

Jetzt bringt man einen AI-Agenten ins Spiel. Der soll Angebote vorbereiten, Kundenanfragen priorisieren, den Vertrieb entlasten. Guter Use Case. Budget genehmigt. Tool eingekauft.

Ergebnis: "Liefert irgendwie nicht."

Natürlich nicht. Der Agent hat keinen Zugriff auf Müllers Kopf. Er hat die Preisliste im ERP. Er hat keine Ahnung von den Sonderkonditionen, der Kundenhistorie, den ungeschriebenen Regeln. Er bekommt dasselbe wie der neue Mitarbeiter am ersten Tag: die offizielle Version. Und die offizielle Version ist bestenfalls die halbe Wahrheit.

Das Muster dahinter

Die Angebotskalkulation ist nur das sichtbarste Beispiel. Das Muster ist überall.

Brand Guidelines. Stehen in einem PDF, das 2021 erstellt wurde. Die aktuelle Interpretation kennt die Kollegin aus dem Brand-Team. Wenn ein AI-Agent einen Entwurf bauen soll, der "nach eurer Marke aussieht", bekommt er das PDF. Was er nicht bekommt: die zwanzig impliziten Entscheidungen, die zwischen PDF und aktuellem Auftritt stehen.

Prozesswissen. Confluence-Seiten von 2019. "Das machen wir jetzt anders, aber die Doku hat niemand aktualisiert." Ich habe noch kein Unternehmen gesehen, dessen Prozessdokumentation den aktuellen Stand abbildet. Nicht eines.

Produktkataloge. SAP-Exporte, die ein Mensch interpretieren muss. Technische Datenblätter in Formaten, die kein Agent konsumieren kann. Konfigurationslogik, die in den Köpfen der Produktmanager lebt.

Entscheidungslogik. "Ab welchem Wert brauchen wir die Freigabe vom Geschäftsführer?" Offiziell: 50.000 Euro. Inoffiziell: Kommt drauf an, wer der Kunde ist, wie das Quartal läuft und ob der Geschäftsführer gerade Lust auf Diskussion hat.

All das ist institutioneller Kontext. Und er ist für Maschinen unsichtbar.

Was Lütke für Meetings beschreibt, gilt für die gesamte Wissensinfrastruktur eines Unternehmens. Euer internes Wissen funktioniert wie "Preis auf Anfrage." Für Menschen navigierbar. Für Maschinen nicht existent.

Der Kontext ist 99,98%

Nate B. Jones hat das, was die meisten Leute "Prompting" nennen, in vier Disziplinen zerlegt. Die Unterscheidung ist nützlich, weil sie zeigt, wo der eigentliche Hebel liegt.

Stufe 1: Prompt Craft. Die Anweisung selbst. "Schreib mir ein Angebot für Kunde X." Das ist der Teil, über den alle reden. Es ist auch der Teil, der am wenigsten zählt.

Stufe 2: Context Engineering. Die gesamte Informationsumgebung, in der die Anweisung operiert. System Prompts, Dokumente, Datenquellen, Tool-Definitionen, Speicher. Alles, was das Modell "sieht", bevor es antwortet.

Stufe 3: Intent Engineering. Ziele, Werte, Entscheidungshierarchien – in Infrastruktur kodiert, nicht in einzelne Prompts.

Stufe 4: Specification Engineering. Dokumente, gegen die autonome Agenten über längere Zeiträume arbeiten können. Nicht Anweisungen für eine Aufgabe, sondern Leitplanken für einen Prozess.

Die Zahlen sind ernüchternd. Ein Prompt hat vielleicht 200 Tokens. Das Kontextfenster eines modernen Modells fasst eine Million. Der Prompt ist 0,02% dessen, was das Modell sieht. Die anderen 99,98% sind Context Engineering.

Die meisten Unternehmen optimieren auf Stufe 1. Sie schicken ihre Leute in Prompt-Workshops. Sie kaufen Prompt-Templates. Sie diskutieren, ob man "Bitte" sagen soll oder nicht.

Der Hebel liegt auf Stufe 2. Und Stufe 2 ist kein Prompt-Problem. Stufe 2 ist ein Organisationsproblem. Es geht darum, institutionelles Wissen so zu strukturieren, dass ein AI-Agent damit arbeiten kann. Das ist keine Technologie-Frage. Das ist eine Frage danach, wie gut eine Organisation weiß, was sie weiß – und wo sie es aufbewahrt.

Ein Beispiel, das man sehen kann

Design Systems sind das greifbarste Beispiel für dieses Muster, weil man das Ergebnis sofort sieht.

Ein wirklich definiertes Design System ist am Ende ein Satz von Regeln und Kombinatorik. Tokens, Skalen, Spacing-Logik, Komponentenhierarchien. Deklarativ von Natur aus. Ausdrückbar in Code, in JSON, in einem Spec-Dokument. Die visuelle Darstellung, die Figma-Datei, das PDF, der Style Guide, ist eine Ansicht des Systems. Nicht das System selbst.

Teams, deren Design System in Code lebt, zeigen einen AI-Agenten auf das Repository und bekommen in Stunden einen funktionierenden Prototypen, der nach der Marke aussieht.

Teams, deren Design-Wissen nur in Figma-Dateien, PDFs oder im Kopf der Designerin lebt, verbringen die ersten 40% jedes Projekts damit, die Marke zu rekonstruieren. Oder die letzten 70%, wenn sie es erst tun, nachdem die AI den Prototypen produziert hat.

Dasselbe Muster. Strukturierter Kontext beschleunigt. Unstrukturierter Kontext erzeugt Reibung. Und diese Reibung wird mit jedem AI-Tool teurer, nicht billiger.

Ehrlichkeitstest: Warum das schwieriger ist als es klingt

Drei ehrliche Einschränkungen. Und eine, die selten benannt wird.

Nicht alles lässt sich explizit machen. In Text #2 habe ich über Taste geschrieben – das Urteilsvermögen, das sich nicht in Regeln fassen lässt. Wann man dem Kunden entgegenkommt, obwohl die Zahlen dagegen sprechen. Wann ein Lieferant schummelt. Wann ein Angebot zu billig ist, um seriös zu sein. Das ist per Definition das, was sich der Formalisierung entzieht. Die Frage ist nicht "kann man alles strukturieren?" Sondern: Welche 80% kann man strukturieren, die heute bei 0% liegen? Damit menschliches Urteil sich auf die 20% konzentrieren kann, die es wirklich brauchen.

Die Investition ist real. Institutionelles Wissen zu strukturieren ist Arbeit. Das ist kein Wochenend-Projekt, kein AI-One-Shot. Es erfordert Entscheidungen: Was ist kanonisch? Wer pflegt es? In welchem Format? Und es ist unklar, ob AI-Tools diese Strukturierung bald selbst übernehmen – was die Investition teilweise entwerten würde. Kein Grund, nichts zu tun. Aber ein Grund, klein anzufangen.

Das Timing ist unsicher. Context Engineering als Disziplin und Begriff ist sechs Monate alt. Die Infrastruktur verändert sich schnell. Was heute aufwändig ist, könnte in einem Jahr ein Commodity-Service sein.

Und dann ist da die Müller-Frage.

Wenn ihr Müllers Wissen maschinenlesbar macht – wozu braucht ihr dann den Müller?

Das ist keine zynische Frage. Das ist die Frage, die sich der Müller selbst stellt. Und sie ist berechtigt.

Stellt euch vor, ihr sagt dem Müller: "Wir wollen dein Wissen über die Sonderkonditionen dokumentieren, damit ein AI-Agent damit arbeiten kann." Was der Müller hört: "Wir wollen dein Wissen absaugen, und wenn wir es haben, brauchen wir dich nicht mehr."

Das ist menschlich. Und verständlich. Und es ist der Grund, warum die meisten Wissensmanagement-Initiativen scheitern. Nicht an der Technik, sondern am Vertrauen.

Der Denkfehler liegt woanders. Was maschinenlesbar gemacht werden kann, sind die 80% Routine-Entscheidungen, die der Müller im Autopilot trifft. Die 12%-Rabatt-Regel für Kunde A. Das Wissen, welcher Lieferant bei Eilbestellungen zuverlässig ist. Die Freigabelogik für Sonderanfragen. Das ist wertvoll, aber es ist kodifizierbar.

Was NICHT maschinenlesbar ist: Müllers Urteilsvermögen bei den Ausnahmen. Wann man die 12% auf 15% hochsetzt, weil der Kunde gerade einen schwierigen Transformationsprozess durchmacht und man ihn halten will. Wann ein neuer Lieferant trotz guter Zahlen nicht vertrauenswürdig ist. Wann man die Freigabe-Schwelle ignoriert, weil die Chance einmalig ist. Das ist Taste. Das ist das, was durch Erfahrung entsteht und sich nicht in Regeln pressen lässt.

Solange der Müller seine Zeit damit verbringt, Routine-Anfragen zu beantworten, die auch ein dokumentierter Prozess beantworten könnte, verschwendet das Unternehmen seinen wertvollsten Mann auf seine billigste Arbeit.

Der Müller wird nicht ersetzt. Der Müller wird freigestellt für das, wofür man ihn eigentlich bezahlt: die schwierigen Entscheidungen. Die Ausnahmen. Das Urteil.

Aber das muss aktiv begleitet werden. Kein Unternehmer kann zum Müller gehen und sagen "wir machen dein Wissen maschinenlesbar" ohne zu erklären, was das für den Müller bedeutet. Das ist ein Führungsthema, kein IT-Projekt. Der Müller muss verstehen: Sein Wert liegt nicht in der Routine. Sein Wert liegt im Urteil. Und das Unternehmen braucht ihn für das Urteil, nicht für die Routine.

Wer das versäumt, bekommt keine Kooperation. Wer das leistet, bekommt einen Müller, der wertvoller ist als vorher.

Wo steht ihr?

Eine ehrliche Selbstdiagnose in vier Stufen.

| Stufe | Beschreibung | Typischer Zustand |

|---|---|---|

| 0 – Stammeswissen | "Frag den Müller" | Wissen in Köpfen, nicht dokumentiert |

| 1 – Dokumentiert | Confluence, PDFs, Slide-Decks | Existiert, aber für Menschen, nicht für Maschinen |

| 2 – Strukturiert | Design Tokens, JSON, APIs, CRM-Felder | Maschinenlesbar, aber nicht integriert |

| 3 – Integriert | Context Engineering: System Prompts, Tool-Anbindungen, strukturierte Wissensdatenbanken | AI-Agenten können autonom damit arbeiten |

Die meisten Organisationen sind auf Stufe 0 bis 1. Glauben aber, sie seien auf Stufe 2, weil sie Confluence haben.

Der Unterschied zwischen Stufe 1 und Stufe 2 klingt klein. Er ist es nicht. Stufe 1 heißt: Ein Mensch kann die Information finden und interpretieren. Stufe 2 heißt: Eine Maschine kann sie konsumieren, ohne dass ein Mensch übersetzt. Das ist der Unterschied zwischen "Preis auf Anfrage" und einer API.

Und der Unterschied zwischen Stufe 2 und Stufe 3 ist der Schritt, den fast niemand gemacht hat: Das strukturierte Wissen so in die AI-Infrastruktur einbinden, dass Agenten es im Arbeitsfluss nutzen können. Nicht als Nachschlagewerk, sondern als operativen Kontext.

Was das für euer Unternehmen heißt

Drei Fragen, die mehr bringen als ein weiterer AI-Workshop.

Erstens: Wo ist euer Müller?

Nehmt einen Prozess, von dem jeder im Unternehmen weiß, dass er von einer Person abhängt. Angebotskalkulation, Reklamationsbearbeitung, Lieferantenbewertung – egal welcher. Fragt: Was passiert, wenn diese Person morgen vier Wochen fehlt? Welches Wissen steckt in diesem Kopf, das nirgendwo sonst steht? Was davon ist Routine (kodifizierbar) und was ist Urteil (menschlich)? Das ist eure Context Gap. Und das ist der Ort, wo ein AI-Agent den größten Hebel hätte – wenn er den Kontext bekäme.

Zweitens: Die Lütke-Frage für jedes Meeting.

Nehmt euer letztes internes Briefing oder Strategiepapier. Fragt: Wie viel Kontext fehlt, den "jeder weiß", aber den ein neuer Mitarbeiter nicht wüsste? Oder ein AI-Agent? Wenn die Antwort "eigentlich eine ganze Menge" ist, habt ihr kein AI-Problem. Ihr habt ein Kontext-Problem, das durch AI sichtbar wird.

Die Disziplin, Probleme mit genug Kontext zu formulieren, dass sie ohne Rückfragen lösbar sind, hat Lütke nicht zu einem besseren AI-Nutzer gemacht. Sondern zu einem besseren CEO. Weil dieselbe Klarheit, die einen AI-Agenten funktionieren lässt, auch menschliche Zusammenarbeit verbessert.

Drittens: Klein anfangen. Ein Prozess. Nicht die ganze Organisation.

Nehmt den Prozess aus Frage eins. Dokumentiert das Wissen so, dass ein AI-Agent damit arbeiten kann. Nicht als Mega-Projekt, nicht als "Wissensmanagement-Initiative", nicht als Foliensatz für den Vorstand. Sondern als Test: Können wir Müllers Routine-Wissen so strukturieren, dass ein Agent die Standard-Anfragen bearbeiten kann? Wenn ja, habt ihr einen Proof of Concept. Wenn nein, wisst ihr, woran es wirklich liegt. Und es ist nicht das Tool.

Die Denkwerkzeuge zu diesem Text helfen euch, eure eigene Kontext-Landschaft zu kartieren. Der Müller-Finder, der Context-Gap-Stresstest und die Lütke-Frage sind drei Gesprächsformate, die ihr mit der KI eurer Wahl auf die eigene Situation anwenden könnt. Zu den Denkwerkzeugen →

Was Unternehmen "Politik" nennen, ist oft schlechtes Context Engineering. Was sie "Figma-Code-Integration" nennen, ist oft eine fehlende Source of Truth. Und was sie "AI-Strategie" nennen, ist oft Tool-Shopping, ohne den Kontext gebaut zu haben, den die Tools brauchen.

Die Maschinen lassen uns nicht mehr faul sein. Aber das, was sie erzwingen, Explizitheit, Struktur, dokumentierte Entscheidungen, war schon immer das, was gute Organisationen von mittelmäßigen unterschieden hat.

Die AI zeigt euch nicht, was ihr nicht habt. Sie zeigt euch, was ihr nicht aufgeschrieben habt. Und das ist meistens mehr, als jemand zugeben möchte.

Direkt anwenden

Dieses Prompt Kit übersetzt die Konzepte des Essays in konkrete Prompts, die du sofort nutzen kannst.

Zum Prompt Kit