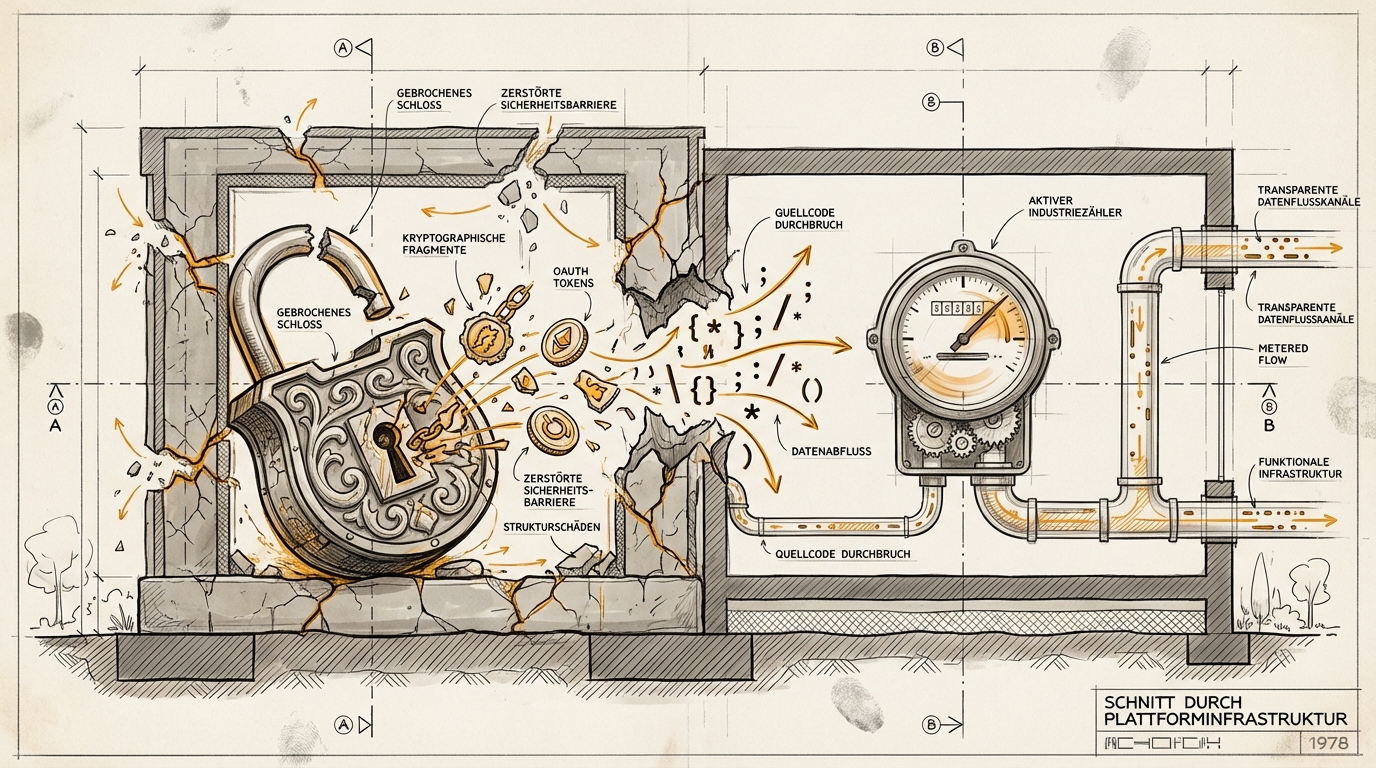

Vom Schloss zum Zähler

paddo.dev hat diese Woche die Chronologie aufgeschrieben, die in der AI-Branche gerade leise Schule macht: Wie Anthropic in vier Monaten drei Durchsetzungsstrategien verbrannt hat, bevor sie auf die einzige landeten, die funktioniert.

Die Kurzfassung: Im Januar schaltete Anthropic um 2 Uhr nachts die OAuth-Tokens ab, über die Third-Party-Clients wie OpenClaw auf Claude-Subscriptions zugreifen konnten. Keine Vorwarnung, keine Alternative, keine Erklärung. Danach kamen Abmahnungen, dann ein Source-Code-Leak (512.000 Zeilen TypeScript, inklusive der kryptografischen Attestation), und erst jetzt, im April: ein transparentes Abrechnungsmodell mit Übergangs-Credits und Rabatten.

Bleib auf dem Laufenden

Erhalte eine Nachricht, wenn ein neuer Essay erscheint. Jederzeit abbestellbar.

Anthropics Mail an die betroffenen Subscriber, heute auf Hacker News geteilt, liest sich wie eine Fallstudie in Tonalitätswechsel:

"Your subscription still covers all Claude products, including Claude Code and Claude Cowork. To keep using third-party harnesses with your Claude login, turn on extra usage for your account."

Und dann der Satz, der die eigentliche Strategieänderung verrät:

"Capacity is a resource we manage carefully and we need to prioritize our customers using our core products."

Nutzt welchen Client ihr wollt. Bezahlt, was ihr verbraucht.

Vier Monate, vier Eskalationsstufen. Jeder Fehlschlag erzwang den nächsten Versuch.

Was paddo beschreibt, ist kein Anthropic-Problem. Es ist ein Architektur-Problem. Und es taucht überall auf, wo Organisationen versuchen, Verhalten durch Erkennung und Sperrung zu steuern statt durch ökonomisches Design.

Die Januar-Sperre war ein klassischer Phase-1-Reflex: Gleicher Prozess (Subscription), neues Werkzeug (technische Blockade). Der Denkfehler: Wenn der Schutzmechanismus auf Geheimhaltung basiert (kryptografische Attestation im Client-Code), reicht ein einziger Leak, um ihn wertlos zu machen. Und Leaks passieren. Der npm-Build-Unfall vom 31. März hat nicht nur Code exponiert, sondern Anthropics gesamte Durchsetzungsarchitektur.

Was danach kam, war der erzwungene Wechsel von "Schloss" zu "Zähler". Nicht mehr fragen: Wer bist du? Sondern: Was verbrauchst du? Der Zähler funktioniert, weil er vom Client unabhängig ist. OpenClaw, Claude Code, ein selbstgebauter Wrapper: irrelevant. Die Ressource ist die Ressource, egal wer sie aufruft.

Das Pattern dahinter kennt jeder, der schon mal eine Content-Strategie, einen API-Zugang oder eine interne Tool-Policy verantwortet hat:

Strategie 1: Policing. Erkennen, blockieren, abmahnen. Funktioniert, solange die Kontrollinfrastruktur undurchsichtig bleibt. Scheitert am ersten Reverse-Engineering, am ersten verärgerten Entwickler, am ersten öffentlichen Thread. Skaliert nicht, eskaliert immer.

Strategie 2: Pricing. Die Ökonomie transparent machen. Wer mehr verbraucht, zahlt mehr. Keine Erkennung nötig, keine Geheimhaltung, keine Eskalation. Funktioniert unabhängig davon, was der Client tut, weil der Kontrollpunkt nicht am Eingang liegt, sondern am Verbrauch.

paddo zitiert einen Beobachter mit: "Anthropic crackdown on people abusing the subscription auth is the gentlest it could've been." Stimmt. Aber nur, weil drei härtere Versuche vorher gescheitert sind. Die Sanftheit war nicht der erste Impuls. Sie war der letzte.

Für die dekodiert-Perspektive ist das ein Terrain-Thema: Die Umgebung (offene Protokolle, Developer-Communities, ein öffentlich gewordener Quellcode) bestimmt, welche Durchsetzungsstrategien überhaupt möglich sind. Wer seine AI-Governance auf Erkennung und Sperrung aufbaut, baut auf Geheimhaltung. Und Geheimhaltung hat in einer Welt, in der Code in npm-Paketen leakt und Developer-Communities Workarounds in Stunden bauen, eine Halbwertszeit von Monaten.

Der Zähler gewinnt nicht, weil er elegant ist. Er gewinnt, weil er der einzige Mechanismus ist, der unabhängig davon funktioniert, ob der Gegner deinen Quellcode hat.

Fragt euch selbst (oder fragt eure AI): Welche eurer internen Richtlinien basieren auf Erkennung und Sperrung statt auf transparenter Verbrauchsmessung? Und was passiert, wenn jemand den Mechanismus dahinter versteht?