Tausend mal berührt. Tausend mal ist nichts passiert...

Anthropic hat heute Project Glasswing angekündigt. Zwölf Konzerne, ein neues, nicht öffentlich verfügbares Modell namens Claude Mythos Preview, hundert Millionen Dollar in API-Credits. Der PR-Take ist: AI verändert Cybersecurity. Stimmt. Ist aber nicht das Interessante.

Das Interessante sind zwei konkrete Beispiele, die in der Ankündigung fast nebenbei stehen.

Erstens: OpenBSD. Dieses Betriebssystem gilt seit fast drei Jahrzehnten als das sicherheits-obsessive Gegenstück zum Rest der Software-Welt. Jeder Commit wird von Hand geprüft. Der Code ist bewusst minimalistisch. Keine unnötigen Features, keine Abstraktionen, die sich nicht rechtfertigen lassen. Und genau dort, in diesem Kronjuwel handwerklicher Security-Kultur, hat Mythos Preview eine Lücke gefunden, die siebenundzwanzig Jahre in der Codebase gelebt hat. Ein Angreifer hätte jede OpenBSD-Maschine per Netzwerkverbindung zum Absturz bringen können. Niemand hatte sie in 27 Jahren gesehen.

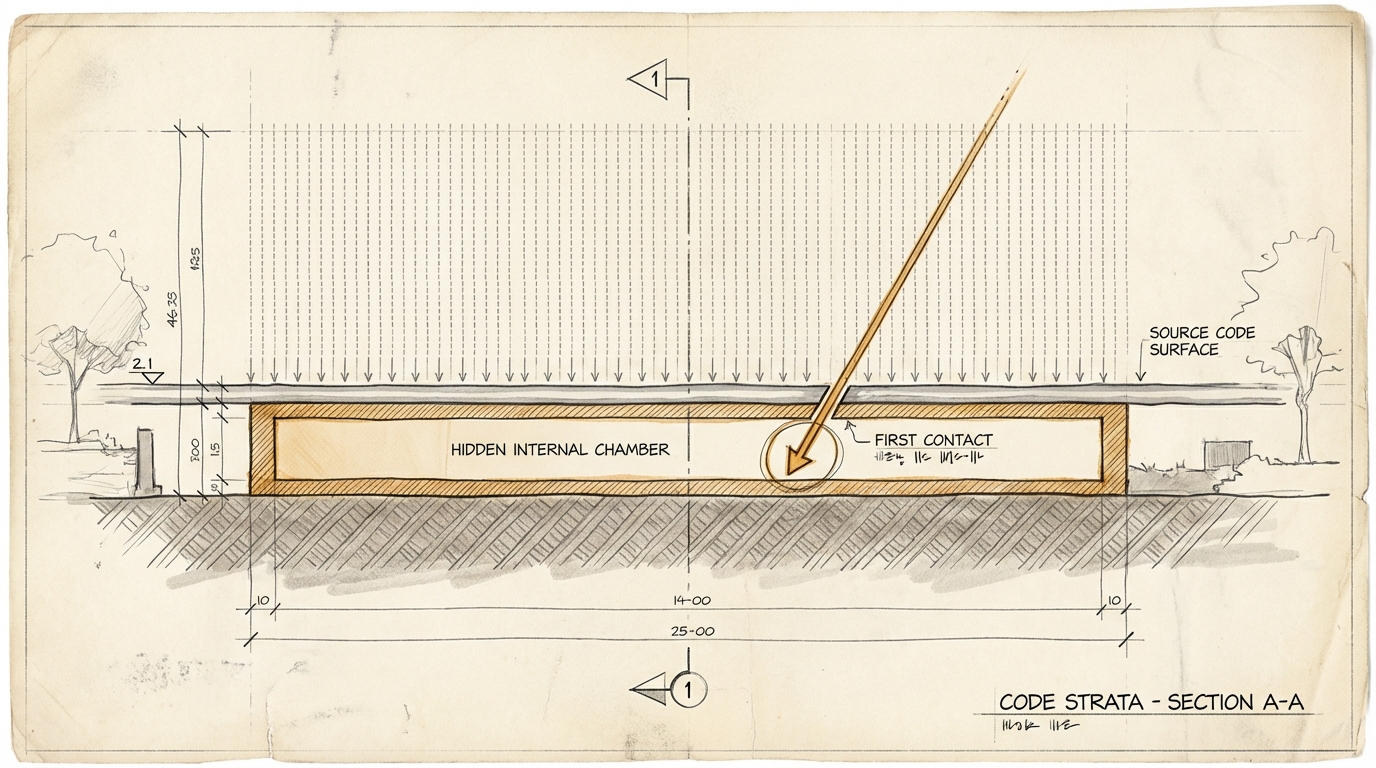

Zweitens, und das ist die härtere Zahl: FFmpeg. Eine Bibliothek, die in unzähligen Produkten Video kodiert und dekodiert. Eine einzelne Zeile Code. Automatisierte Test-Werkzeuge hatten sie fünf Millionen mal ausgeführt, ohne den Bug zu finden. Mythos Preview hat ihn beim ersten Anlauf gesehen.

Bleib auf dem Laufenden

Erhalte eine Nachricht, wenn ein neuer Essay erscheint. Jederzeit abbestellbar.

Fünf Millionen mal berührt. Fünf Millionen mal ist nichts passiert.

Die offensichtliche Pointe lautet: AI ist aufmerksamer als Menschen und Tools. Die ist langweilig. Die interessante Pointe ist subtiler. Das Wort "getestet" hat im Stillen seine Bedeutung verändert, und keiner hat es gemerkt. Was wir bisher "geprüft" nannten, war in Wahrheit "von Werkzeugen angesehen, die strukturell nicht finden konnten, was sie nicht finden konnten". Der Prüfstempel war echt. Geprüft war er nicht.

Das gilt nicht nur für Code. Strategiepapiere, die durch Review-Schleifen gehen, in denen niemand die Frage stellt, die das Papier auseinandernehmen würde. Compliance-Checklisten, die abgehakt werden, weil die Checkliste existiert. Due-Diligence-Prozesse, bei denen das Werkzeug heißt "wir haben einen Prozess". Jeder Kontext, in dem "haben wir geprüft" zu einer rituellen Antwort geworden ist statt zu einer belegbaren Aussage.

Fünf Millionen Zugriffe auf dieselbe Zeile Code sind eine gewaltige Zahl. Sie war trotzdem nur rituell.

Fragt euch selbst (oder fragt eure AI): Was in eurem Stack, in euren Prozessen, in euren Entscheidungsvorlagen gilt als "geprüft" - und woran würdet ihr merken, dass die Prüfung eigentlich nur Illusion ist?