Entsteht mit Managed Agents gerade eine neue AI-Infrastruktur?

Cloudflare hat diese Woche einen AI-Blogpost veröffentlicht, der erstmal nach normalem Product Marketing klingt: mehr Modelle, mehr Provider, ein Endpoint, Routing, Failover, Kostenkontrolle.

Der interessante Teil ist nicht der Launch. Der interessante Teil ist, was daran sichtbar wird.

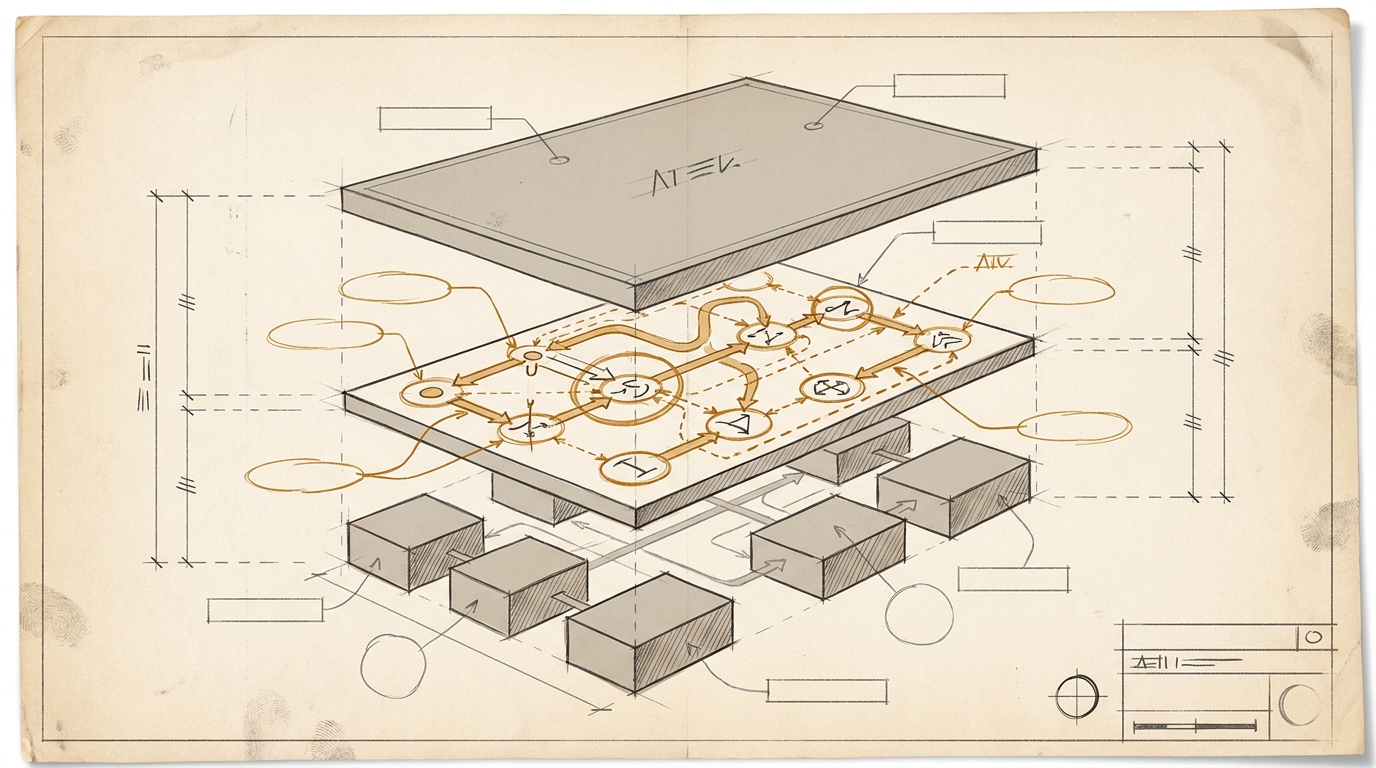

Je agentischer AI-Systeme werden, desto weniger reicht es, einfach das beste Modell einzukaufen. Dann hängt an einer Anfrage nicht ein Modellcall, sondern eine kleine Kette: klassifizieren, planen, Tools aufrufen, Daten holen, nächsten Schritt ausführen. Und damit wird aus einem Modellproblem ziemlich schnell ein Infrastrukturproblem.

Genau dort könnte gerade etwas entstehen, das man vorläufig Managed Agents nennen könnte.

Bleib auf dem Laufenden

Erhalte eine Nachricht, wenn ein neuer Essay erscheint. Jederzeit abbestellbar.

Nicht nur der Agent selbst, sondern die Schicht darum herum: die Modelle auswählt, Requests routet, Ausfälle abfängt, Kosten verteilt und Portabilität verspricht.

Das dürfte für Kunden schnell praktischer werden, als es klingt. Wer AI heute noch als direkte Beziehung zu einem einzelnen Modell baut, macht sich in agentischen Workflows erstaunlich fragil. Ein Ausfall ist dann nicht nur ein hängender Chat. Ein Preiswechsel ist nicht nur ärgerlich. Und Latenz vervielfacht sich plötzlich über mehrere Schritte.

Deshalb könnte genau dieser unscheinbare Layer strategisch werden: nicht weil irgendjemand Routing sexy findet, sondern weil dort entschieden wird, wie abhängig ein Unternehmen von einem Provider, einer Region oder einem Preismodell wirklich ist.

Im Wettbewerb ist das vielleicht die spannendere Verschiebung. Wenn Modelle austauschbarer werden, gewinnt nicht automatisch der mit dem besten Modell. Gewinnen kann auch der, der denselben Modellmarkt verlässlicher, billiger und näher am Use Case orchestriert.

Der Blick über den Tellerrand: Früher wollten Provider selbst Contentfirmen werden und haben oft nur gezeigt, dass sie ihre Rolle missverstanden hatten. Heute wirkt es eher so, als läge die interessante Position wieder dazwischen. Nicht im Besitz des Inhalts, sondern in der Kontrolle des Verkehrs. Nur dass die knappe Ressource diesmal nicht Bandbreite ist, sondern verlässliche Inference.

Vielleicht ist das am Ende näher an Serverless, als mir beim ersten Lesen klar war. In der Cloud blieb Compute die Commodity. Serverless hat daraus eine gemanagte, bequemere und teurere Schicht gemacht. Wenn das hier ähnlich läuft, wäre Inference die Commodity im Untergrund. Und Managed Agents wären die Schicht darüber, die daraus ein nutzbares Produkt macht.

Ich bin noch nicht sicher, ob das schon das richtige Bild ist. Aber genau deshalb bleibt die Notiz erstmal eine Randnotiz.

Fragt euch selbst, oder fragt eure AI: Wo in eurem Unternehmen hängt heute schon ein geschäftskritischer AI-Workflow an genau einem Modell, einem Provider oder einem Preispunkt, obwohl ihr längst so redet, als wärt ihr flexibel?