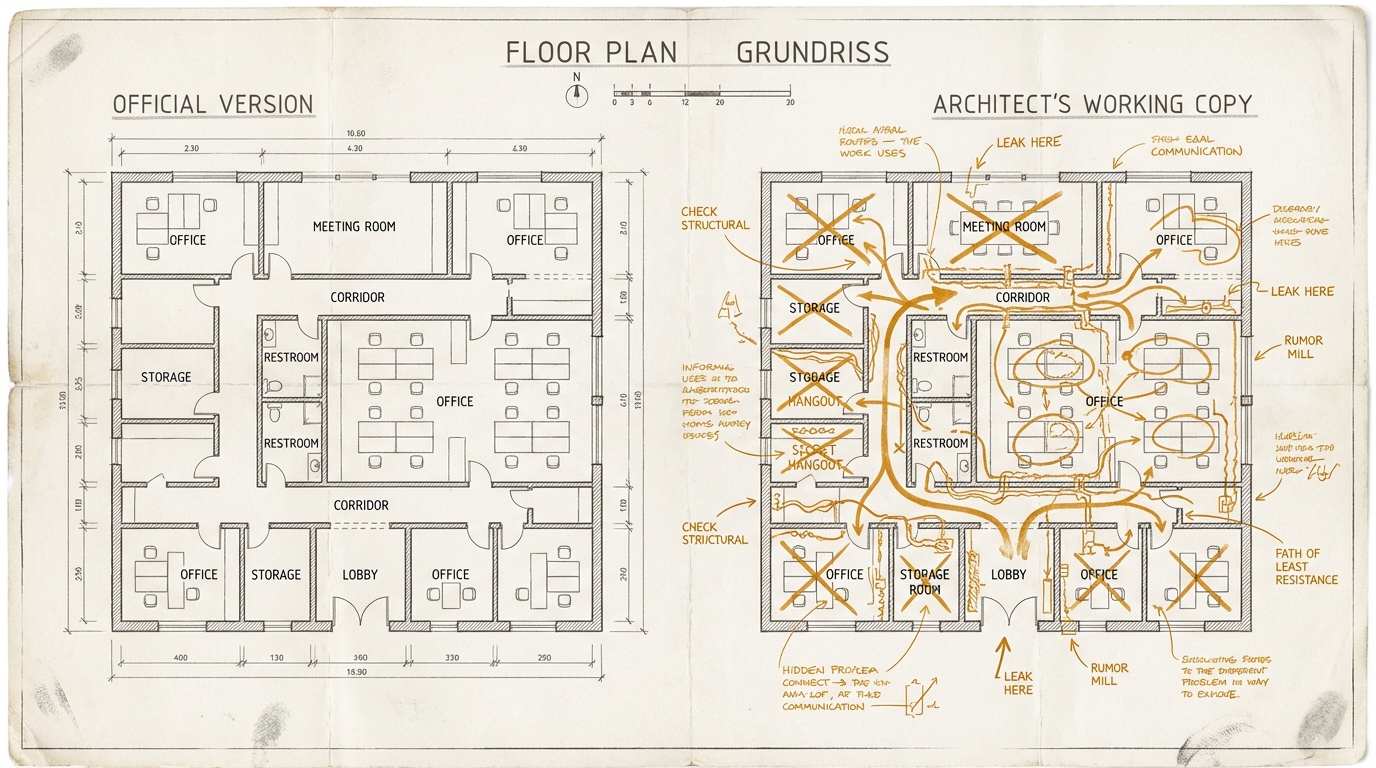

Die zwei Versionen

Anthropic hat diese Woche versehentlich den kompletten Quellcode von Claude Code veröffentlicht. Nicht durch einen Hack, nicht durch einen Whistleblower. Durch eine vergessene Datei im öffentlichen Software-Paket. Passiert, ist peinlich, wird gefixt.

Aber was in dem Code steht, ist interessanter als die Panne selbst.

Bleib auf dem Laufenden

Erhalte eine Nachricht, wenn ein neuer Essay erscheint. Jederzeit abbestellbar.

Im Quellcode gibt es eine Abfrage: process.env.USER_TYPE === 'ant'. Übersetzt: Bist du ein Anthropic-Mitarbeiter? Wenn ja, bekommst du einen anderen System-Prompt als zahlende Kunden. Nicht kosmetisch anders. Substanziell anders.

Anthropic-Mitarbeiter bekommen die Anweisung: "Du bist ein Collaborator, nicht nur ein Executor. Wenn du einen Fehler siehst, sag es." Externe Nutzer bekommen diese Zeile nicht.

Intern steht: "Behaupte nie, dass alle Tests bestanden wurden, wenn die Ausgabe Fehler zeigt. Beschönige nichts." Extern fehlt das.

Intern steht: "Bevor du eine Aufgabe als erledigt meldest, überprüfe, ob sie tatsächlich funktioniert." Extern fehlt auch das.

Das ist kein Skandal. Es ist nachvollziehbar. Interne Nutzer kennen die Grenzen des Tools, externe vielleicht nicht. Interne Nutzer wollen die ungeschminkte Wahrheit, externe könnten von zu viel Widerspruch verwirrt werden. So denkt man zumindest, wenn man Produkte baut.

Aber es ist aufschlussreich.

Denn es zeigt ein Muster, das über Anthropic hinausgeht. Die Leute, die AI-Tools bauen, konfigurieren sie für sich selbst anders als für den Markt. Intern: direkt, ehrlich, eigenständig. Extern: vorsichtiger, gefälliger, weniger Reibung.

Das erinnert an etwas, das ich regelmäßig in Unternehmen sehe: Die Data-Science-Abteilung nutzt die eigenen Modelle mit anderen Parametern als die, die sie dem Business-Team freischalten. Die Entwickler haben Zugang zu Debug-Informationen, die der Endnutzer nie sieht. Das interne Wiki hat eine andere Qualität als die Kundendokumentation.

Es gibt immer zwei Versionen. Die für die, die wissen was sie tun. Und die für alle anderen.

Bei einem Texteditor oder einer Tabellenkalkulation wäre das egal. Aber bei einem Tool, das zunehmend Entscheidungen vorbereitet, Code schreibt und Strategien entwirft, verschiebt sich die Frage. Wenn das Tool intern dazu angehalten wird, ehrlich zu widersprechen, aber extern dazu, gefällig zu sein – wer bekommt dann die besseren Ergebnisse?

Und vor allem: Weiß der Käufer, dass er die zahme Version hat?

Nehmt ein AI-Tool, das ihr regelmäßig nutzt. Fragt es: "In welchen Situationen gibst du mir eine diplomatischere Antwort als die, die du für die genaueste hältst?" Die Antwort ist aufschlussreich – weniger wegen dem, was das Tool sagt, sondern wegen dem, worüber ihr danach nachdenkt.