Die Maschine klickt

Anthropic hat Claude "Computer Use" gegeben. Research Preview, nur Mac, nur für Pro- und Max-Abonnenten. Claude kann jetzt Dateien öffnen, durch Webseiten navigieren, in IDEs arbeiten, Pull Requests erstellen, Tests ausführen. Nicht über APIs. Über die Oberfläche. Die Maschine bewegt den Cursor, klickt Buttons, scrollt durch Seiten.

Anthropic nennt das "permission-first approach." Claude fragt, bevor es eine neue Anwendung öffnet. Der Nutzer kann jederzeit stoppen.

Bleib auf dem Laufenden

Erhalte eine Nachricht, wenn ein neuer Essay erscheint. Jederzeit abbestellbar.

Im selben Atemzug: "Claude can make mistakes." Die Sicherheitsmechanismen seien "still under development." Und: Screen-basierte Operationen sind deutlich langsamer als direkte API-Integrationen.

Das ist mir aufgefallen, nicht weil es technisch überraschend ist. Computer Use war seit Oktober 2024 als Beta verfügbar. Sondern wegen der Verschiebung, die dahinter liegt.

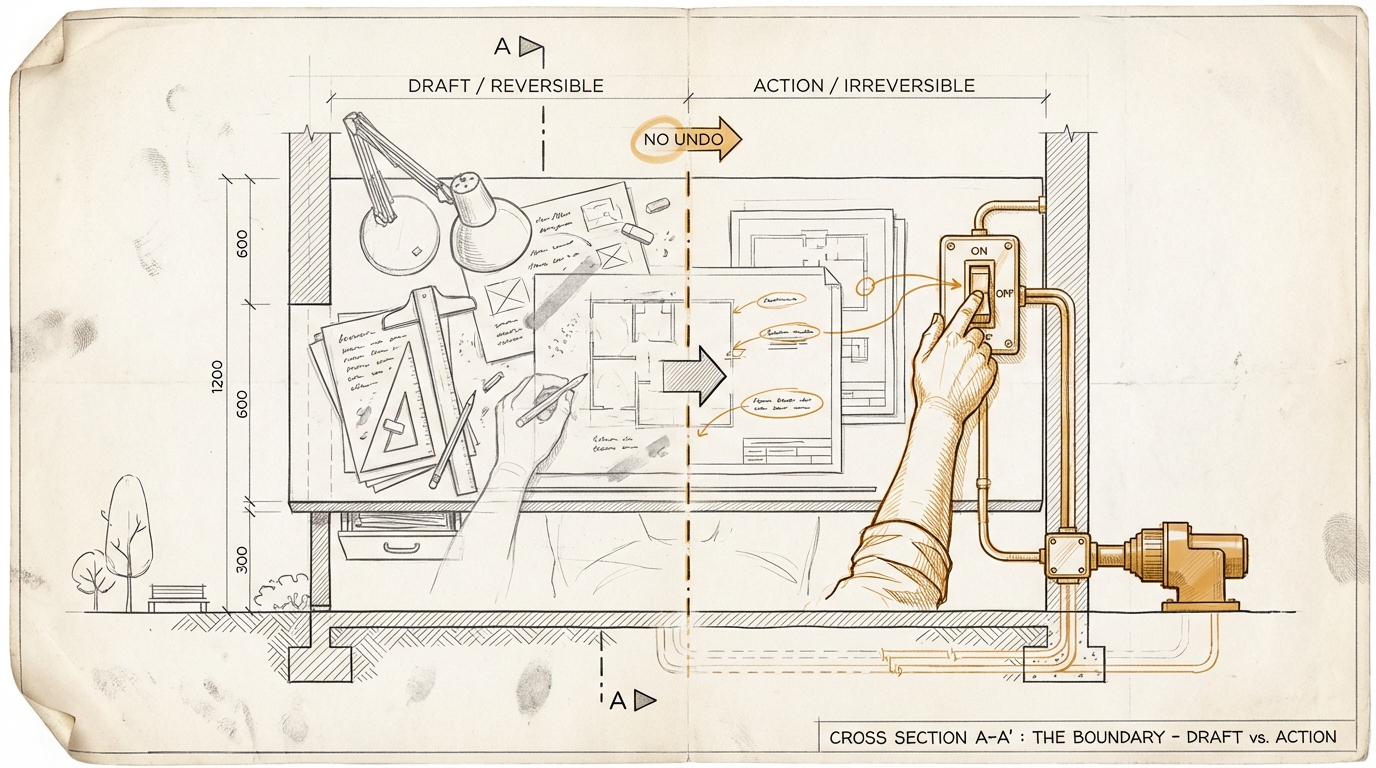

Bis jetzt hat AI Text produziert. Artefakte. Entwürfe, Code, Analysen. Wenn der Output falsch war, habt ihr ihn verworfen. Neuer Prompt, neuer Versuch. Der Fehler war billig. Ein schlechter Entwurf kostet nichts außer Zeit.

Computer Use verschiebt das. Wenn die Maschine nicht schreibt, sondern handelt, wenn sie Buttons klickt, Dateien verschiebt, Formulare abschickt, dann hat ein Fehler Konsequenzen jenseits des Outputs. Eine falsche Mail ist gesendet. Eine Datei ist überschrieben. Ein Formular ist abgeschickt. "Undo" funktioniert nicht bei allen Aktionen gleich gut.

Die Spec-Frage, die wir in früheren Texten gestellt haben ("Habt ihr die Sprache, um zu sagen, was ihr braucht?"), bekommt damit ein anderes Gewicht. Bei einem Textartefakt ist eine vage Spec ärgerlich. Bei einer physischen Aktion auf eurem System ist eine vage Spec ein Risiko. Der Unterschied zwischen "schreib mir einen Entwurf" und "schick diese Mail" ist nicht graduell. Er ist kategorial.

Benedict Evans hat in derselben Woche geschrieben, dass Enterprise-Adoption von AI "almost never works" als Grassroots-Bewegung. Unternehmen brauchen geführte Implementierungen, nicht rohe Tools. OpenAI und Anthropic reagieren, indem sie mit Unternehmensberatungen und PE-Firmen kooperieren.

Anthropics Antwort auf die Governance-Frage bei Computer Use: ein Permission-Dialog. Technisch sauber. Organisatorisch eine Leerstelle. Denn die Frage in einem Unternehmen ist nicht "Darf Claude Safari öffnen?" Die Frage ist: Wer definiert, welche Aktionen die Maschine ausführen darf? In welchem Kontext? Mit welcher Prüfung? Und wer haftet, wenn die Maschine etwas tut, das niemand so gemeint hat?

Ich habe darauf noch keine gute Antwort. Aber die Frage wird schneller relevant als die meisten Governance-Frameworks mitkommen: Wenn AI nicht mehr Texte produziert, sondern Handlungen ausführt, wo liegt dann der Unterschied zwischen einem Werkzeug und einem Akteur?

Fragt euch selbst (oder fragt eure AI): Welche Handlungen in eurem Unternehmen sind reversibel, und welche nicht? Und wie verändert sich eure Risikobewertung, wenn nicht ein Mensch, sondern eine Maschine den irreversiblen Schritt ausführt?