Die App mit Werksausweis

In „Die Grenze der guten Absicht“ ging es um Anbieter, die sich still mehr Rechte nehmen, als Nutzer bewusst eingeräumt haben. paddo beschreibt jetzt die organisatorische Version desselben Problems. Und die dürfte für Unternehmen teurer werden als der nächste Modellfehler.

Der Fall ist nicht deshalb interessant, weil irgendwo ein Modell halluziniert hat. Er ist interessant, weil der Weg in ein Unternehmenssystem laut paddo nicht über einen schlechten Output lief, sondern über ein AI-Tool, das bereits weitreichende Rechte hatte. Nicht die Ausgabe war das Problem. Die Identität war das Problem.

Genau an dieser Stelle laufen viele AI-Debatten schief. Auf Director-Level spricht man über Datenschutz, Modellqualität, Bias und Halluzinationen. Alles legitim. Aber der operative Schaden sitzt oft eine Schicht tiefer: im sogenannten OAuth-Grant, im zu breiten Scope, im unkontrollierten MCP-Server, im kleinen Tool-Startup, das plötzlich Zugriff auf Mail, Drive, GitHub, Tickets und Deployments hat.

Man könnte es hart zuspitzen: Viele Unternehmen kaufen AI-Tools ein, als wären es bessere Browser-Erweiterungen. Tatsächlich behandeln sie damit eine Fremdfirma wie einen neuen Mitarbeiter mit Generalschlüssel. Denn wer seinen „Tools aus der Schatten-IT“ derart breite Rechte gibt, öffnet ihnen eben auch alle, oder zumindest sehr viele, Türen im Unternehmen.

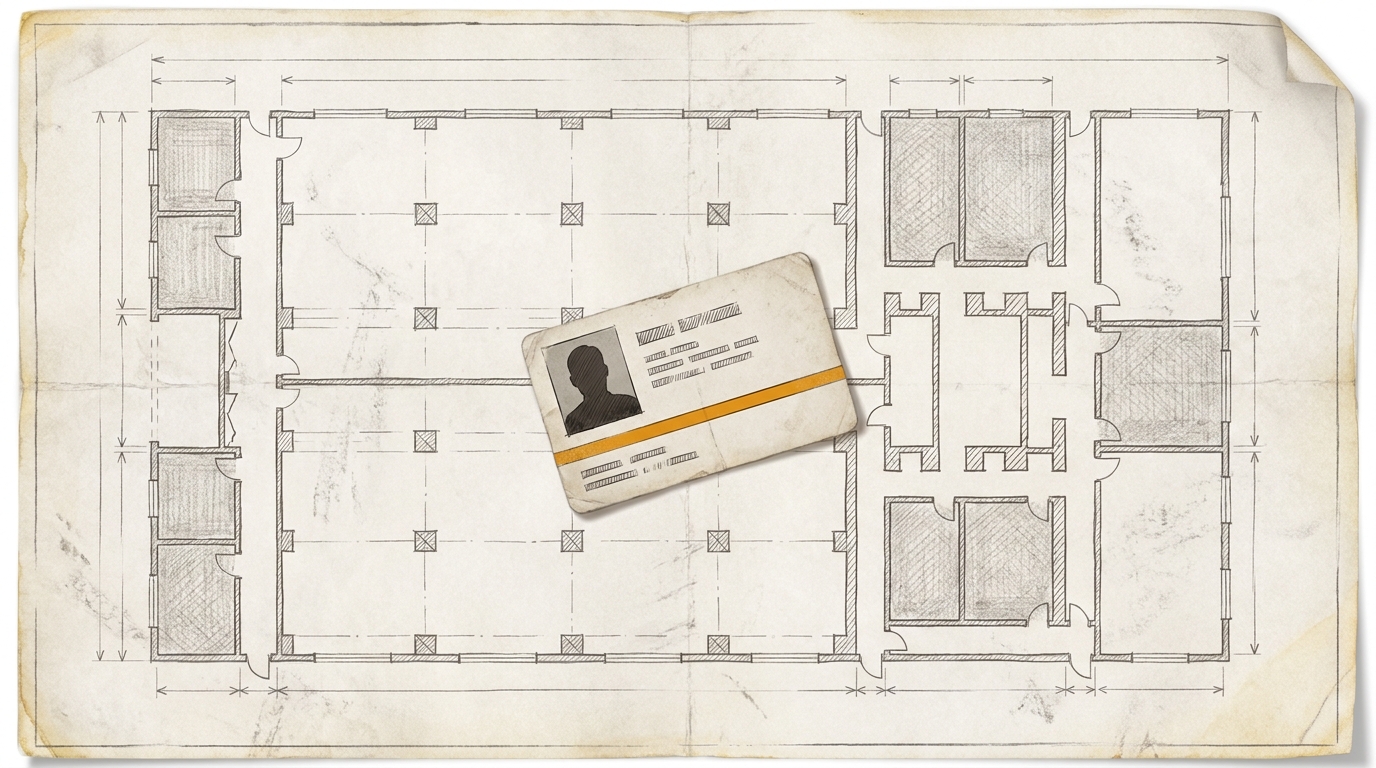

Das ist der deutsche Anschluss an den Security-Vorfall bei Vercel. In einem klassischen Werk würde niemand einen externen Dienstleister einfach durch alle Hallen laufen lassen, nur weil er verspricht, die Produktivität zu erhöhen. Er bekäme einen Ausweis, definierte Zonen, idealerweise Begleitung und einen klaren Entzugspfad für Berechtigungen. Ich erinnere mich genau daran, wie ich bei VW mein Handy abgegeben habe, meine Laptopkamera zukleben musste und nicht ohne Begleitung auf dem Gelände herumlaufen durfte. Und genau diese Logik fehlt heute oft bei AI-Tools. Die App bekommt den Werksausweis, bevor sauber geklärt ist, wo sie überhaupt hin darf.

Darum ist das Thema auch nicht einfach „nur“ Cybersecurity. Es ist eine echte Organisationsfrage. Wer prüft im Unternehmen eigentlich, welche Fremdidentitäten gerade hereingelassen werden? Wer schaut auf Rechte, Laufzeit, Widerruf, Zuständigkeit und Protokollierung? Wer entscheidet, ob ein Tool wirklich nur ein Tool ist oder längst Teil der kritischen Infrastruktur?

Im deutschen Unternehmenskontext wäre die ehrliche Antwort oft: zu wenige Stellen gemeinsam. IT-Security schaut auf Token und Scopes. Datenschutz schaut auf Datenflüsse. Einkauf schaut auf Verträge. Der Betriebsrat kommt ins Spiel, sobald Arbeitsmittel, Kontrolle oder Prozessveränderung berührt werden. Revision fragt später, warum niemand das zusammengedacht hat. Genau darin liegt der eigentliche Punkt. Das Problem entsteht oft nicht, weil niemand zuständig wäre, sondern weil jede Stelle nur ihren Ausschnitt sieht.

Deshalb passt der Reframe so gut in die dekodiert-Linie. AI-Tools sind nicht bloß Software. Sie sind eben auch neue organisatorische Akteure. Nicht mit Personalnummer, aber mit Rechten. Nicht auf der Gehaltsliste, aber im Handlungskreis der Firma. Und sobald man sie so betrachtet, kippt auch die Managementfrage. Dann geht es nicht mehr zuerst um Feature-Listen, sondern um Zutrittslogik.

Die relevante Unterscheidung lautet dann nicht: Ist das Tool intelligent? Sondern: Welche Identität bekommt es? Welche Systeme darf es sehen? Welche darf es verändern? Wer zieht den Ausweis wieder ein, wenn der Anbieter kompromittiert wird, übernommen wird oder einfach verschwindet?

Das klingt nach Vorsicht. Ist es auch. Aber nicht nach deutscher Besitzstandswahrung. Sondern nach Architektur. Wer AI-Tools weiter wie harmlose Produktivitätssoftware behandelt, baut gerade keinen modernen Betrieb. Er verteilt Werksausweise ohne Lageplan.

Vielleicht ist das die nützlichste Frage für die nächsten Monate. Nicht: Welches Modell ist besser? Sondern: Welche eurer AI-Tools haben heute mehr Rechte, als ihr einem externen Dienstleister je geben würdet?

Fragt euch selbst, oder fragt eure AI: Welche eurer AI-Tools haben heute mehr Rechte, als ein externer Dienstleister in eurem Unternehmen jemals bekommen würde?