Der Markt regelt das schon

Soohoon Choi von Greptile hat diese Woche eine These veröffentlicht, die gerade die Runde macht: AI wird guten Code schreiben. Nicht weil wir es wollen, sondern weil es billiger ist. Guter Code braucht weniger Tokens zum Verstehen, weniger Tokens zum Ändern, weniger Compute für Maintenance. Der Markt belohnt Einfachheit. Slop skaliert nicht.

Simon Willison hat den Kerngedanken geteilt. Die Logik klingt bestechend. Und ist meiner Meinung nach trotzdem (oder gerade deswegen) falsch.

Bleib auf dem Laufenden

Erhalte eine Nachricht, wenn ein neuer Essay erscheint. Jederzeit abbestellbar.

Nicht die Schlussfolgerung ist falsch. Es kann sein, dass AI-generierter Code besser wird. Aber die Begründung – "ökonomische Anreize erzwingen Qualität" – hat eine etwa 50 Jahre lange Gegenbeweislage.

WordPress liefert 43% des Webs. Architektonisch ist es ein Unfall, der zu einem Ökosystem gewachsen ist. Der Markt hat das nicht nur toleriert, er hat es belohnt. Weil der Markt nicht Code-Qualität bewertet, sondern Liefergeschwindigkeit und Feature-Vollständigkeit.

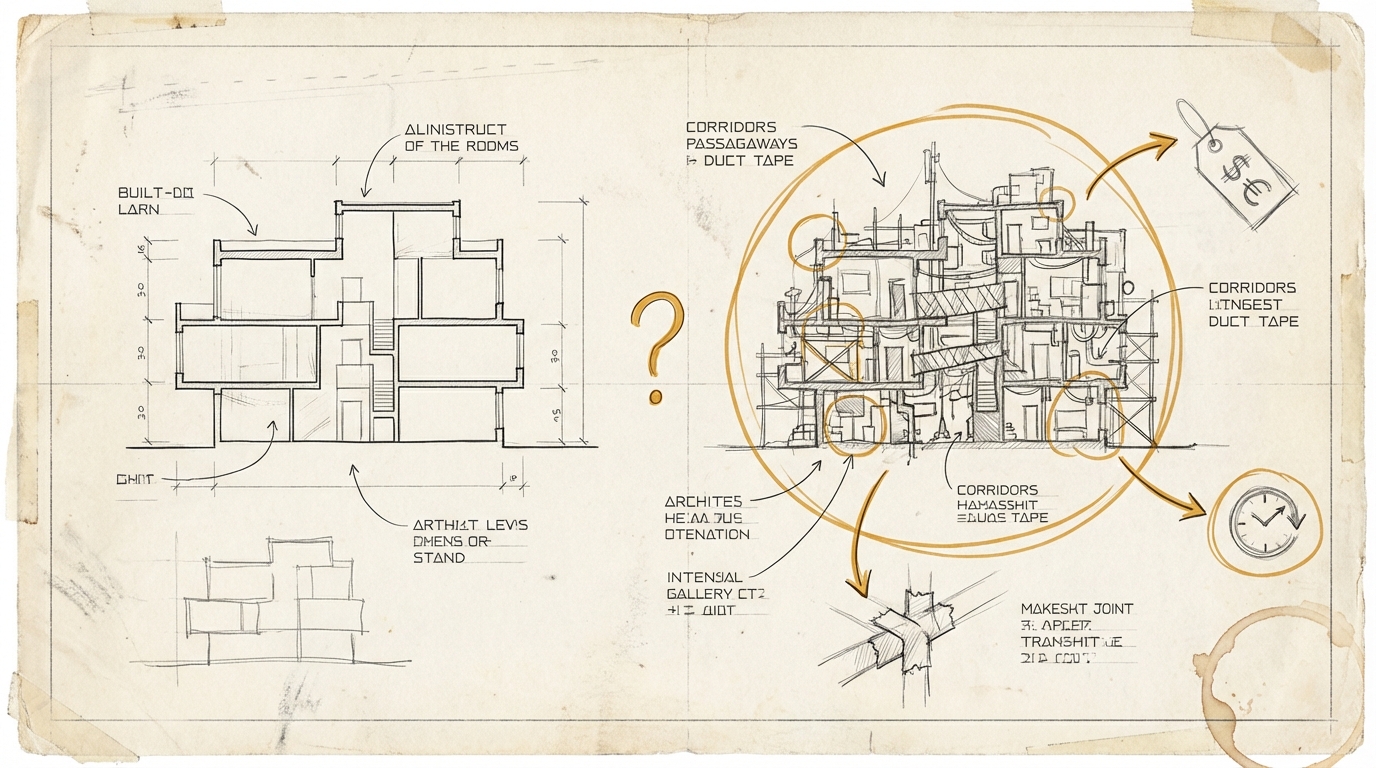

Oder nehmt die Consulting-Industrie. Jeder, der jemals eine Analytics-Implementierung von einem großen Dienstleister übernommen hat, kennt den Moment, in dem man die Codebasis öffnet und sich fragt, ob das ein Prototyp war oder die finale Lieferung. Die Antwort ist: Das war die finale Lieferung. Abgenommen, bezahlt, übergeben. Wartbarkeit schluckt entweder der laufende Retainer, oder in zwei bis fünf Jahren der nächste Dienstleister, der alles neu baut.

Der Markt hat dieses Modell nicht bestraft. Er hat es zum Standard gemacht. Weil "gut genug zum Abnicken" ökonomisch effizienter ist als "gut genug zum Warten". Der Auftraggeber kann die Qualität sehr oft nicht bewerten, der Dienstleister hat keinen Anreiz, über den Scope hinauszudenken, und die Folgekosten erscheinen erst auf einer anderen Budgetzeile. NFRs, also non functional requirements, (Anforderung die keine sichtbare Funktion haben, sondern bestimmte Qualitätsmaßstäbe sicherstellen sollen) hab ich in meiner Karriere genau in einem einzigen Projekt als Anforderung bekommen. In über 20 Jahren.

Chois Argument hat einen blinden Fleck: Er verwechselt die Token-Kosten des Modells mit den Entscheidungskriterien des Marktes. Dass guter Code weniger Tokens verbraucht, ist ein technisches Argument. Aber Kaufentscheidungen für Software und Dienstleistungen werden nicht nach Token-Effizienz getroffen. Sie werden nach Preis, Geschwindigkeit und Sichtbarkeit getroffen.

Wenn Token-Ökonomie Qualität erzwingen würde, hätte Microservices-Architektur zu einfacheren Systemen geführt. Hat sie nicht. Agile hätte zu besserer Software geführt. Hat es nicht zuverlässig. TDD hätte sich flächendeckend durchgesetzt. Hat es nicht.

Jedes Jahrzehnt hat seine Version von "diesmal wird der strukturelle Anreiz Qualität erzwingen". Und jedes Mal gewinnt Speed-to-Market.

Was sich vielleicht ändert: Wenn AI-Agents ihren eigenen Code warten müssen, verschiebt sich die Rechnung. Dann sind Token-Kosten keine externe Metrik mehr, sondern interne Betriebskosten. Aber das setzt voraus, dass dieselbe Organisation den Code schreibt und wartet – und genau das ist in der Service-Industrie nicht der Fall.

Fragt euch selbst (oder fragt eure AI): Bei welchen Entscheidungen in eurem Unternehmen behauptet jemand, dass "der Markt" oder "die Incentives" automatisch zu besseren Ergebnissen führen – und wer profitiert davon, dass das geglaubt wird?