Der Fehler sitzt eine Etage höher

In den letzten Wochen wirkte Claude Code auf viele Leute plötzlich schlechter. Vergesslicher. Unzuverlässiger. Teurer. Irgendwie schlapper.

Ich kenne dieses Gefühl ganz gut. Man arbeitet ein paar Tage mit einem Tool, merkt sich seine Eigenheiten, baut Vertrauen auf. Nicht blindes Vertrauen. Eher die pragmatische Sorte. Die, mit der man leben kann. Und dann kippt etwas. Der Output fühlt sich anders an. Die Sessions wirken dünner. Dinge, die gestern noch sauber liefen, laufen heute komisch. Man fängt an, am Modell zu zweifeln.

Anthropics Postmortem ist genau deshalb so interessant. Nicht, weil mal wieder etwas kaputt war. Das passiert. Sondern weil der Fehler offenbar gar nicht dort saß, wo viele ihn vermutet haben. Nicht im Modell. Sondern im Drumherum.

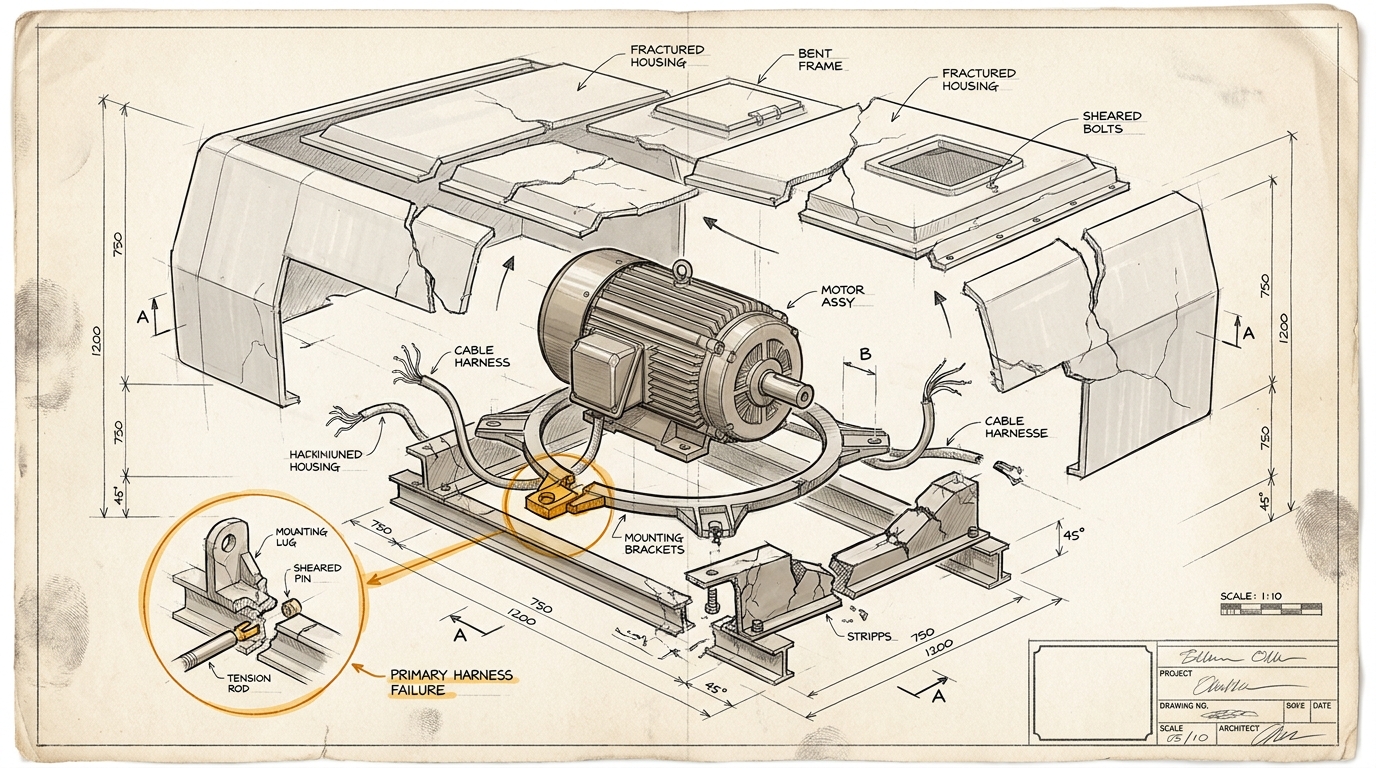

Im Harness. Im Cache. In der Session-Logik. In der Frage, was aufgehoben, verworfen oder still verändert wird.

Das klingt erstmal technisch. Ist es auch. Aber nur auf den ersten Blick. Eigentlich ist es eine Management-Beobachtung.

Wir reden bei AI noch immer gern so, als wäre das Modell der Ort, an dem Qualität entsteht oder verschwindet. Als säße dort die eigentliche Magie. Oder das eigentliche Problem. Ich glaube immer weniger daran. Jedenfalls nicht in der Praxis, in der diese Systeme inzwischen benutzt werden.

Denn was Menschen im Alltag als „guter“ oder „schlechter“ erleben, ist oft nicht das nackte Modell. Es ist das Arbeitssystem um das Modell herum. Wie viel Kontext bleibt erhalten. Wie stabil ein Tool auf frühere Entscheidungen zurückgreift. Wie transparent Limits, Cache-Regeln oder Verhaltensänderungen kommuniziert werden. Ob man sich auf die Arbeitsbeziehung verlassen kann.

Simon Willison hat diesen Punkt sauber herausgezogen. Und paddo hat ihn aus einer anderen Richtung noch einmal geschärft: einmal in Richtung Vertrauen und Sichtbarkeit, einmal in Richtung Guardrails und Testlogik. Beides hängt enger zusammen, als es erst wirkt.

Wenn ein Agent heute Code schreibt und morgen denselben Zusammenhang nicht mehr sauber hält, dann ist das nicht einfach nur ein Qualitätsproblem. Es ist ein Führungsproblem für das System. Dann stimmt etwas an den Leitplanken nicht. Oder an der Art, wie sie verändert wurden. Oder an der Art, wie darüber nicht gesprochen wurde.

Und genau da wird es für Unternehmen interessant. Denn die operative Frage lautet dann nicht mehr nur: Welches Modell ist besser?

Sie lautet: Welchem Arbeitssystem traue ich zu, sich unter Last noch berechenbar zu verhalten?

Ich merke bei mir selbst, wie sich an dieser Stelle gerade etwas verschiebt. Vor ein paar Monaten hätte ich so einen Vorfall vermutlich noch als Tool-Geschichte einsortiert. Ärgerlich, aber randständig. Inzwischen glaube ich, dass hier der eigentliche Produktkern sichtbar wird.

Nicht der Output allein.

Die Verlässlichkeit der Umgebung.

Das betrifft auch den dritten Text in diesem kleinen Cluster, den mit dem schönen brutalen Satz vom „Idiot Savant“. Ich glaube, da ist etwas dran. Nicht als Pose, sondern als Arbeitsdiagnose. Wenn Agenten produktiv werden, reicht es nicht mehr, auf gute Prompts und ein bisschen TDD zu hoffen. Dann braucht es andere Formen von Prüfung. Andere Formen von Monitoring. Andere Formen von Guardrails. Nicht weniger Tests. Eher ernstere.

Vielleicht ist das die reifere Sicht auf diese Werkzeuge. Nicht: Der Agent ist schlau, also wird er schon wissen, was er tut. Sondern: Der Agent ist nur so brauchbar wie das System, das ihn einhegt, erinnert, begrenzt und beobachtbar macht.

Das ist keine kleine Korrektur. Das ist eine andere Schicht der Verantwortung.

Und ich vermute, wir stehen da erst am Anfang. Die nächste Welle von AI-Problemen wird nicht nur aus Halluzinationen bestehen oder aus schiefen Antworten. Sie wird aus Arbeitsumgebungen bestehen, die sich nach Produkt anfühlen, aber in Wahrheit noch Versuchsanordnungen sind.

Vielleicht ist das der Satz, der bei mir nach den drei Texten hängen geblieben ist:

Der Qualitätsunterschied zwischen zwei AI-Tools sitzt zunehmend nicht mehr nur im Modell. Er sitzt eine Etage höher.

Fragt euch selbst, oder fragt eure AI: Bei welchem eurer AI-Tools vertraut ihr gerade eigentlich dem Modell, obwohl ihr in Wahrheit dem Arbeitssystem darum herum vertrauen müsstet?