Der Disponent schlägt den Modell-Fan

Kimi K2.6 gegen Claude Opus 4.7 sieht auf den ersten Blick aus wie der nächste Benchmark-Vergleich. Claude löst mehr Tests, macht weniger Fehler und gewinnt die Qualitätswertung. Kimi bleibt sichtbar dahinter.

So weit, so erwartbar.

Spannend wird es erst beim Preis. Claude kostete in dem Test 3,56 Dollar. Kimi kostete 0,67 Dollar. Das schwächere Modell lieferte also weniger Qualität, aber zu rund einem Fünftel des Preises. Claude war etwa 5,3-mal so teuer. Die eigentliche Nachricht ist deshalb nicht: „Kimi schlägt Claude bald.“ Die eigentliche Nachricht ist: „Nicht jede Aufgabe verdient Claude.“

Das klingt weniger spektakulär. Ist aber wichtiger.

Viele Unternehmen denken bei AI noch in Modell-Ranglisten. Welches Modell ist am stärksten? Welcher Anbieter führt gerade? Was sagt der Benchmark? Das ist verständlich, aber operativ zu grob. In echter Arbeit gibt es nicht „die Aufgabe“. Es gibt Vorarbeit, Exploration, Variantenbildung, Recherche, Review, Spezifikation, Implementierung, Prüfung und Entscheidung. Diese Schritte haben unterschiedliche Risiken. Also sollten sie auch unterschiedliche Modelle bekommen.

Ein günstiges Modell kann zehn Varianten skizzieren, bevor ein teures Modell eine davon sauber ausarbeitet. Es kann einen ersten Code-Review machen, bevor Claude die kritischen Stellen prüft. Es kann schlechte Ideen billig sichtbar machen, bevor teure Tokens auf gute Ideen angesetzt werden.

Das ist keine Herabstufung. Das ist Arbeitsteilung.

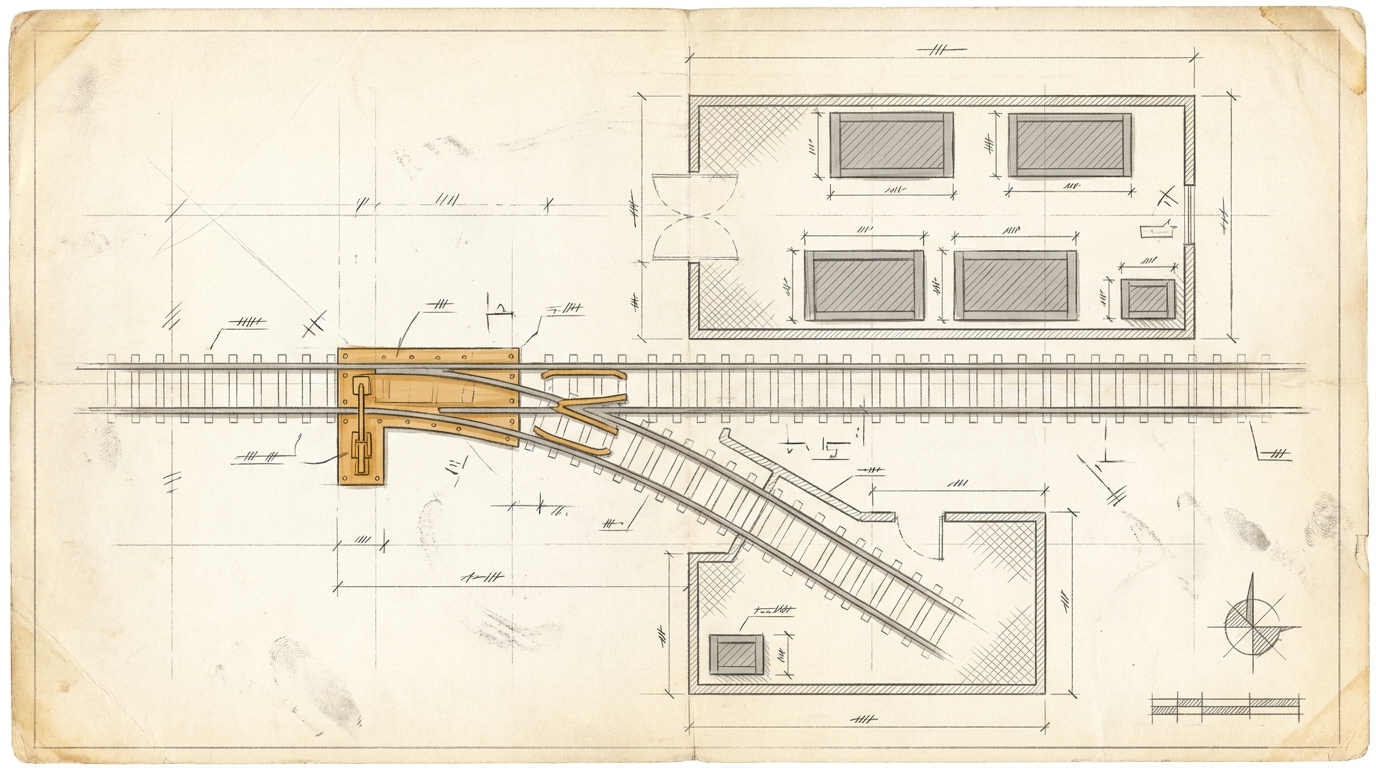

Auf einer Baustelle lässt man auch nicht den Statiker Steine schleppen. Umgekehrt lässt man den Hilfsarbeiter nicht die Brücke freigeben. Beides wäre absurd. In AI-Workflows passiert genau das aber ständig. Entweder wird das beste Modell für jede Kleinigkeit verbrannt, oder das billigste Modell darf Arbeit erledigen, deren Fehler später richtig teuer werden.

Nate B. Jones hat für Agenten eine brauchbare Grundfrage formuliert: Was optimierst du eigentlich? Diese Frage gilt auch für Modellwahl. Optimierst du auf Geschwindigkeit? Kosten? Korrektheit? Varianz? Nachvollziehbarkeit? Risiko? Ohne diese Unterscheidung ist „wir nutzen AI“ ungefähr so präzise wie „wir nutzen Fahrzeuge“. Kann ein Gabelstapler sein. Oder ein Rettungswagen. Man sollte sie nicht verwechseln.

Modell-Orchestration ist deshalb keine Tool-Spielerei. Sie wird zu einer finanziellen Kernkompetenz. Nicht, weil billig immer besser ist. Sondern weil teuer ohne Grund schlechter Betrieb ist.

Die nächste Reifestufe liegt nicht darin, immer das stärkste Modell zu kennen. Sie liegt darin, Aufgaben sauber zu schneiden. Was ist reversibel? Was braucht nur einen Entwurf? Wo ist ein Fehler peinlich, aber harmlos? Wo wird er rechtlich, finanziell oder reputativ teuer? Wo reicht ein Modell? Wo braucht es Peer Review durch ein zweites? Und wo muss ein Mensch entscheiden, weil keine Metrik der Welt sagen kann, ob das Ergebnis wirklich gut ist?

Vielleicht ist das der nüchterne Teil nach dem Benchmark-Rausch. Die Modell-Fans fragen, wer gerade vorne liegt. Die besseren Organisationen bauen Dispatching.

Sie wissen, wann der Meister ran muss.

Und wann nicht.

Fragt euch selbst, oder fragt eure AI: Welche Aufgaben in eurem Unternehmen laufen heute über das teuerste Modell, obwohl ein billigeres Modell 80 Prozent der Vorarbeit erledigen könnte? Und welche Aufgaben laufen über ein billiges Modell, obwohl ein Fehler dort richtig teuer wird?