Aus Risiko wird Produkt

Vor zwei Wochen war Claude Mythos noch das Modell, das Anthropic laut Leak nicht frei in die Welt lassen konnte. Zu gefährlich für Cybersecurity. Zu gut in genau den falschen Dingen. Diese Woche ist aus derselben Fähigkeit ein Produkt geworden: Project Glasswing, ein Programm für Security-Research unter kontrollierten Bedingungen.

Das ist erstmal keine Überraschung. Natürlich versucht jedes Unternehmen, aus seiner stärksten Fähigkeit ein Geschäft zu machen. Interessant ist etwas anderes: wie schnell sich die Erzählung gedreht hat.

Gestern war dieselbe Capability noch Begründung für Zurückhaltung. Heute ist sie Begründung für Markteintritt.

Die Fähigkeit selbst hat sich in drei Tagen nicht moralisch verändert. Die Verpackung hat sich verändert. Statt "zu riskant für Release" heißt es jetzt: "wertvoll für ausgewählte Partner mit dem richtigen Sicherheitsrahmen". Gleiches Modell, anderer Rahmen, andere Zielgruppe, andere Sprache.

Bleib auf dem Laufenden

Erhalte eine Nachricht, wenn ein neuer Essay erscheint. Jederzeit abbestellbar.

Genau das dürfte in den nächsten Monaten öfter passieren. Nicht nur bei Anthropic. Immer dann, wenn Frontier-Modelle an eine Grenze stoßen, an der offene Verfügbarkeit zu riskant, aber Nichtverfügbarkeit zu teuer wird, entsteht dazwischen ein dritter Raum: kontrollierte Kommerzialisierung.

Das ist kein Safety-Thema allein. Es ist ein Go-to-Market-Muster.

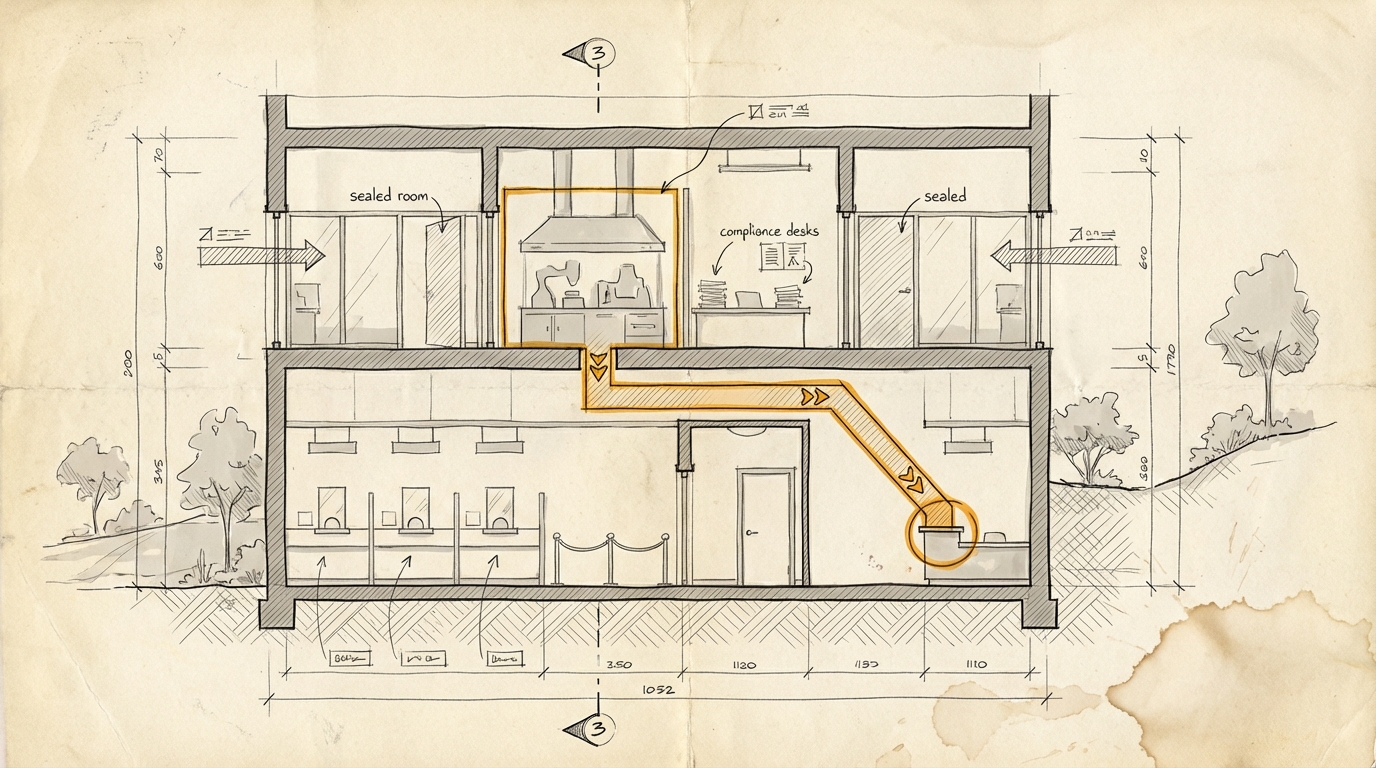

Ein Unternehmen entdeckt, dass eine Fähigkeit öffentlich schwer zu rechtfertigen ist, intern aber zu wertvoll, um sie liegen zu lassen. Also baut es kein offenes Produkt und auch kein vollständiges Verbot. Es baut ein Programm. Zugang nur für bestimmte Gruppen, mit Auflagen, Monitoring und einer Geschichte, die das Risiko in Verantwortung übersetzt.

Damit wird aus einem Problem eine Produktkategorie.

Für unsere Perspektive ist das vor allem ein Terrain-Signal. Die Umgebung ändert sich. Zwischen "open release" und "closed lab" entsteht ein Markt für Fähigkeiten, die zu stark, zu heikel oder zu erklärungsbedürftig für den normalen Produktkanal sind. Wer AI nur als Modellvergleich denkt, verpasst diesen Layer komplett. Entscheidend ist nicht nur, was ein Modell kann. Entscheidend ist, unter welchen institutionellen Bedingungen seine Fähigkeiten verkauft werden dürfen. Und, nicht zu vergessen, wer sich den frühen Zugang leisten kann.

Man könnte es auch nüchterner sagen: Safety wird hier nicht nur zur Grenze des Produkts. Safety wird Teil des Produkts.

Das heißt nicht, dass das zynisch ist. Es kann völlig vernünftig sein, ein starkes Cyber-Modell nur in eng kontrollierten Kontexten verfügbar zu machen. Aber man sollte sich nicht vormachen, dass es nur um Risikominimierung geht. Es geht auch um Paketierung, Zugangskontrolle und Preislogik.

Wer daraus etwas für das eigene Unternehmen mitnehmen will, sollte deshalb weniger fragen, ob ein Modell "zu gefährlich" ist. Die interessantere Frage ist: Welche Fähigkeiten in eurem Haus sind offiziell noch Ausnahmefall, werden aber in Wahrheit schon für eine spätere Produktform vorbereitet?

Fragt euch selbst, oder fragt eure AI: Welche eurer heiklen Fähigkeiten werden gerade noch als Risiko beschrieben, obwohl sie in Wahrheit schon wie ein zukünftiges Produkt behandelt werden?

Quellen

- paddo.dev: Project Glasswing: Anthropic Weaponizes Its Own Risk (08.04.2026)

- Simon Willison: Anthropic's Project Glasswing - restricting Claude Mythos to security researchers - sounds necessary to me (07.04.2026)

- Latent Space: [AINews] Anthropic @ $30B ARR, Project GlassWing and Claude Mythos Preview (08.04.2026)