Executive Briefing: Deine Website hat eine neue Zielgruppe

Viele Unternehmen optimieren ihre Website noch auf Besuche. Gleichzeitig wird sie zunehmend von Systemen genutzt, die in diesen Metriken kaum auftauchen. Wer Ziele, KPIs und Bonuslogiken nicht anpasst, bestraft bald genau die Teams, die strategisch richtig handeln.

Die meisten Website-Debatten über AI hängen gerade an der Technik fest. Crawler. Rendering. Schema Markup. Alles nicht falsch. Aber auch nicht der eigentliche Punkt.

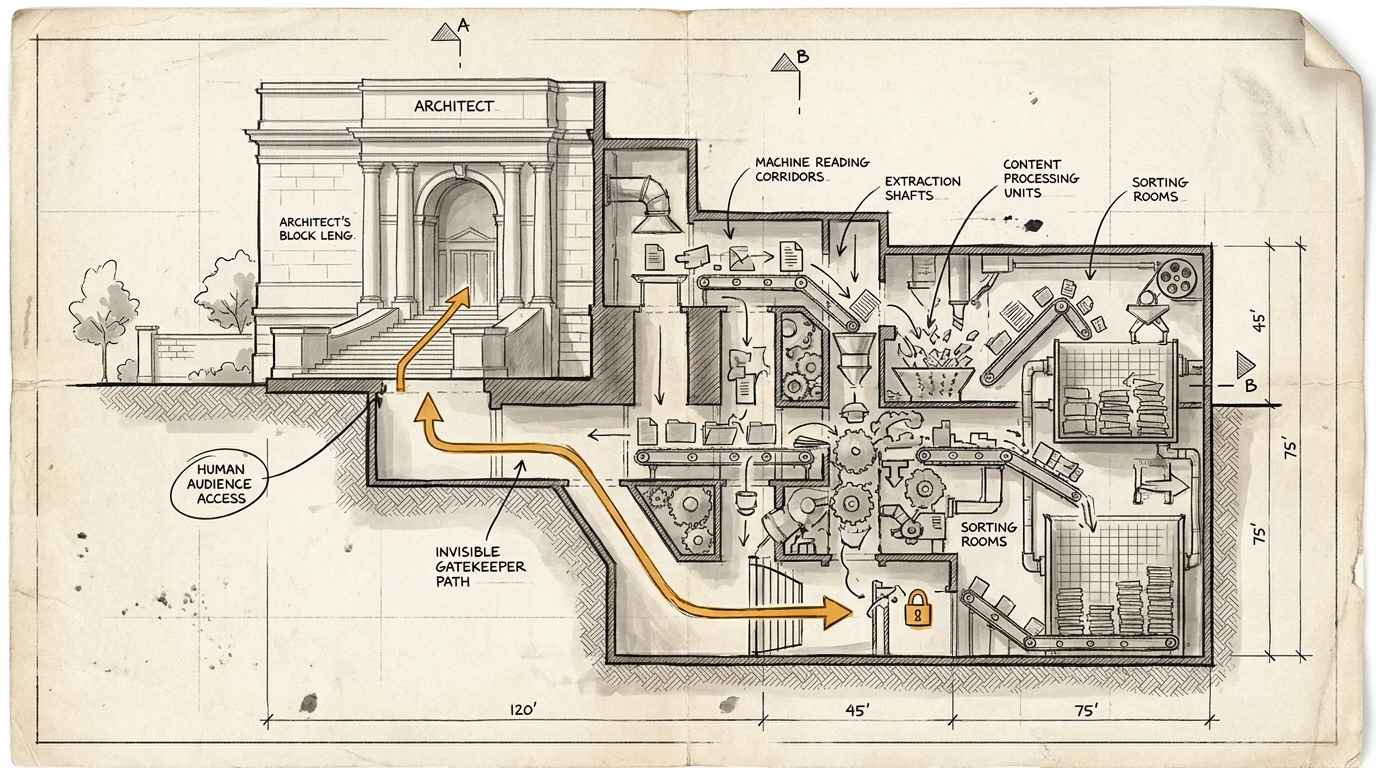

Der eigentliche Punkt ist: Zwischen eure Website und den Menschen schiebt sich immer öfter ein System, das vorher liest, vergleicht und zusammenfasst. Die Website hat damit eine zweite Nutzungslogik, aber die meisten KPI-Systeme kennen weiter nur die erste.

Und genau so fangen Organisationen an, die richtigen Teams für das falsche Signal zu bestrafen.

Warum dieses Briefing?

Hier wird gerade nicht bloß ein weiterer SEO-Trend sichtbar, sondern ein Umbau der gesamten Web-Logik.

Pew Research zeigte bereits im Juli 2025 für Google AI Overviews ein Muster, das man spätestens 2026 nicht mehr als Randnotiz behandeln sollte: Nutzer klicken deutlich seltener auf klassische Links, wenn eine AI Summary erscheint. So klicken nur 8 Prozent einen regulären Suchlink, wenn Google eine Summary anzeigt. Ohne Summary sind es 15 Prozent. Auf Quellen in der Summary selbst klicken Nutzer nur in 1 Prozent der Fälle.

Parallel baut Cloudflare mit AI Crawl Control inzwischen ein eigenes Produkt dafür, AI-Zugriffe auf Websites sichtbar, steuerbar und im Extremfall sogar monetarisierbar zu machen. Das allein ist schon ein Signal: Die neue Zielgruppe ist nicht hypothetisch. Sie ist operativ relevant genug, dass Infrastruktur-Anbieter daraus ein eigenes Steuerungsproblem machen.

Die eigentliche Verschiebung lautet also nicht: "Menschen verschwinden von Websites."

Sie lautet: Zwischen eure Website und den Menschen schiebt sich immer häufiger ein Gatekeeper, der vorher liest, einordnet und zusammenfasst.

Der Satz, über den ihr im nächsten Meeting sprechen solltet

Deine Website hat eine neue Zielgruppe. Aber dein Jahresbonus kennt sie nicht.

Ja, das ist scharf zugespitzt. Aber genau so laufen gerade viele Steuerungsfehler.

Die Website hat heute nicht mehr nur eine sichtbare Zielgruppe aus Menschen, die klicken, lesen, scrollen, kaufen oder ein Formular ausfüllen. Sie hat zusätzlich eine maschinelle Zielgruppe: Systeme, die Inhalte holen, Produkte vergleichen, Markenmerkmale extrahieren, Informationen in Antworten verdichten und Menschen oft erst danach, oder eben gar nicht mehr, auf die Website schicken.

Der Fehler wäre, daraus zu schließen, die menschliche Zielgruppe werde irrelevant.

Der eigentliche Punkt ist ein anderer: Die Website bekommt eine zweite Aufgabe, aber die meisten KPI-Systeme bewerten weiterhin nur die erste.

Wo der alte KPI-Reflex schief wird

Viele Teams interpretieren sinkenden Traffic noch immer automatisch als sinkende Relevanz.

Das war in der alten Logik oft vernünftig. Wenn weniger Menschen auf die Website kamen, war das meist ein belastbares Signal: geringere Sichtbarkeit, schlechtere Kampagne, schwächere Nachfrage oder stärkere Konkurrenz. Ehrlicherweise ist diese Logik spätestens seit Einführung von Consent-Bannern und Co. brüchig geworden.

In der neuen, KI-vermittelten Logik wird dieses Signal endgültig unsauber.

Weniger menschliche Besuche können jetzt gleichzeitig bedeuten:

- geringere Relevanz

- oder nur einen erfolgreicheren AI-Intermediär zwischen euch und dem Nutzer

- oder eine Verlagerung von Discovery aus Search und Social in LLMs und Agents

- oder eine höhere Vorqualifizierung, bevor überhaupt ein Mensch auf eure Website kommt

Traffic wird damit nicht wertlos.

Aber Traffic allein trennt immer schlechter zwischen Sichtbarkeitsverlust und strategisch sinnvoller Vorverlagerung.

Und genau dort kippen bestehende Zielsysteme.

Zwei Website-Typen, zwei Verschiebungen

Damit das nicht abstrakt bleibt, muss man mindestens zwischen zwei Fällen unterscheiden.

1. Conversion-Seiten

Das sind Seiten oder Bereiche mit klarem Call to Action: kaufen, registrieren, anfragen, Demo buchen, testen.

Hier bleibt der Mensch zentral. Aber später.

Die Maschine übernimmt immer häufiger die Discovery, die erste Einordnung, den Vergleich und Teile der Navigation. Die Website wird dadurch weniger Eingangstor und stärker Validierungs-, Vertrauens- und Abschlussort.

Für diese Seiten ist sinkender Traffic deshalb nicht automatisch eine Katastrophe, solange die Qualität der verbleibenden Besucher steigt. Und mit ihr Conversion-Rate, Average Order Value oder Customer Lifetime Value.

Die Management-Frage lautet hier nicht nur: Wie viele Menschen kommen?

Sondern: Wie vorbereitet kommen sie? Welche Informationen hat ein System ihnen vorher schon gegeben? Und wie gut funktioniert der Übergang vom maschinellen Pre-Sales in die eigentliche Conversion?

2. Brand- und Informationsseiten ohne direkte Conversion

Hier wird die Verschiebung radikaler.

Viele Markenwebsites ohne eigenen Direktverkauf lebten bisher davon, dass Traffic selbst schon als brauchbarer Proxy für Relevanz galt. Menschen kamen auf die Seite, informierten sich, lernten die Marke kennen und gingen später an einen anderen Touchpoint weiter: Handel, Plattform, Vertriebspartner, stationärer Verkauf.

Wenn nun AI-Systeme diese Informationsarbeit immer häufiger vorwegnehmen, kann die Website strategisch wichtig bleiben oder sogar wichtiger werden, während der direkte menschliche Besuch sinkt.

Dann kippt der alte KPI-Reflex besonders schnell ins Falsche.

Denn die Frage ist nicht mehr nur:

"Wie viele Menschen waren auf der Seite?"

Sondern zunehmend:

"Wird die Marke in den Systemen, die für Menschen vorfiltern, korrekt verstanden und repräsentiert?"

Warum das gerade für deutsche Unternehmen heikel wird

Im DACH-Raum trifft diese Verschiebung auf eine Web-Realität, die vielerorts ohnehin schief organisiert ist.

Viele Unternehmensseiten sind bis heute vor allem für drei Dinge optimiert:

- Kampagnen-Reporting

- interne Zuständigkeitsgrenzen

- schöne Oberflächen für Menschen, die ohnehin schon fast entschieden haben

Das reicht in einer Welt, in der die Website vor allem Schaufenster ist.

Es reicht schlechter in einer Welt, in der Systeme vorher lesen, vergleichen und zusammenfassen.

Gerade in Deutschland wird das an drei Typen von Unternehmen schnell sichtbar:

- Hersteller ohne Direktvertrieb, deren Website bisher vor allem Marke, Produktwelt und Vertrauen tragen sollte

- regulierte Anbieter, bei denen korrekte Leistungsbeschreibung, Haftungsgrenzen und Produktdetails zählen

- B2B-Unternehmen mit komplexen Angeboten, bei denen Menschen bisher viel implizites Vorwissen brauchten, um überhaupt zu verstehen, worum es geht

Für diese Unternehmen ist die Website nicht einfach Marketingfläche. Sie wird zunehmend Lesematerial für Systeme, die später Sichtbarkeit, Vergleich und Vorauswahl mitprägen.

Zugespitzt bedeutet das: Wer das nur als SEO-Frage behandelt, unterschätzt die Lage.

Das eigentliche Steuerungsproblem

Die neue Zielgruppe ist nicht im Widerspruch zur alten.

Der Widerspruch entsteht erst im Steuerungssystem.

Denn die Website muss plötzlich zwei Dinge gleichzeitig leisten:

- für Menschen überzeugen, Vertrauen aufbauen und gegebenenfalls konvertieren

- für Maschinen klar, zugänglich, extrahierbar und zitierfähig sein

Diese beiden Logiken überlappen sich teilweise. Aber sie sind nicht identisch.

Ein Mensch reagiert auf Dramaturgie, Design, Tonalität, soziale Beweise, Friktion und Timing.

Eine Maschine reagiert auf Klarheit, Struktur, Vollständigkeit, Aktualität und stabile technische Zugänglichkeit.

Wer nur auf die menschliche Journey optimiert, verliert an maschineller Lesbarkeit.

Wer nur auf Maschinen optimiert, beschädigt irgendwann die menschliche Erfahrung.

Die richtige Frage lautet deshalb nicht:

"Optimieren wir künftig für Menschen oder für Maschinen?"

Sondern:

"Welche Teile unserer Website erfüllen welche Aufgabe für wen, und welche Kennzahlen bilden diese Aufgabe überhaupt noch sinnvoll ab?"

Das ist keine Tool-Frage. Das ist Operating Model.

Warum klassische Analytics zu wenig zeigen

Das zusätzliche Problem: Die neue Zielgruppe ist oft gerade dort unsichtbar, wo Marketing traditionell hinschaut.

Cookie-basierte Analytics sehen viele dieser Zugriffe nicht. Textbasierte Agenten tauchen dort oft gar nicht, oder nicht sinnvoll auf. Selbst wenn agentische Besuche messbar werden, landen sie in Reports leicht als Rauschen, Direct Traffic oder technische Anomalie.

Damit entsteht eine gefährliche Asymmetrie:

- Die Website arbeitet real für eine zusätzliche Zielgruppe.

- CDN-, Server- und Log-Daten spüren das.

- Das klassische Marketing-Dashboard nicht.

Das ist der Grund, warum viele Unternehmen die Verschiebung zu spät bemerken.

Nicht weil sie nicht stattfindet.

Sondern weil die Instrumente, mit denen sie auf die Website schauen, aus einer anderen Internet-Logik stammen.

Was sich jetzt ändern muss

Nicht alles umbauen. Aber vier Dinge jetzt prüfen.

1. Website in Nutzungslogiken statt Seitenbäumen kartieren

Welche Bereiche dienen primär der Conversion? Welche der Vertrauensbildung? Welche der Markenorientierung? Welche primär der maschinellen Extraktion?

2. KPI- und Bonuslogiken prüfen

Wo belohnt ihr noch reines Besuchsvolumen, obwohl der strategische Wert längst an anderer Stelle entsteht?

3. Unter die Analytics-Oberfläche schauen

Wenn ihr nur GA4, Piwik Pro oder Adobe Analytics/CJA seht, seht ihr zu wenig. CDN-, Server- und Log-Daten werden zur Voraussetzung, um die neue Zielgruppe überhaupt wahrzunehmen.

4. Metriken nach Website-Typ trennen

Conversion-Seiten brauchen andere Kennzahlen als Brand- und Informationsseiten. Wer alles durch dieselbe Traffic-Brille anschaut, misst nicht Effizienz, sondern Bequemlichkeit.

Ehrlichkeitstest

Drei Einwände sind fair.

Erstens: Nicht jede Branche spürt diese Verschiebung gleich schnell. Wer fast nur über Bestand, Beziehung oder Außendienst verkauft, wird langsamer kippen als ein digitaler Vergleichsmarkt.

Zweitens: Traffic bleibt natürlich weiter relevant. Niemand sollte jetzt so tun, als wären Besuche plötzlich egal. Der Fehler liegt nicht im Messen von Traffic. Der Fehler liegt darin, Traffic weiter für die ganze Wahrheit zu halten.

Drittens: Die neuen Messmodelle sind selbst noch roh. Viele Unternehmen werden am Anfang mit unsauberen Proxys arbeiten müssen. Das ist nicht schön. Aber immer noch besser als Bonuslogiken, die eine Zielgruppe ignorieren, die operativ längst mitliest.

Einordnung

Die meisten Website-Debatten der letzten Jahre waren Debatten über Kanäle: Search, Social, Paid, Organic, CRO.

Diese Debatte verschiebt sich gerade auf eine tiefere Ebene.

Es geht nicht mehr nur darum, wie Menschen auf eure Website kommen. Es geht darum, wer eure Website überhaupt nutzt, bevor ein Mensch sie sieht.

Das ist der Grund, warum dieses Thema nicht im SEO-Silo bleiben sollte. Und auch nicht in einem technischen AI-Task-Force-Format.

Es gehört ins Management. Denn die strategische Frage lautet nicht:

"Wie holen wir wieder mehr Traffic?"

Sondern:

"Wie steuern wir eine Website, die gleichzeitig für Menschen wirken und für Maschinen lesbar sein muss, wenn unser Zielsystem bisher nur die menschliche Hälfte kennt?"

Wer diese Frage jetzt nicht stellt, hat kein Website-Problem. Er hat ein Steuerungsproblem. Und Steuerungsprobleme werden in Organisationen fast immer erst dann sichtbar, wenn man die falschen Teams bereits bestraft hat.