Das falsche Black-Box-Problem

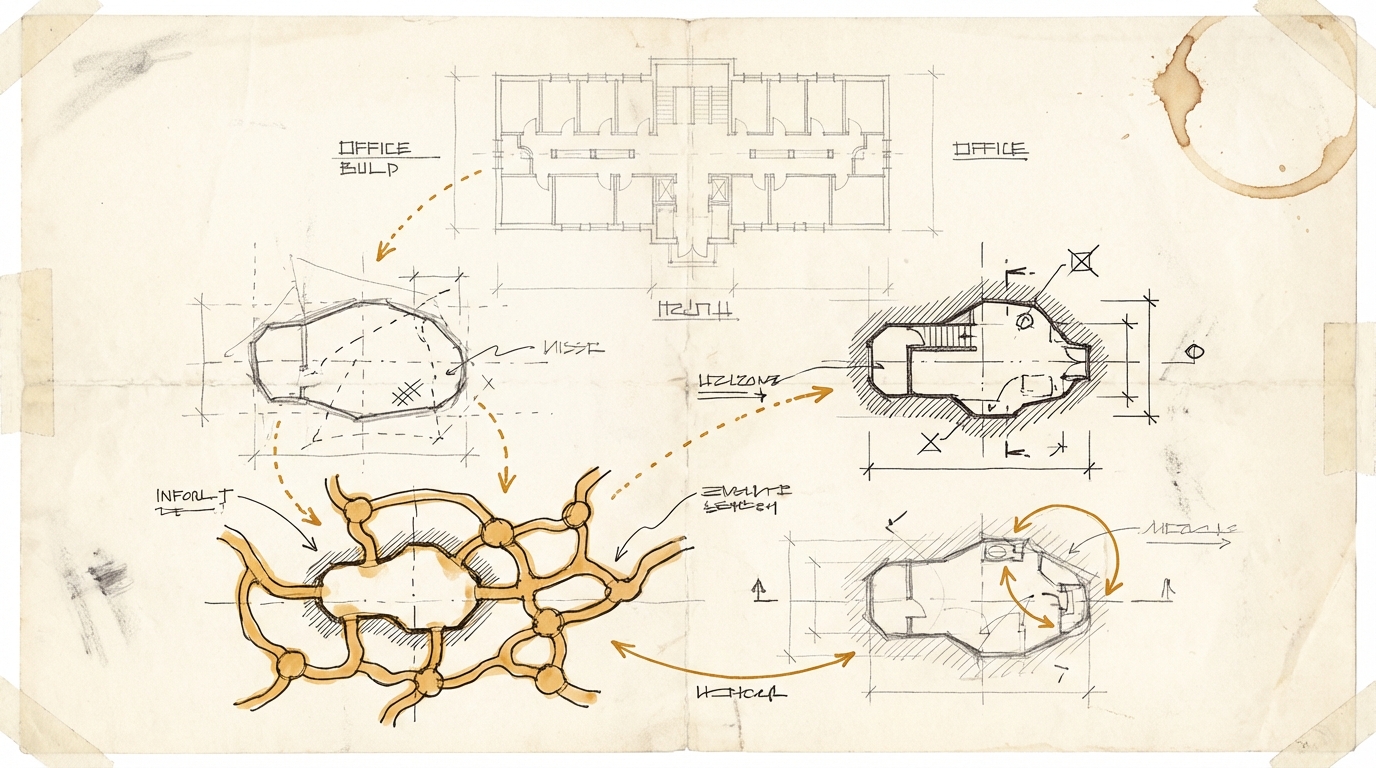

Letzte Woche saßen irgendwo in Deutschland acht Führungskräfte in einem Workshop. Die Frage war simpel: Welchen Kontext, welches Wissen aus dem Unternehmen braucht ein Agent, damit er sinnvoll mitarbeiten kann?

Praktischer Test zum Essay

Drei Vorlagen für ein Gespräch mit einer KI: Ziel klären, Widersprüche prüfen, Delegierbarkeit testen. Du bekommst keine fertige Strategie und keine Tool-Empfehlung.

Vorlagen öffnenVier Stunden später hing eine Liste mit 47 Wissensbausteinen an der Wand.

- 21 davon existierten nirgendwo als Dokument

- 7 davon konnte niemand im Raum sauber erklären

- Bei 4 wurde es still, weil allen klar war: Die dokumentierte Version ist nicht die, nach der tatsächlich entschieden wird

Das war keine Kuriosität. Das war eine ziemlich genaue Diagnose.

Bleib auf dem Laufenden

Erhalte eine Nachricht, wenn ein neuer Essay erscheint. Jederzeit abbestellbar.

Die ersten 21 sind Dokumentationsschuld. Die nächsten 7 sind stilles Können. Die letzten 4 sind Politik.

Und genau deshalb laufen so viele AI-Projekte schief. Man arbeitet am Modell, an den Prompts, an den Guardrails und an den Tools. Das eigentliche Problem sitzt aber oft im Unternehmen selbst. Genauer gesagt: in allem, was nur halb beschrieben, nur implizit verstanden oder nur politisch verwaltet ist.

Das ist der schiefe Teil der Debatte. Die Maschinen werden gerade lesbarer. Traces, Specs, Safety Layers, Audits: Alles noch unfertig, aber die Richtung ist klar. Ausgerechnet jetzt merken viele Unternehmen, dass sie ihre eigene Entscheidungslogik oft nur als plausible Geschichte kennen.

Viele AI-Projekte scheitern nicht zuerst daran, dass das Modell eine Black Box ist. Sie scheitern daran, dass die Firma selbst keine saubere Beschreibung ihrer eigenen Logik hat.

Im Kern stecken dahinter drei verschiedene Probleme, die gern in einen Topf geworfen werden: Wissen, das nie dokumentiert wurde. Wissen, das sich nur schwer in Sprache bringen lässt. Und Wissen, das man nicht offen hinschreiben will, weil sofort Interessen, Macht oder Bequemlichkeit berührt sind.

Solange Menschen diese Lücken überbrücken, wirkt das wie Kultur. Sobald ein Agent mitarbeiten soll, wird daraus zwangsläufig Betrieb.

Die Maschine wird lesbarer. Die Organisation nicht

Wenn heute von Erklärbarkeit gesprochen wird, geht der Blick fast automatisch auf das Modell. Reasoning Chains. Traces. Safety Layers. Evaluations. Alles wichtig.

Stellt dieselben Fragen einmal an die eigene Organisation.

Warum wurde Kunde X priorisiert?

Warum ist Produktidee Y nie durchs Budget gekommen?

Warum dauert Freigabe A offiziell drei Wochen, praktisch aber zwei Telefonate?

Warum bekommt Bereich B zuverlässig Ressourcen, obwohl die Strategie auf dem Papier woanders hinzeigt?

In den meisten Unternehmen bekommt man auf diese Fragen keine Erklärung. Man bekommt eine brauchbare Geschichte.

Das ist nicht dasselbe.

Chris Argyris hat dafür die saubere Unterscheidung geprägt: Es gibt die espoused theory, also das, was eine Organisation über sich sagt. Und es gibt die theory-in-use, also das Muster, nach dem sie tatsächlich handelt. Mit dieser Lücke können Menschen erstaunlich gut leben. Sie lesen zwischen den Zeilen. Sie kennen die Abkürzungen. Sie wissen, wen man anruft, wenn das Ticket-System nicht weiterhilft.

Ein Agent kann das nicht.

Er arbeitet auf Regeln, Dokumenten, Kriterien und Schnittstellen. Auf dem, was explizit gemacht wurde. Wenn die offizielle Beschreibung und das reale Verhalten auseinanderlaufen, arbeitet er auf einer Version des Unternehmens, die es so gar nicht gibt.

Dann wirkt der Agent plötzlich dumm, obwohl er nur genau das tut, was man ihm gesagt hat.

Die ersten 21: Was nie sauber aufgeschrieben wurde

Fangen wir mit dem harmlosesten Teil an.

21 der 47 Wissensbausteine waren weder geheim noch besonders schwer zu verstehen. Sie waren einfach nie sauber festgehalten.

Das klingt banal. Ist es nicht. Genau an dieser Stelle belügen viele Unternehmen sich selbst. Sie sagen dann: "Wir haben doch alles in Confluence." Oder: "Dafür gibt es irgendwo ein Playbook." Meistens heißt das nur, dass es Dokumente gibt. Nicht, dass der relevante Kontext darin lebt.

Im Text zum maschinenlesbaren Kontext habe ich das Müller-Problem beschrieben. Die echte Preislogik, die Sonderfälle, die Abkürzungen, die impliziten Freigaben, der Grund, warum Angebot A funktioniert und Angebot B nicht, stecken im Kopf der Leute, die lange genug dabei sind. Solange diese Leute erreichbar sind, fühlt sich das System robust an. Es ist es nicht.

Der Schritt von Kopf zu Dokument ist unerquicklich, aber nicht geheimnisvoll.

Interviews führen. Entscheidungen nachzeichnen. Artefakte zusammenziehen. Widersprüche auflösen. Versionen bereinigen.

Das ist keine Erkenntniskrise. Das ist Fleißarbeit. Und es ist klassisches Change Management, weil man den Menschen die Angst nehmen muss, dass sie ersetzt werden, wenn das Wissen aus ihrem Kopf in der Welt dokumentiert wird.

Wer an dieser Stelle schon genervt abwinkt, ist für ernsthafte Agentensysteme nicht bereit. Und, ganz ehrlich, wird es nie werden. Nicht, weil die Technologie fehlt. Sondern weil die eigene Organisation ihr Wissen immer noch wie ein zufälliges Nebenprodukt behandelt.

Die nächsten 7: Was Leute können, aber nicht sauber erklären

Danach wird es interessanter.

7 Wissensbausteine konnte niemand im Raum vollständig erklären. Nicht, weil die Beteiligten ahnungslos gewesen wären. Eher im Gegenteil. Man merkte, dass alle ungefähr wussten, worum es geht. Nur eben nicht in einer Form, die sich sauber in Sätze bringen lässt.

Der Satz von Michael Polanyi ist abgenutzt, aber der Kern stimmt: Wir wissen mehr, als wir sagen können.

Ein relevanter Teil praktischen Wissens liegt eben nicht als explizite Regel vor. Er zeigt sich in Urteilen, Vergleichen, Routinen und gewachsenen Fähigkeiten. Die erfahrene Einkäuferin merkt an zwei Nebensätzen, dass ein Lieferant blufft. Der Serviceleiter hört an einer Formulierung, dass ein Kunde nicht Hilfe sucht, sondern eine Eskalation vorbereitet. Der Produktionsplaner sieht in einer normalen Anfrage schon das Problem des Folgemonats.

Dieses Wissen ist real. Es hat wirtschaftlichen Wert. Und es lässt sich oft nur begrenzt in Regeln übersetzen.

Genau deshalb scheitern viele AI-Initiativen nicht erst am Prompting, sondern an einem schlichteren Denkfehler. Man tut so, als müsse man das vorhandene Wissen nur aus den Systemen ziehen und sauber aufschreiben. In Wahrheit ist ein Teil davon gar nicht als Satz gespeichert. Er lebt in Vergleichen, Routinen, Beziehungsmustern und feinen Signalen.

Das heißt nicht, dass man kapitulieren sollte. Es heißt nur, dass man das Problem sauberer benennen muss.

Die Aufgabe lautet nicht: alles aufschreiben. Die Aufgabe lautet: trennen, was sich formalisieren lässt, was man trainieren muss und was menschliches Urteil bleiben sollte.

Das ist anspruchsvoller. Und für DACH-Unternehmen ist es besonders wichtig, weil viele ihrer Wettbewerbsvorteile genau in solchen verdichteten Fähigkeitsbündeln liegen. Nicht in der großen Strategieformel, sondern in der stillen Präzision, mit der eine Organisation komplizierte Situationen zuverlässig behandelt.

Außerdem ist das genau der Punkt, mit dem man seinen Mitarbeitenden die Gewissheit geben kann, eben gerade nicht in wenigen Monaten auf der Straße zu sitzen, sondern im Gegenteil, wichtiger denn je für das gebraucht zu werden, was genuin menschlich ist: die Fähigkeit, aus der eigenen, impliziten Erfahrung heraus entscheiden zu können.

Die letzten 4: Was offiziell anders erzählt wird, als es läuft

Und dann gibt es die vier stillen Wissensbausteine.

Das sind die Stellen, an denen Leute kurz lachen, wegschauen oder einen Satz mit "naja" beginnen.

Hier geht es nicht mehr nur darum, dass etwas schwer in Sprache zu fassen ist. Hier geht es darum, dass man es nicht sauber hinschreiben will, weil die offene Version sofort soziale Kosten hätte.

Die offizielle Strategie sagt vielleicht, dass alle Kunden nach Profitabilität priorisiert werden. Tatsächlich bekommen zwei Großkunden Sonderbehandlung, weil der Vorstand dort persönliche Beziehungen pflegt.

Offiziell werden Projekte nach Business Case bewertet. Tatsächlich überlebt ein Projekt, weil es an einer Person hängt, die intern zu mächtig ist, um ihr Thema sterben zu lassen.

Offiziell soll eine AI-Initiative Prozesse standardisieren. Tatsächlich verteidigen drei Bereichsleiter ihre Sonderlogik, weil diese Sonderlogik Macht, Budget oder Unersetzbarkeit sichert.

Das ist nicht die schmutzige Ausnahme einer ansonsten rationalen Organisation. Das ist normale Organisation.

Die offizielle Begründung erfüllt dabei eine soziale Funktion. Sie wahrt Gesichter, hält Beziehungen intakt und macht Macht nicht zu sichtbar.

Genau deshalb stößt AI-Transformation an dieser Stelle nicht zuerst an Technik, sondern an Ehrlichkeit. Wer einem Agenten beibringen will, wie Entscheidungen wirklich fallen, muss offener legen, wie Entscheidungen wirklich fallen. Und genau das wollen viele Unternehmen nicht. Manchmal nicht einmal vor sich selbst.

Context Engineering ist an dieser Stelle nicht nur Wissensarbeit. Es ist Machtarbeit.

Wenn der Agent der offiziellen Version glaubt

Man konnte diese Widersprüche schon immer als kulturelle Macke behandeln. Ein bisschen informelle Organisation hier, ein bisschen politische Trägheit dort. Nervig, aber normal.

Mit AI wird daraus etwas Teureres.

Denn der Agent unterscheidet nicht zwischen offiziell und tatsächlich, wenn man ihm nur die offizielle Version gibt. Er setzt konsequent das um, was explizit gemacht wurde.

Dann passieren drei Dinge.

Erstens: Der Agent trifft formal korrekte, praktisch falsche Entscheidungen. Er folgt der schriftlichen Priorisierungslogik und landet trotzdem neben der Realität.

Zweitens: Das Unternehmen diagnostiziert den Fehler an der falschen Stelle. Statt zu sagen "unsere Beschreibung der Organisation war falsch", sagt es "der Agent versteht unser Geschäft nicht".

Drittens: Die informelle Organisation verschwindet nicht. Sie wächst nur um einen zusätzlichen Layer aus Workarounds. Menschen bauen den Agenten ein, umgehen ihn danach und produzieren neue Schattenarbeit um das versprochene Standard-System herum.

Das ist einer der Gründe, warum so viele frühe AI-Implementierungen beeindruckend klingen und im Alltag trotzdem in graue Zusatzarbeit kippen. Die Organisation hat versucht, ihre offizielle Fiktion zu automatisieren. Die Realität musste sich danach wieder ihren Weg suchen.

Der eine Wissenshorter ist selten das eigentliche Problem

Es ist bequem, das Problem an einer Person festzumachen. Dem Bereichsleiter, der alles im Kopf behält. Dem Team mit der Excel-Hölle. Dem einen Manager, ohne den angeblich nichts geht.

Nur ist das selten der ganze Befund.

Das eigentliche Problem ist meist ein System, das Wissensasymmetrie belohnt. Der Bereich mit der eigenen Excel-Hölle ist nicht nur chaotisch. Er schützt oft einen Machtvorteil. Die diffuse Prozesslandschaft ist nicht bloß historisch gewachsen. Sie hält Zuständigkeiten manchmal ganz absichtlich unscharf.

Deshalb greifen naive Transparenz-Parolen so selten.

"Wir müssen nur alles dokumentieren" klingt vernünftig. Aber sobald Dokumentation Einfluss, Verhandlungsmacht oder Schutzräume berührt, kommt Widerstand. Nicht immer offen. Oft als vernünftige Sorge formuliert:

"Dafür ist der Fall zu komplex."

"Das lässt sich nicht standardisieren."

"Da gehen wichtige Nuancen verloren."

Manchmal stimmt das sogar. Genau deshalb ist das Thema unerquicklich. Zwischen echter Komplexität und taktischer Opazität zu unterscheiden, ist Führungsarbeit. Nicht Tool-Auswahl.

Im DACH-Raum liegen stilles Können und Selbsttäuschung nah beieinander

In deutschen Diskussionen kippt diese Lage oft in zwei schlechte Geschichten.

Die eine ist Silicon-Valley-Romantik. Alles Informelle gilt als dysfunktional. Die Lösung sei totale Transparenz, totale Messbarkeit, totale Standardisierung.

Die andere ist Kulturromantik. Alles Informelle gilt als wertvolles Erfahrungswissen. Die Lösung sei, die Organisation in Ruhe zu lassen und nur ein paar gute Tools einzuführen.

Beides ist zu einfach.

Gerade im DACH-Raum gibt es viele Unternehmen, in denen still verdichtetes Erfahrungswissen ein echter Wettbewerbsvorteil ist. Mittelstand, Industrie, B2B-Vertrieb, regulierte Umfelder. Dort lebt viel Wert in Nuancen, in lang eingeübten Urteilen, in informellen Koordinationsmustern, die auf keinem Organigramm sichtbar sind.

Aber derselbe Raum produziert auch robuste Formen der Selbsttäuschung. Man verwechselt historisch gewachsene Praxis mit zwingender Notwendigkeit. Man verwechselt Machtkompromisse mit vernünftigen Prozessen. Man verwechselt mangelnde Klarheit mit professioneller Komplexität.

Im regulierten Raum kommt noch etwas dazu. Wer einem Betriebsrat, einem Datenschutzbeauftragten oder einer Revision erklären will, warum ein Agent entscheiden darf, was er entscheiden soll, muss mehr explizieren als bisher. Das bremst. Es diszipliniert aber auch. Der DACH-Raum ist an dieser Stelle nicht nur langsamer. Er kann, wenn er es ernst meint, auch ehrlicher werden.

Die eigentliche Unterscheidung lautet deshalb:

Was davon ist verdichtete Intelligenz?

Was davon ist angesammelte Bequemlichkeit?

Was davon ist Schutz vor realem Risiko?

Und was davon ist nur Schutz vor Sichtbarkeit?

Ohne diese Unterscheidung baut ihr Agenten entweder auf Sand. Oder ihr zerstört still genau die wenigen informellen Strukturen, die euch tatsächlich besser machen.

Beides ist teuer.

Drei Fragen vor dem ersten Agentenprojekt

Keine Checkliste. Eher drei Fragen, an denen man merkt, ob das Problem bei euch schon operativ ist.

Erstens: Wo lebt das relevante Wissen wirklich?

In Köpfen? In PDFs? In Tickets? In stillen Beziehungsmustern? Oder schon in einer Form, mit der eine Maschine arbeiten kann?

Wenn die ehrliche Antwort überwiegend Kopf, Meeting und Bauchgefühl lautet, ist das kein Argument gegen AI. Es ist ein Argument gegen Selbstüberschätzung.

Zweitens: Was davon ist wirklich schwer zu sagen, und was will man nur nicht offen sagen?

Das ist die Kernunterscheidung dieses Textes. Von außen sieht beides ähnlich aus: Etwas bleibt unscharf. Aber die Gründe sind verschieden. Das eine braucht Geduld, Beobachtung und bessere Beschreibung. Das andere braucht Mut, Konfliktfähigkeit und manchmal eine Machtentscheidung.

Wer beides verwechselt, wählt die falsche Intervention.

Drittens: Was passiert, wenn der Agent exakt der offiziellen Version eurer Organisation folgt?

Nicht der gelebten. Der offiziellen.

Wenn euch das Ergebnis unruhig macht, habt ihr die eigentliche Diagnose.

Ehrlichkeitstest: Wo ich es mir zu einfach machen könnte

Drei Einwände gegen mein eigenes Argument. Ich halte sie für real.

Erstens: Nicht jedes Unternehmen braucht diese Tiefe. Wer einen simplen Service-Chatbot einführt, muss nicht sofort eine organisatorische Tiefenanalyse starten. Es gibt genug AI-Projekte, bei denen saubere Prozesse, brauchbare Daten und ein enger Scope reichen. Wenn ich diese Diagnose auf jede Automatisierung gleich stark anwende, überdehne ich das Argument.

Zweitens: Nicht alles Informelle ist ein Problem. Manche stillen Hilfslinien, manche situativen Urteile, manche Beziehungen verlieren an Qualität, wenn man sie zu früh in starre Regeln presst. Es gibt informelle Strukturen, die nicht Intransparenz kaschieren, sondern Komplexität handhabbar machen. Wer alles sichtbar machen will, kann genau die Intelligenz beschädigen, die er eigentlich erhalten wollte.

Drittens: Ich könnte die politische Seite überbetonen. Nicht jede Unschärfe ist Machtspiel. Manches ist einfach historisch gewachsen, schlecht dokumentiert oder wirklich schwer zu formalisieren. Wenn man zu schnell Interessen unterstellt, wird aus Diagnose Verdacht. Dann schaut man überall nach Taktik und übersieht die banalere Wahrheit: Niemand hat sich die Mühe gemacht, die Sache sauber zu beschreiben.

Trotzdem bleibt der Kernpunkt stehen.

Die eigentliche Frage ist nicht, ob etwas formal oder informell läuft. Die eigentliche Frage ist: Welche Informalität trägt Wert, und welche hält nur Widersprüche unsichtbar?

Das Schwierigste an Context Engineering ist nicht, Wissen maschinenlesbar zu machen.

Das Schwierigste ist, ehrlich hinzusehen, welcher Art dieses Wissen überhaupt ist.

47 Wissensbausteine.

21 nicht dokumentiert.

7 nicht sauber artikulierbar.

4 nicht aussprechbar.

Die ersten 21 sind Arbeit.

Die nächsten 7 sind Demut.

Die letzten 4 sind Mut.

Die Maschine wird jedes Quartal lesbarer.

Eure Organisation nicht unbedingt.

Und der Grund dafür ist oft nicht technische Komplexität.

Der Grund ist, dass viele Unternehmen noch nicht entschieden haben, wie viel Wahrheit ihre eigene Organisation aushält.

Praktischer Test zum Essay

Drei Vorlagen für ein Gespräch mit einer KI: Ziel klären, Widersprüche prüfen, Delegierbarkeit testen. Du bekommst keine fertige Strategie und keine Tool-Empfehlung.

Vorlagen öffnen