Vom Nadelöhr zur Runtime: Das eigentliche Apple-Play

Vor zwei Wochen habe ich in Das Nadelöhr vor allem auf den Kontrollpunkt geschaut: Apple öffnet das Protokoll, kontrolliert aber das Gateway darunter. Der Gedanke trägt immer noch. Aber er war nur die halbe Geschichte.

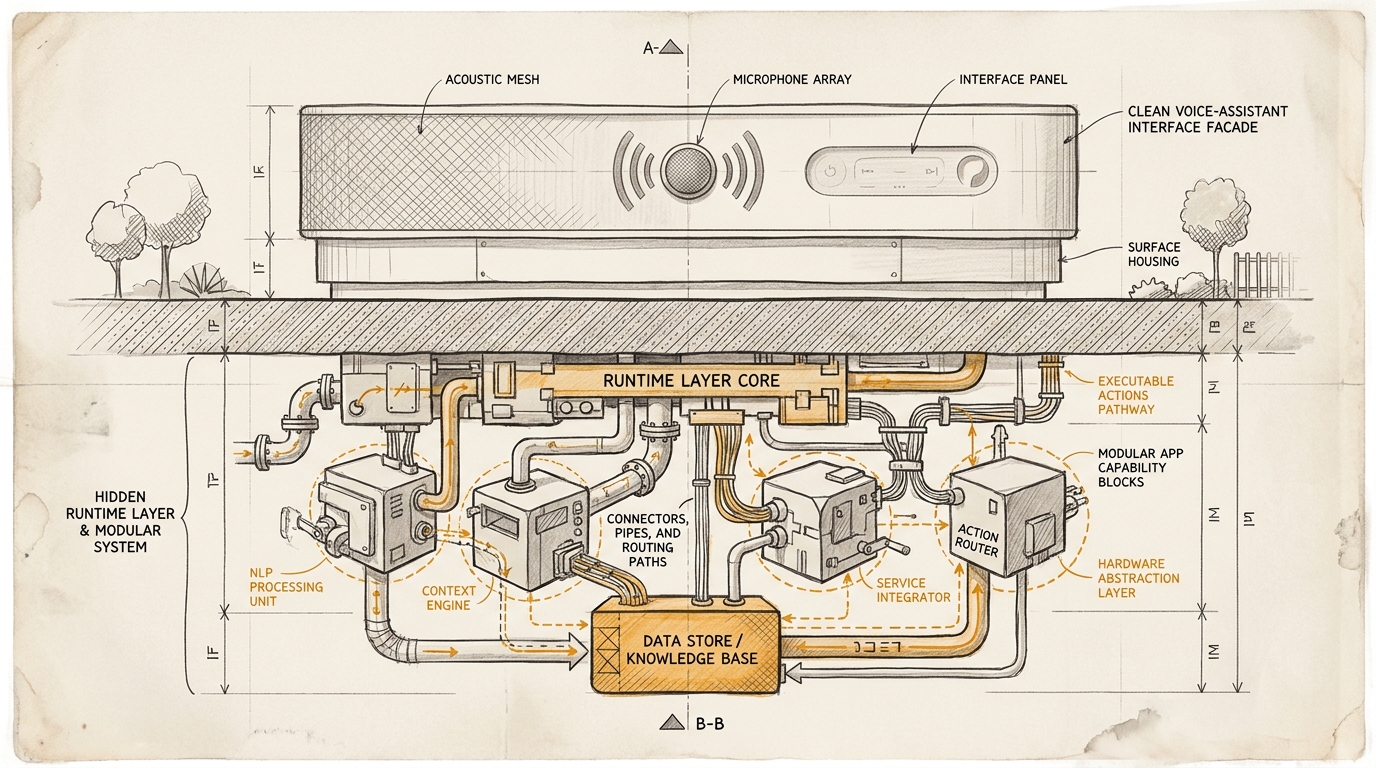

Je mehr ich mir die offiziellen Apple-Linien, Interviews und früheren WWDC-Sessions anschaue, desto klarer wird: Apple baut hier nicht plötzlich einen großen AI-Wurf zusammen. Apple legt seit zwei WWDCs ziemlich systematisch die Grundlagen für eine andere Schicht. Nicht den Chatbot als Ziel. Sondern die Runtime, durch die Apps für Siri, Apple Intelligence und später wahrscheinlich auch für Agents handlungsfähig werden.

Das ist ein wichtiger Unterschied. Wer nur auf Siri schaut, sieht ein Produkt und fragt, ob es endlich mit ChatGPT mithalten kann. Wer auf App Intents schaut, sieht die tiefere Bewegung: Apple übersetzt App-Funktionen in etwas, das das System adressieren, kombinieren und ausführen kann. Nicht die Antwort ist der eigentliche Hebel. Die adressierbare Fähigkeit ist der Hebel.

Genau deshalb wirkt die öffentliche Debatte oft schief. Sie behandelt Apple noch immer so, als würde das Unternehmen zu spät in ein bestehendes Rennen einsteigen. Aber Apple versucht gar nicht unbedingt, das Rennen um den besten einzelnen Assistenten frontal zu gewinnen. Apple versucht, die Schicht zu kontrollieren, in der Assistenz auf dem Gerät nützlich wird.

Die offiziellen Signale dafür sind mittlerweile schwer zu übersehen. WWDC24 hatte Sessions wie „Bring your app to Siri“ und „Bring your app’s core features to users with App Intents“. WWDC25 schiebt mit „Explore new advances in App Intents“ nach. In der Developer-Dokumentation beschreibt Apple App Intents explizit als Brücke zu Siri und Apple Intelligence. Und im WWDC-Interview sagt Craig Federighi sinngemäß dasselbe auf strategischer Ebene: kein Chatbot als Ziel, sondern AI, die „within reach whenever you need it“ ist.

Das verändert auch den Blick auf Apps und Marken. Bisher war die relevante Frage oft: Ist meine Marke auffindbar, wenn Menschen suchen? Dann wurde daraus: Bin ich sichtbar, wenn LLMs empfehlen? Die nächste Frage ist strenger: Kann ein System überhaupt mit meinem Angebot arbeiten? Kann es Funktionen auslösen, Informationen abrufen, Optionen vergleichen, Zustände verstehen? Sichtbarkeit bleibt wichtig. Aber sie kippt langsam in Handlungsfähigkeit.

Bleib auf dem Laufenden

Erhalte eine Nachricht, wenn ein neuer Essay erscheint. Jederzeit abbestellbar.

Damit wird aus AI Readiness etwas sehr Konkretes. Nicht nur Content, nicht nur Metadaten, nicht nur schöne Oberflächen. Sondern Fähigkeiten, die sauber beschrieben, strukturiert und systemisch adressierbar sind. Genau hier wird App Intents interessant. Nicht als Developer-Detail. Sondern als früher Hinweis darauf, wo das neue Nadelöhr sitzt.

Und vielleicht ist das der eigentliche Denkfortschritt seit der ersten Notiz. Ich hatte Apple vor allem als Gatekeeper gelesen. Das stimmt weiterhin. Aber die Gatekeeper-Logik ist hier fast schon zu defensiv gedacht. Apple verteidigt nicht nur ein Tor. Apple baut die Straße dahinter.

Für Unternehmen ist das die unbequemere Einsicht. Man kann den Chatbot-Hype aussitzen. Man kann abwarten, welche Oberfläche gewinnt. Aber wenn sich darunter eine Capability-Schicht stabilisiert, wird Warten riskant. Dann geht es nicht mehr nur darum, wie gut man beschrieben ist. Sondern darum, ob man überhaupt in eine Welt passt, in der Systeme statt Menschen durch Menüs klicken.

Vielleicht ist das Apples eigentliches AI-Play: nicht der beste Gesprächspartner zu werden, sondern die Laufzeitumgebung, in der digitale Fähigkeiten für den Alltag nutzbar werden.

Wenn ihr auf eure digitalen Produkte schaut: Was daran ist heute nur für Menschen mit Augen, Maus und Geduld gebaut? Und was davon wäre für ein System überhaupt als Fähigkeit erkennbar?

Quellen

- Apple Developer Documentation: Integrating actions with Siri and Apple Intelligence

- Apple Developer WWDC24: Bring your app to Siri

- Apple Developer WWDC24: Bring your app’s core features to users with App Intents

- Apple Developer WWDC25: Explore new advances in App Intents

- Tom’s Guide: WWDC interview with Craig Federighi and Greg Joswiak

- Nate B. Jones: The Company Everyone Says Lost the AI Race Is Building the Layer Every AI Winner Has to Use