Plausibel klingender Unsinn

Benedict Evans hat diese Woche ein Konzept aufgegriffen, das Ethan Mollick und Fabrizio Dell'Acqua 2023 in einer BCG-Studie empirisch belegt haben: die jagged technological frontier. Die gezackte technologische Grenze.

Die Kurzfassung: LLMs haben keine gleichmäßige Kompetenzgrenze. Sie lösen manche Aufgaben besser als menschliche Experten und scheitern bei anderen, die trivial aussehen. Das Problem: Ihr wisst vorher nicht, auf welcher Seite der Grenze ihr gerade steht.

Bleib auf dem Laufenden

Erhalte eine Nachricht, wenn ein neuer Essay erscheint. Jederzeit abbestellbar.

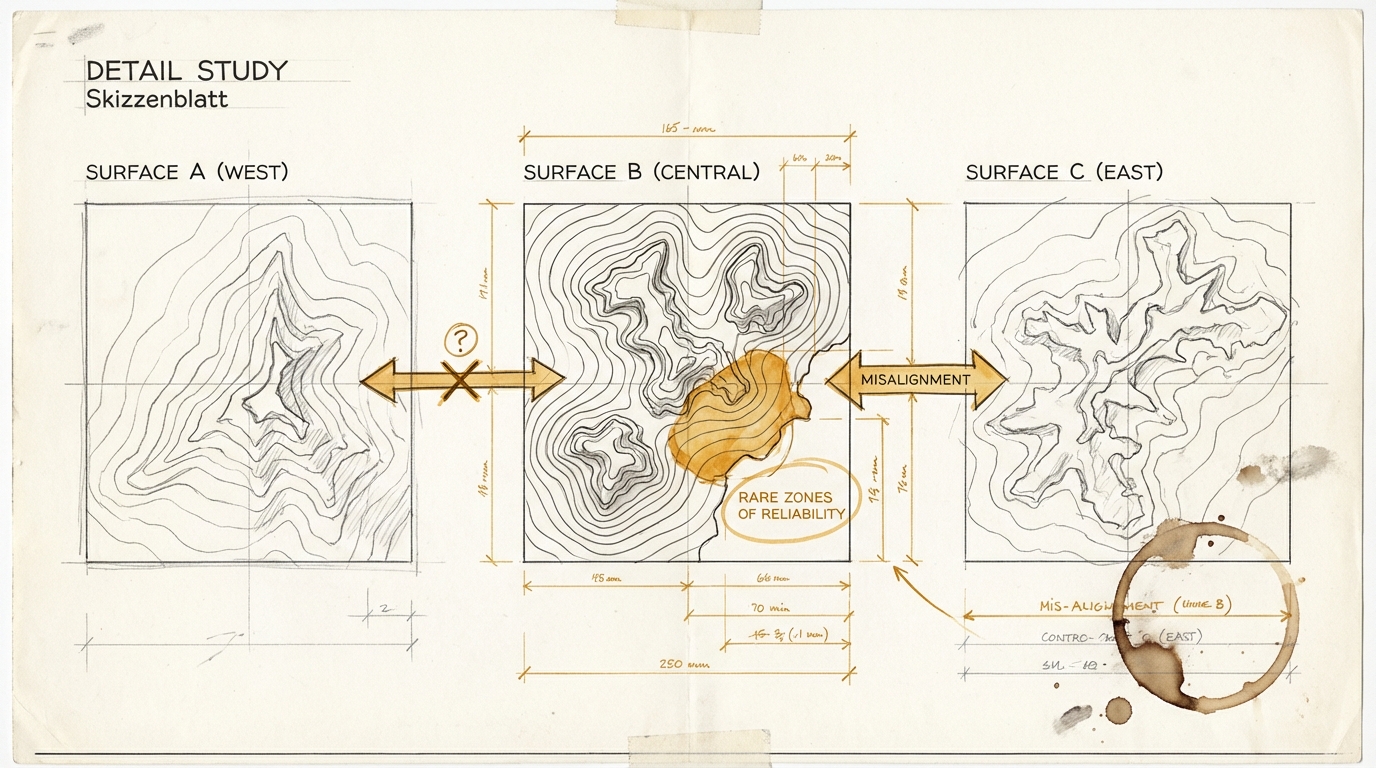

Evans geht einen Schritt weiter und beschreibt drei gezackte Oberflächen, die aufeinander liegen:

Die Fähigkeiten der Modelle sind ungleichmäßig verteilt. ChatGPT berechnet USPS-Paketvolumen falsch, Gemini extrahiert Census-Daten korrekt aus PDFs. Verschiedene Modelle, verschiedene Stärken, und kein verlässlicher Weg, das vorher zu wissen.

Die Evaluationsmethoden sind selbst unzuverlässig. Wer den Output prüft, hat sein eigenes gezacktes Kompetenzprofil. Ob eine Antwort stimmt, hängt davon ab, ob der Prüfer die richtige Prüfmethode für genau diese Aufgabe wählt.

Die Intuition der Nutzer darüber, was funktioniert, ist systematisch falsch kalibriert. Menschen überschätzen, was das Modell kann, an den falschen Stellen. Und unterschätzen es an anderen.

Drei Oberflächen. Keine davon glatt. Keine davon stabil, weil jedes Model-Update die Topografie verschiebt.

Dieselbe Woche, anderer Kontext: Caitlin Sullivan hat nach 30+ Experimenten mit Synthetic Users und über 2.000 Stunden AI-Testing ein Fazit gezogen. Die meisten Teams, die synthetische Nutzer für Product Discovery einsetzen, produzieren "plausible-sounding nonsense." Plausibel klingenden Unsinn. Weil sie drei Dinge auslassen, die akademische Studien standardmäßig einschließen: die richtige Datenselektion, die passende Fragestellung und die methodische Validierung.

Das ist derselbe Mechanismus. Sullivan beschreibt ihn an einem konkreten Use Case, Evans beschreibt ihn als Strukturproblem. Aber der Kern ist identisch: Der Output sieht richtig aus. Er klingt richtig. Er könnte richtig sein. Und genau das macht ihn gefährlich, denn im Unterschied zu einer Google-Suche, die offensichtlich keine Antwort liefert, liefert ein LLM immer eine Antwort. Ob sie stimmt, ist eine andere Frage. Eine, die sich nicht von selbst beantwortet.

Für dekodiert-Leser ist das die Evaluation-Frage in konzentrierter Form. Ich habe in früheren Texten argumentiert, dass Evaluation der Engpass ist. Aber Evans fügt eine unangenehme Ebene hinzu: Die Evaluation selbst ist unzuverlässig. Die Prüfung ist selbst eine gezackte Oberfläche.

Das ist kein Argument gegen den Einsatz von LLMs. Es ist ein Argument dafür, dass der Aufwand für Evaluation nicht sinkt, wenn die Modelle besser werden. Er steigt. Weil bessere Modelle überzeugendere falsche Antworten produzieren.

Sullivan hat 2.000 Stunden investiert, um herauszufinden, welche Fragen an Synthetic Users funktionieren und welche nicht. Die meisten Teams investieren null.

Die Frage, die ich noch nicht beantworten kann: Wenn selbst die Evaluation unzuverlässig ist, wie baut man institutionelle Kompetenz für etwas auf, bei dem auch die Experten nicht vorhersagen können, wo die Fehler passieren?

Fragt euch selbst (oder fragt eure AI): Bei welchen Aufgaben in eurem Unternehmen vertraut ihr AI-Output, ohne ihn systematisch zu prüfen? Und woher wisst ihr, dass genau diese Aufgaben auf der richtigen Seite der gezackten Grenze liegen?