Die Grenze der guten Absicht

Letzte Woche ging es in Der Vertrauensaufschlag um die Frage, was AI-Plattformen eigentlich teurer macht, wenn nicht der Tokenpreis. Die Antwort war: institutionelle Unsicherheit. Unklare Grenzen. Unberechenbare Eingriffe. Der versteckte Aufschlag sitzt nicht nur auf der Rechnung, sondern in den Sicherheitsmargen, die Unternehmen einbauen müssen.

Der neue Anthropic-Fall verschiebt diese Frage an eine noch grundlegendere Stelle.

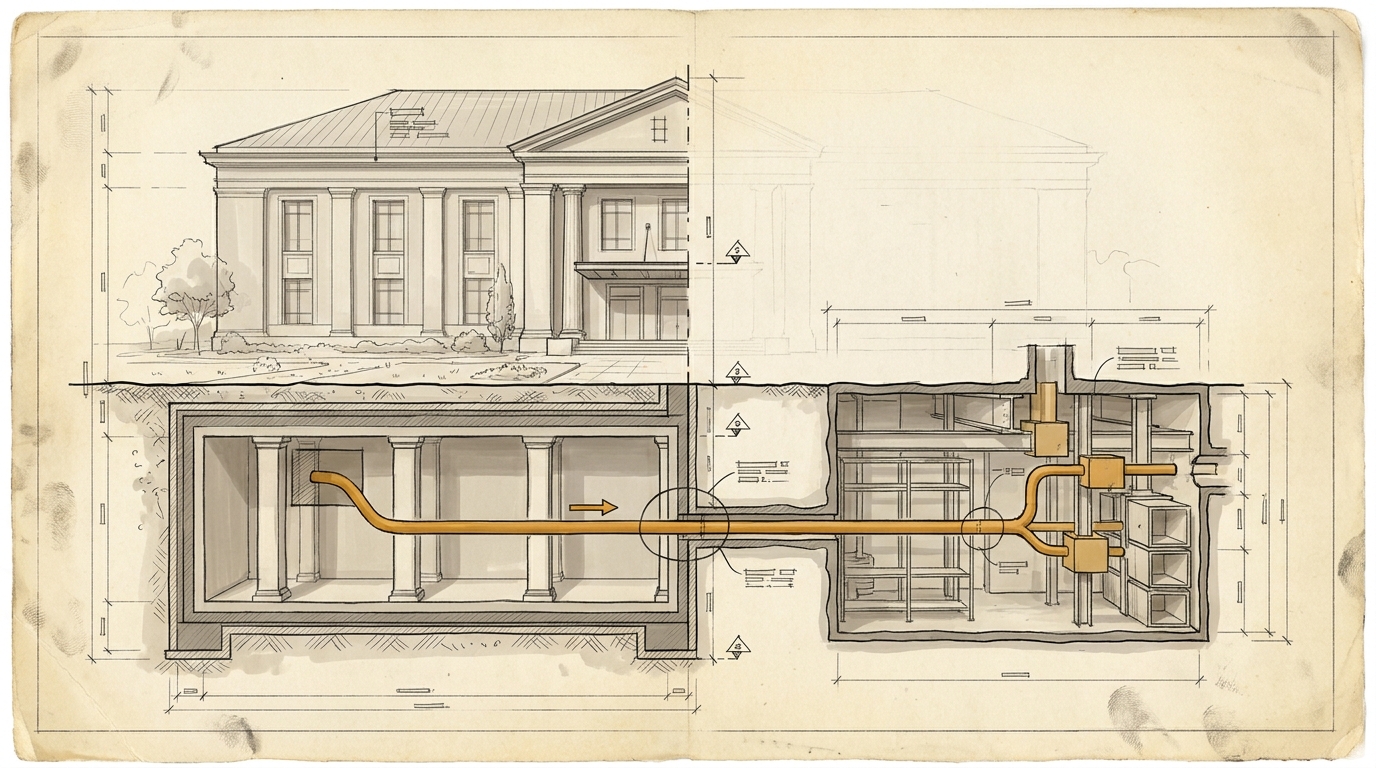

That Privacy Guy dokumentiert, dass Claude Desktop auf dem Mac offenbar still Native-Messaging-Manifeste für mehrere Chromium-Browser hinterlegt, also genau die Brücke, über die eine Browser-Erweiterung später einen lokalen Helper-Prozess starten kann. Anthropic nennt auf der eigenen Hilfeseite nativeMessaging ausdrücklich als Berechtigung für Claude in Chrome. Gleichzeitig steht dort Stand heute auch, dass Claude in Chrome nur in Chrome unterstützt werde, nicht in anderen Chromium-Browsern. Genau diese Differenz macht den Fall interessant: nicht nur technisch, sondern institutionell.

Man kann sich jetzt am Wort "Spyware" festbeißen. Das ist nicht der produktive Punkt. Der produktive Punkt ist ein anderer: Was sagt es über einen Anbieter aus, der sich als der verantwortungsvollste im Markt inszeniert, wenn er still eine privilegierte Integrationsschicht auf dem Gerät des Nutzers vorbereitet, bevor dieser ihr bewusst zugestimmt hat?

Anthropic ist dafür ein besonders gutes Beispiel, gerade weil die Firma ihr Markenversprechen so stark auf Safety, Deliberation und verantwortungsvollen Einsatz gebaut hat. Wenn dann ausgerechnet an der Produktkante die Transparenz unsauber wird, ist das mehr als ein Implementierungsdetail. Es ist ein Hinweis darauf, wo die eigentliche Grenze verläuft.

Diese Grenze verläuft nicht erst bei Missbrauch. Sie verläuft früher. Dort, wo ein Anbieter beginnt, sich Rechte zu nehmen, die im alten Internetmodell auf Sichtbarkeit, Gegenseitigkeit und Zustimmung beruhten.

Das verbindet den Fall auch mit der anderen Grenzfrage, die gerade leiser, aber ebenso folgenreich verhandelt wird: wie viel Traffic und wie viel Last ein Modellanbieter dem offenen Web zumuten darf, um seine Systeme zu trainieren, zu aktualisieren oder agentisch navigieren zu lassen. Ob Browser-Brücke auf dem Endgerät oder Bot-Crawling auf Publisher-Seite: In beiden Fällen geht es um dieselbe Verschiebung. AI-Anbieter behandeln Infrastruktur, die ihnen nicht gehört, zunehmend wie vorverfügbaren Handlungsraum.

Das ist die eigentliche Vertrauensfrage. Nicht: Ist Anthropic gut oder böse? Sondern: Woran erkennt man einen verantwortungsvollen AI-Anbieter wirklich? An seinen Safety-Blogs, an seinen Modellkarten, an seinem Brand? Oder an der Art, wie er sich an den stillen Grundannahmen des Internets verhält, also genau dort, wo kaum jemand hinschaut?

Das offene Web beruhte lange auf einem fragilen, aber verständlichen Deal. Publisher stellen Inhalte öffentlich ins Netz und bekommen dafür Reichweite, Links, Aufmerksamkeit, Geschäft. Nutzer installieren Software und erwarten, dass diese Software sichtbar um Erlaubnis fragt, bevor sie neue Handlungspfade in Browsern, Dateisystemen oder Arbeitsumgebungen anlegt. AI verschiebt gerade beide Seiten dieses Deals gleichzeitig. Oben wird mehr extrahiert, unten wird tiefer integriert.

Genau deshalb reicht es nicht mehr, über "ethische AI" als Frage des Modellverhaltens zu reden. Die interessantere Frage lautet inzwischen: Wie verhält sich der Anbieter zu Grenzen? Wo nimmt er sich still mehr, als ihm explizit gegeben wurde? Wo behandelt er fremde Systeme, Inhalte oder Geräte als Terrain für das eigene Produkt?

Man könnte es auch härter sagen: Der selbsternannte ethische Anbieter ist genau in dem Moment getestet, in dem niemand hinschaut und kein unmittelbarer Missbrauch stattfindet. Nicht bei den veröffentlichten Prinzipien. Sondern bei den Defaults.

Wenn das die neue Lage ist, dann verschiebt sich auch die Messlatte. Vertrauen in AI-Anbieter ist keine Frage des Brandings mehr. Es ist eine Infrastrukturfrage.

Fragt euch selbst, oder fragt eure AI: An welchen Stellen nimmt sich euer Produkt heute still mehr Rechte, als eure Nutzer, Partner oder Publisher bewusst eingeräumt haben?